今日、私は大きな疑問に取り組んでいます。 毒性を評価する in 大規模な言語モデル (LLM)ChatGPT のようなこれらのシステムは、私たちのコミュニケーションや仕事のやり方を変えていますが、有害なコンテンツが生成されるなどのリスクも伴います。

毒性 AI これは単なる技術的な問題ではなく、信頼の問題です。ビジネス用のチャットボットであれ、個人用のツールであれ、これらのモデルが憎悪や誤情報、あるいは危害を拡散しないことを確実にすることは極めて重要です。

これがなぜ重要なのか、どのように行われるのか、そしてどのような課題に直面しているのかを詳しく見ていきましょう。

🤖 LLMにおける毒性がなぜ重要なのか

チャットボットが顧客に応答する様子を想像してみてください。 人種差別的な発言や虚偽の情報を拡散する 情報 何千人も誤解させるそれは有害性、つまり不快、有害、または不適切なコンテンツです。

研究によると、法学修士課程は適切に管理されなければヘイトスピーチや脅迫を生み出したり、自傷行為を助長したりする可能性がある。2023年の研究では、法学修士課程の割り当てが ChatGPTペルソナボクサーのように、ステレオタイプや攻撃的な口調に陥り、毒性が最大 6 倍に高まる可能性があります。

これが心に響く理由は次のとおりです。

何が有害とみなされるのか?

毒性は一律ではありません。複数のカテゴリーにまたがり、それぞれが現実的な影響を及ぼします。

文脈も重要です。歴史の授業での引用と、無作為な侮辱は違います。だからこそ、有害な発言を見極めるには、慎重な思考と適切なツールが必要なのです。

毒性の測定方法:方法

では、毒性が広がる前にどうやってそれを捕捉するのでしょうか?専門家は、それぞれに長所を持つ複数のアプローチを組み合わせて用いています。概要は以下のとおりです。

1. 人間による評価

実在の人々、多様なパネル、レビュー AI 危害を察知するための出力。皮肉や文化的な手がかりを理解するなど、機械では到底及ばない判断力を発揮します。

統計:2021年のDeepMindのレポートでは、注釈者は メンタルヘルスサポート 有毒物質を調べた結果、この方法には人命の犠牲が伴うことが判明しました。

2. 自動化ツール

Perspective API (Jigsaw 製) や Detoxify などのソフトウェアは、テキストを高速にスキャンし、毒性のスコアを付けます。

事実: Perspective API は、初期のテストで、データの偏りにより「私はゲイであることを誇りに思います」という表現を 14% の確率で有害と判定しました。これは、ツールが完璧ではないことを思い出させます。

3。 ベンチマーク

標準化されたデータセットでモデルを直接テストします。

- トキシジェン: 274,186 の少数派グループにわたる暗黙のヘイトスピーチを対象とした 13 件の例。

- リアル毒性プロンプト: 有害な返信を誘発するように設計された 100,000 のプロンプト。

- ハームベンチ: 33の方法で18のLLMをテストします レッドチームの脆弱性。

4. レッドチーム

チーム「攻撃” モデルに、脱獄などの巧妙なプロンプトを出して弱点を暴きます。

例: 2024年のアレン AI 調査、 ポリグロ毒性プロンプトは、LLM がスワヒリ語のようなリソースの少ない言語で有害なコンテンツを吐き出していることを示し、安全性が世界的な難問であることを証明した。

簡単に比較してみましょう

| 方法 | 速度 | 精度 | 費用 | 以下のためにベスト |

|---|---|---|---|---|

| 人間の評価 | 遅く | ハイ | ハイ | 微妙な判断 |

| 自動化されたツール | 対応時間 | 技法 | ロー | 大規模なチェック |

| ベンチマーク | 技法 | ハイ | 技法 | モデル比較 |

| レッドチーム | 技法 | ハイ | ハイ | 脆弱性テスト |

課題:なぜ簡単ではないのか

毒性物質を捕まえるのは簡単そうに聞こえますが、実は迷路のようなものです。その理由は次のとおりです。

- コンテキストの重要性

「あなたは失敗者だ「」は友人同士の冗談かもしれないし、見知らぬ人からの強烈なパンチかもしれない。機械はそれらの違いを見分けるのに苦労する。

- 文化のギャップ

日本で失礼とされることが、ブラジルでは問題ないかもしれない。2024年の研究では、毒性スコアは文化によって大きく異なることが示されており、普遍的なルールでは通用しない。

- 主観性のルール

ある人にとって「不快」な言葉が、別の人にとっては「正直」な言葉になる。何が有害かという点について合意するのは、まさに戦場だ。

言語は変化し続ける

スラングはすぐに出てきます。「リズ」または「yeet」。評価ツールが遅れ、新たな危険信号を見逃しています。

倫理的な視点:人間的側面

これは単なる技術の問題ではありません。人の問題です。何が危機に瀕しているのか、以下に示します。

- アノテーターの健康毎日ヘイトスピーチを目にするのは負担だ。企業は現在カウンセリングを提供しているが、それは大きな傷に絆創膏を貼る程度のものだ。

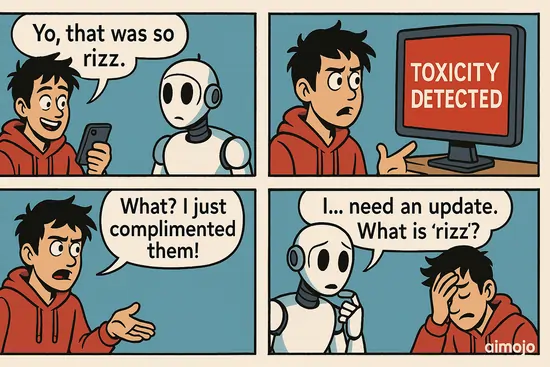

- バイアスリスク評価者が多様でない場合、ある文化の規範を優先するなど、偏見が入り込んでしまいます。

- 言論の自由に関する議論フィルターはあまりにも多くの情報を遮断しすぎてしまう。安全と検閲の境界線はどこにあるのだろうか?

例: OpenAIのフィルターは一部の無害なチャットをブロックしており、フィルタリングされていないAIを求めるユーザーからの反発を招いている。まさに綱渡りの道だ。

次は何か: AI 安全性

良いニュースは?私たちは行き詰まっていません。評価の方向性は次のとおりです。

予測2030年のOpenReview論文によると、80年までに法学修士課程の2024%が毒性をリアルタイムで自己チェックできるようになる見込みです。これが目標です。

主要なデータセット: チートシート

主要なベンチマークのスナップショットは次のとおりです。

| データセット | サイズ | フォーカス | なぜ役に立つのか |

|---|---|---|---|

| トキシジェン | 274,186 | 暗黙のヘイトスピーチ | 微妙な偏りを見抜く |

| リアル毒性プロンプト | 100,000 | 有害な誘因 | 安全限界をテストする |

| ハームベンチ | 33のLLMがテストされました | レッドチーミング | 弱点を見つける |

| CrowS ペア | 1,508 | 社会的偏見 | 公平性のギャップを測定 |

これらのツールは現代の評価の基盤となるものであり、ぜひ理解し、活用してください。

推奨読書:

まとめ: AI 私たちは信頼できる

LLMにおける毒性の評価は副次的な課題ではない安全で倫理的なAIの鍵です。人間によるレビューから スマートツール私たちは、被害が拡大する前にそれを捕捉するシステムを構築しています。文化や文脈といった課題は消えることはありませんが、世界的な努力と斬新なアイデアがあれば、私たちは正しい道を歩んでいると言えるでしょう。

At Aimojo.io では、AI の将来が私たち全員にとって重要であるため、私はこの分野を追跡し続けます。

AIにおける安全性と自由度のバランスをどのように取るべきでしょうか?ぜひご意見をお聞かせください。

ボーナス: 200ドルの「AI 登録すると「マスタリーツールキット」が無料になります!

ボーナス: 200ドルの「AI 登録すると「マスタリーツールキット」が無料になります!