MiniMax-M1, l'ultimo LLM open source di MiniMaxAI di Shanghai, sta dominando AI forum, e per una buona ragione. Lungi dall'essere una versione di routine, questo motore di ragionamento sposa un sorprendente Finestra di contesto da 1 milione di token con una struttura portante ibrida basata su un mix di esperti e un'attenzione fulminea proprietaria.

I primi utilizzatori lo considerano il più rivoluzionario del 2025 open-source innovazioni, sviluppatori promettenti, ricercatori e AI tinkerers su scala senza precedenti, senza la solita tassa sull'hardware.

Ma MiniMax-M1 e il suo agente complementare riusciranno davvero a soddisfare le aspettative? Ecco perché questo modello potrebbe ridefinire i sistemi di gestione dell'informazione (LLM), gli agenti autonomi e i flussi di lavoro di nuova generazione.

Cos'è MiniMax-M1? Le specifiche che contano

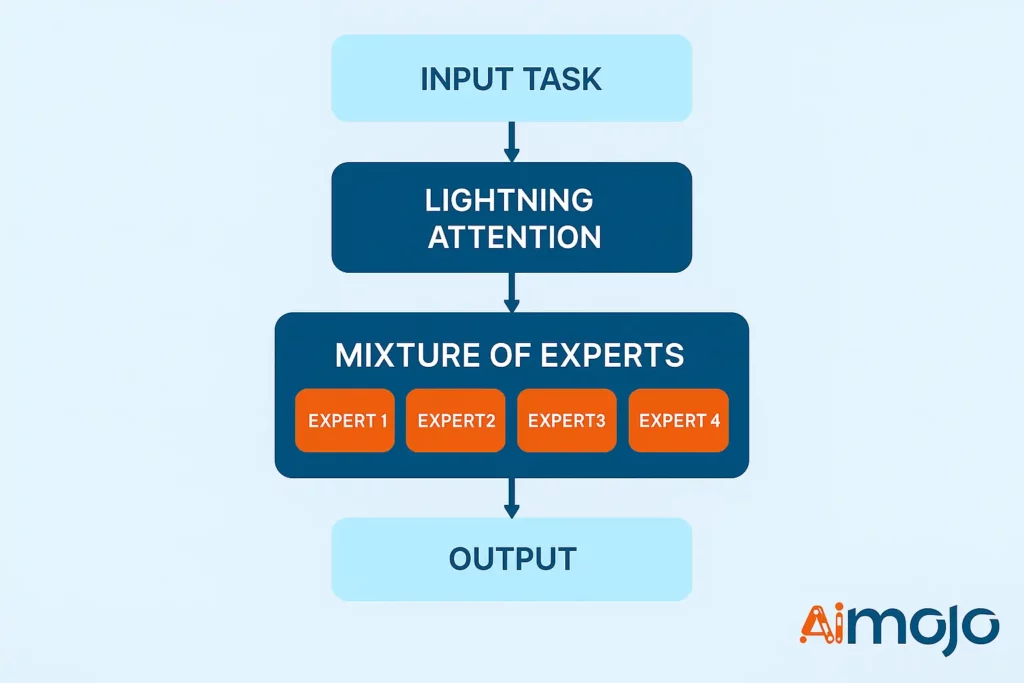

MiniMax-M1 è un modello di ragionamento ibrido-attentivo aperto e su larga scala, appositamente progettato per il ragionamento in forma lunga, la codifica complessa e flussi di lavoro agenticiEcco cosa lo distingue:

Puoi scaricare i pesi del modello e il codice da [GitHub] oppure provarlo subito su Hugging Face e sull'interfaccia di chat ufficiale di MiniMax.

Caratteristiche principali e innovazioni di MiniMax-M1

1. Attenzione fulminea: velocità senza sacrificare la profondità

I trasformatori tradizionali si bloccano nei contesti lunghi a causa dei costi di attenzione quadratici. Lightning Attention di MiniMax-M1 riduce drasticamente i costi di inferenza, rendendo possibile la gestione di documenti di grandi dimensioni, basi di codice o persino intere serie di libri in un unico passaggio, senza bisogno di un supercomputer.

2. Mix di esperti (MoE): più intelligenti, non solo più grandi

Invece di forzare brutalmente tutti i 456B parametri per ogni token, M1 attiva solo il “esperti" per ogni input. Ciò significa che si ottiene la scala di un mega-modello, ma con l'efficienza di uno molto più piccolo, perfetto per carichi di lavoro reali e distribuzioni cloud.

3. Apprendimento rinforzato CISPO: formazione efficiente e stabile

L'algoritmo RL personalizzato di MiniMax, CISPO (Clipped Importance Sampling Policy Optimization), ritaglia i pesi di campionamento anziché gli aggiornamenti dei token. Questo mantiene stabile l'addestramento anche su larga scala e aiuta il modello a ragionare su problemi complessi e multi-step, come i puzzle delle Olimpiadi di matematica. codifica full-stacko risposte a domande multi-hop.

4. Contesto del token 1M: niente più contesti frammentati

Dimentica i giorni in cui si dividevano i documenti o si perdeva il contesto nelle lunghe conversazioni. Il linguaggio nativo 1M di M1 contesto del token window è una bestia, il che lo rende ideale per analisi legali, riassunti di libri, refactoring di basi di codice o qualsiasi flusso di lavoro in cui memoria e continuità sono importanti.

5. Utilizzo di strumenti agenti e multimodalità

M1 non è solo un chatbot: è la base per MiniMax Agent, un agente multiuso AI agente in grado di:

MiniMax-M1 in azione: flussi di lavoro e prestazioni reali

Coding e ingegneria del software

Su LiveCodeBench, MiniMax-M1 raggiunge un solido 65%, eguagliando o superando altri modelli aperti come Qwen3-235B e DeepSeek-R1. I suoi punteggi FullStackBench (68.3%) dimostrano che non si tratta solo di frammenti, ma di codice full-stack pronto per la produzione. L'agente MiniMax può generare, testare e persino distribuire app web e giochi con un singolo prompt.

Ragionamento matematico

M1 è un mago della matematica: 86% su AIME 2024, 96.8% su MATH-500 e ottimi risultati nei compiti di ragionamento multi-hop. A differenza di molti LLM che allucinano o si perdono in enigmi logici, l'attenzione ibrida di M1 gli consente di "pensare" attraverso complesse catene di ragionamento, rendendolo uno dei preferiti da ricercatori e insegnanti di matematica.

Comprensione del contesto a lungo termine

Su OpenAI-MRCR (128 token), M1 ottiene un punteggio del 73.4% ed è uno dei pochi modelli che rimane accurato anche quando le finestre di contesto si estendono fino a un milione di token. Per attività come la revisione di documenti legali, la sintesi di ricerche o analisi della base di codice, questa è una cosa importante.

Flussi di lavoro agentici

MiniMax Agent è più di una demo: è pronto per la produzione AI assistente che può:

Confronto di benchmark: come si comporta il MiniMax-M1?

Ecco una rapida occhiata alle prestazioni di MiniMax-M1 nei benchmark chiave, confrontandole con i migliori modelli aperti e commerciali:

| Attività/Benchmark | MiniMax-M1-80K | DeepSeek-R1 | Qwen3-235B | Claude 4 Opus | ApriAI o3 | Gemelli 2.5 Pro |

|---|---|---|---|---|---|---|

| AIME 2024 (Matematica) | 86.0 | 79.8 | 85.7 | 76.0 | 91.6 | 92.0 |

| LiveCodeBench (Codifica) | 65.0 | 55.9 | 65.9 | 56.6 | 75.8 | 77.1 |

| SWE-bench (Software) | 56.0 | 49.2 | 34.4 | 72.5 | 69.1 | 67.2 |

| OpenAI-MRCR (128K) | 73.4 | 35.8 | 27.7 | 48.9 | 56.5 | 76.8 |

| Banco TAU (uso degli utensili) | 62.0 | 44.0 | 34.7 | 59.6 | 52.0 | 50.0 |

💡 Nota:

M1 è un'applicazione aperta e gratuita, mentre molti concorrenti sono chiusi o richiedono ingenti commissioni API.

MiniMax Agent: la prossima generazione AI Agente basato su M1

L'agente MiniMax, ora in versione beta, è un agente universale AI Agente progettato per attività a lungo termine e multi-fase. Ecco cosa puoi aspettarti:

E sì, capisci 1,000 crediti gratuiti per sperimentare l'Agente: non è richiesta alcuna carta di credito.

Vantaggi e statistiche uniche: perché MiniMax-M1 è assolutamente da provare

Come iniziare con MiniMax-M1 e Agent

Considerazioni finali: il MiniMax-M1 vale tutte queste aspettative?

MiniMax-M1 non è solo un altro grande modello: è un ripensamento del modo in cui IA open source dovrebbe funzionare: contesto massiccio, efficienza pratica e flussi di lavoro agenti pronti per l'uso nel mondo reale.

Se tu sei edificio AI applicazioni, stai sperimentando con framework di agenti o desideri semplicemente un modello in grado di gestire i tuoi prompt più folli e i documenti più lunghi, M1 è assolutamente da provare. E con l'agente MiniMax, non ottieni solo risposte: hai un copilota per la tua codifica, la tua ricerca e esigenze di automazione.

Pronti a scoprire cosa può fare un LLM davvero aperto, efficiente e potente? Provate MiniMax-M1 e unitevi alla prossima ondata di AI innovazione.

BONUS: Ottieni i nostri 200$ "AI "Mastery Toolkit" GRATIS se ti registri!

BONUS: Ottieni i nostri 200$ "AI "Mastery Toolkit" GRATIS se ti registri!