Alors que les géants de la technologie se battent pour AI domination, Alibaba a lancé une onde de choc : Modèles Qwen3Il ne s’agit pas seulement de mises à niveau : il s’agit d’une redéfinition du potentiel de l’IA open source.

Sorti la semaine dernière, Qwen3 s'étend sur huit modèles, d'une version légère 600M (parfaite pour les ordinateurs portables) à une Le mastodonte 235B MoE surpassant les concurrents de premier plan comme OpenAI et Google. Mais ce qui distingue Qwen3, c'est son « pensée hybride »—basculant intelligemment entre un raisonnement approfondi et des réponses rapides en fonction de la tâche.

Le meilleur de tous? It's entièrement open source. Les développeurs du monde entier découvrent que Qwen3 peut rivaliser ou dépasser les modèles haut de gamme, à une fraction du prix.

La famille de modèles Qwen3 : une taille pour chaque besoin

Qwen3 représente un bond en avant significatif dans AI conception de modèles, offrant une flexibilité sans précédent avec des modèles denses et Mélange d'experts Variantes (MoE). Ici's la programmation complète :

| Nom du modèle | Paramètres totaux | Paramètres actifs | Type de modèle | Longueur du contexte |

|---|---|---|---|---|

| Qwen3-235B-A22B | 235 milliard | 22 milliard | MoE | 128 XNUMX jetons |

| Qwen3-30B-A3B | 30 milliard | 3 milliard | MoE | 128 XNUMX jetons |

| Qwen3-32B | 32 milliard | N/D | donner l'un à l'autre | 128 XNUMX jetons |

| Qwen3-14B | 14 milliard | N/D | donner l'un à l'autre | 128 XNUMX jetons |

| Qwen3-8B | 8 milliard | N/D | donner l'un à l'autre | 128 XNUMX jetons |

| Qwen3-4B | 4 milliard | N/D | donner l'un à l'autre | 32 XNUMX jetons |

| Qwen3-1.7B | 1.7 milliard | N/D | donner l'un à l'autre | 32 XNUMX jetons |

| Qwen3-0.6B | 0.6 milliard | N/D | donner l'un à l'autre | 32 XNUMX jetons |

L’aspect le plus fascinant est la façon dont le L'architecture du MoE permet Efficacité impressionnante. Par exemple, le modèle Qwen3-30B-A3B active seulement 3 B paramètres lors de l'inférence, tout en surpassant de nombreux modèles entièrement actifs à 32 B paramètres. Cette conception astucieuse offre des performances haut de gamme sans nécessiter de ressources de calcul excessives.

Les recherches suggèrent que les modèles MoE comme ceux-ci peuvent égaler les capacités des modèles 3 à 5 fois plus grands que leur taille active, ce qui les rend incroyablement rentables pour le déploiement.

Caractéristiques qui distinguent les modèles Qwen3

🔄 Modes de pensée hybrides : une première AI Design

Qwen3's L'innovation la plus révolutionnaire est son approche à double réflexion, quelque chose qu'aucune autre famille de modèles open source n'offre avec une telle flexibilité.

Mode de réflexion : Face à des problèmes complexes nécessitant un raisonnement en plusieurs étapes (comme les mathématiques, le codage ou les énigmes logiques), Qwen3 active son mode de réflexion. Cela permet de raisonner étape par étape sur des tâches complexes avant de fournir la réponse finale.

Mode non-pensée : Pour des questions simples ou des conversations informelles, Qwen3 passe en mode non-réflexion, fournissant des réponses rapides et concises sans surcharge de calcul inutile.

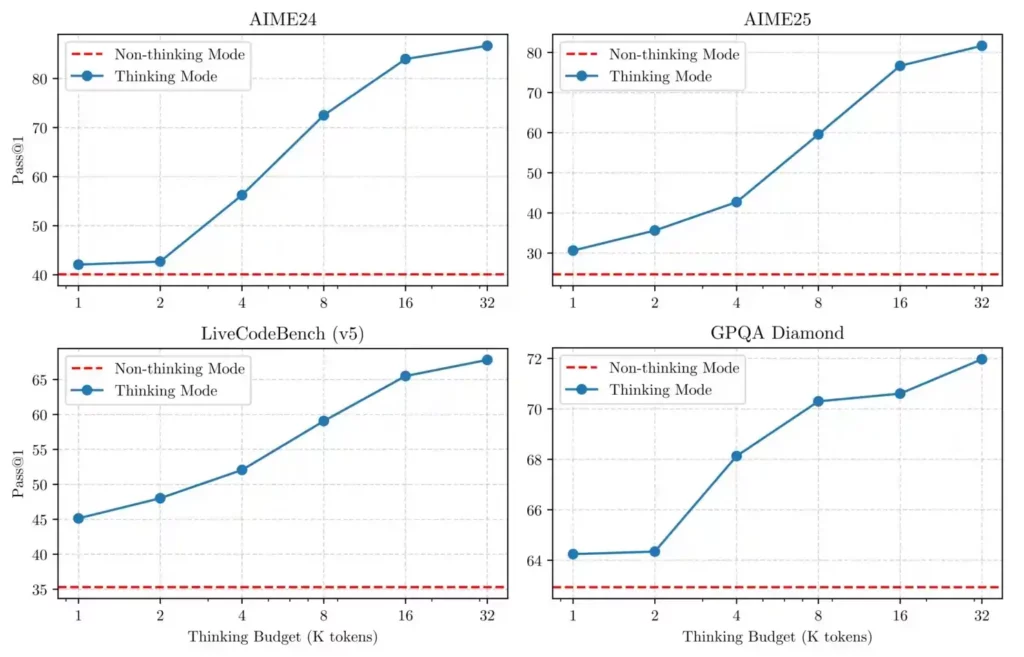

Avec « budgets de réflexion » contrôlables par l'utilisateur les développeurs peuvent affiner la quantité de raisonnement appliquée par Qwen3, ce qui donne jusqu'à 65 % de gains de performances sur des tâches comme les mathématiques avancées.

🌍 Maîtrise multilingue dans 119 langues

Alors que la plupart des modèles haut de gamme se concentrent principalement sur l'anglais, Qwen3 a été entraîné sur un vaste ensemble de données couvrant 119 langues et dialectes. Cette prise en charge linguistique étendue le rend particulièrement précieux pour les applications mondiales et les communautés linguistiques mal desservies.

Des tests internes montrent que Qwen3-235B-A22B atteint une précision de 87 % sur des tâches de raisonnement complexes dans des langues comme l'arabe, l'hindi et le thaï, approchant ainsi ses 92 % sur des tâches en anglais. Cet écart de performance faible entre les langues est sans précédent parmi les tests. modèles open source.

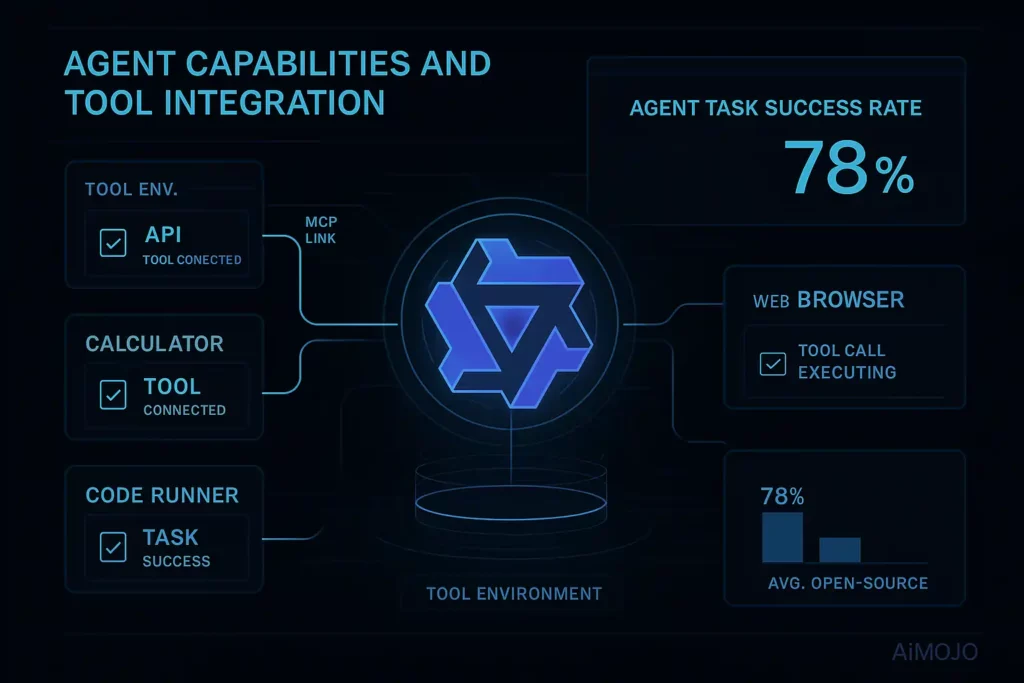

Capacités des agents et intégration des outils

Moderne AI Les applications nécessitent de plus en plus de modèles capables d'interagir avec des outils et systèmes externes. Qwen3 excelle dans ce domaine grâce à une prise en charge améliorée de Protocole de contexte modèle (MCP), des capacités d'appel d'outils améliorées et un framework Qwen-Agent dédié à la création d'agents intelligents.

Des tests effectués par des développeurs indépendants révèlent que les modèles Qwen3 atteignent des taux de réussite de 78 % sur des tâches d'agent complexes nécessitant de multiples interactions avec des outils, surpassant ainsi considérablement de nombreux concurrents dans l'espace open source.

Architecture technique et méthodologie de formation

Qwen3's Des capacités impressionnantes découlent d’une approche de formation sophistiquée s’étendant sur trois phases distinctes :

Processus de pré-formation en trois étapes

- Acquisition des connaissances de base : Formation initiale sur environ 36 4 milliards de jetons avec une longueur de contexte de XNUMX XNUMX, établissant une compréhension et des connaissances linguistiques étendues.

- Amélioration des tâches spécialisées : Formation ciblée sur les sujets STEM, les défis de codage et raisonnement complexe tâches visant à développer des capacités avancées de résolution de problèmes.

- Extension de contexte long : Formation finale avec des données de contexte étendues pour permettre la gestion de documents jusqu'à 32 128 jetons (pour les modèles plus petits) ou XNUMX XNUMX jetons (pour les variantes plus grandes).

Optimisation post-formation

Après la pré-formation initiale, Qwen3 a suivi un processus post-formation en quatre étapes :

- Démarrage à froid de la chaîne de pensée : Formation avec des exemples de raisonnement explicites pour établir des modèles de pensée logique de base.

- Apprentissage par renforcement basé sur le raisonnement : Optimiser le modèle's capacité à appliquer le raisonnement de manière cohérente à diverses tâches.

- Fusion du mode de pensée : Intégrer la capacité de passer d’une approche réfléchie à une approche non réfléchie.

- Apprentissage par renforcement général : Affinement final basé sur les préférences humaines et les techniques d’alignement.

Cette méthodologie explique pourquoi même le modèle compact Qwen3-4B surpasse de nombreux concurrents plus grands : il bénéficie des connaissances tirées des modèles plus grands de la famille.

Tests de performance : Comparaison de Qwen3

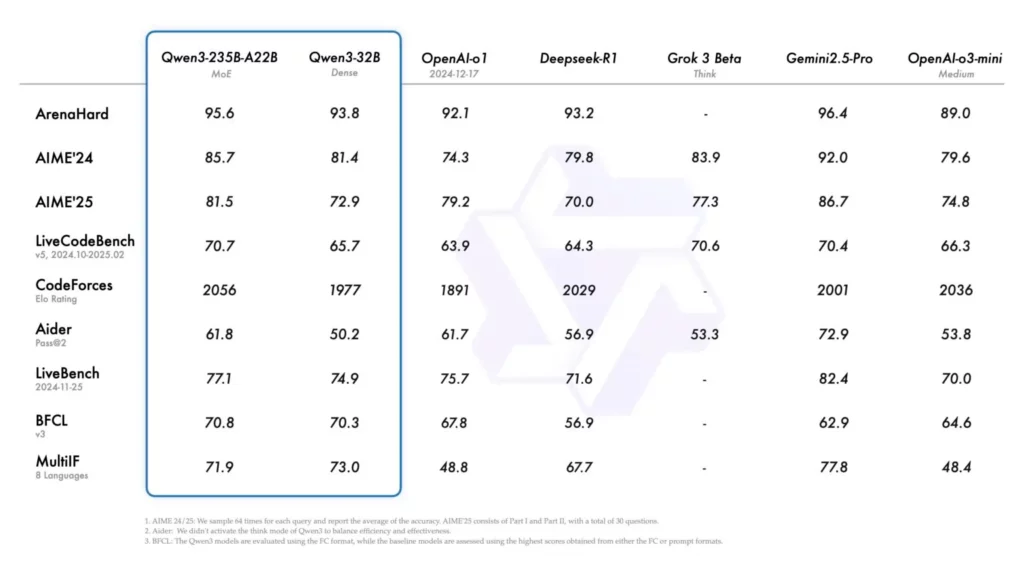

Les résultats récents des benchmarks ont surpris beaucoup de monde AI chercheurs, les modèles Qwen3 affichant des performances exceptionnelles face à des concurrents beaucoup plus grands.

Comparaisons de modèles haut de gamme

Le modèle phare Qwen3-235B-A22B affiche des résultats remarquables par rapport aux leaders du secteur :

- Performances de codage : En tête des benchmarks CodeForces Elo Rating, BFCL et LiveCodeBench v5, surpassant même DeepSeek-R1 et OpenAI's o1.

- Mathématiques: Il obtient un score inférieur de seulement 3.2 % à celui de Gemini 2.5 Pro sur les benchmarks ArenaHard et AIME, mais y parvient avec beaucoup moins de paramètres actifs.

- Raisonnement général : Il fonctionne à 5 % près de GPT-4o sur des benchmarks de raisonnement complexes tout en étant entièrement open source.

Efficacité taille-performance

Le plus impressionnant est peut-être la façon dont les modèles Qwen3 sont plus petits par rapport aux générations précédentes :

- Qwen3-30B-A3B (avec seulement 3B paramètres actifs) surpasse le modèle QwQ-32B précédent (avec tous les 32B paramètres actifs).

- Qwen3-4B fournit des résultats comparables aux modèles 5 fois plus grands qu'il y a un an seulement.

Lors de tests de comparaison directe avec DeepSeek-R1Qwen3 a montré des résultats supérieurs dans les tâches de codage et de structuration de texte, tandis que DeepSeek-R1 a conservé un léger avantage dans les problèmes mathématiques complexes.

Performances réelles : au-delà des repères

Les repères quantitatifs ne racontent qu'une partie de l'histoire. Ici's comment Qwen3 se comporte dans des tâches pratiques et réelles :

Le modèle Qwen3-30B-A3B traite des problèmes de physique avancés, comme la relativité et la dilatation du temps, avec des solutions structurées et précises. Le modèle 235B-A22B approfondit le sujet en détectant les idées fausses et en suggérant des méthodes alternatives, démontrant ainsi un solide raisonnement analytique.

Comment accéder à Qwen3 et le déployer

Tous les modèles Qwen3 sont libres de droits sous licence Apache 2.0, ce qui les rend accessibles à un usage personnel et commercial. Voici les principales méthodes d'accès à ces modèles :

Accès en ligne

- QwenChat: Le moyen le plus simple d'essayer les modèles Qwen3 via Alibaba's interface Web.

- Étreindre le visage: Tous les modèles sont disponibles sur Hugging Face pour une utilisation directe ou un réglage fin.

- ModèlePortée: Fournit des options de déploiement et une documentation supplémentaires.

- Kaggle: Propose des environnements de notebook pour expérimenter les modèles.

Déploiement local

Pour le déploiement local, plusieurs frameworks prennent en charge Qwen3 :

- Ollama et LMStudio : Des outils conviviaux pour exécuter des modèles localement.

- lama.cpp: Implémentation C++ efficace pour des performances optimisées.

- MLX : Déploiement optimisé pour Apple Silicon.

- KTransformers : Options de déploiement spécialisées pour des cas d’utilisation spécifiques.

Déploiement du serveur

Pour les environnements de production, Qwen3 fonctionne avec :

- SGLang: Optimisé pour le déploiement de serveur avec un débit élevé.

- vLLM : Fournit un service efficace avec des fonctionnalités avancées telles que le traitement par lots continu.

Applications et cas d'utilisation

Qwen3's sa polyvalence le rend adapté à de nombreuses applications :

- Création de contenu: Générer des articles, copie marketing, et l'écriture créative.

- Développement de logiciel: Génération de code, débogage et documentation.

- L'Education: Créer du matériel pédagogique et répondre à des questions complexes.

- Recherche: Aide à la revue de la littérature et à la génération d’hypothèses.

- Service à la Clientèle: Alimenter des chatbots intelligents avec de fortes capacités de raisonnement.

- L'analyse des données: Interpréter des données complexes et générer des informations.

- Génération augmentée par récupération (RAG) : Créer des systèmes de connaissances sophistiqués à l'aide de Qwen3's fenêtre contextuelle et capacités de raisonnement.

Limitations actuelles et développements futurs

Malgré ses capacités impressionnantes, Qwen3 présente certaines limites :

- Le mode de pensée peut parfois être trop verbeux pour des tâches simples.

- Bien que multilingue, les performances varient encore quelque peu selon les langues.

- Les modèles les plus grands nécessitent des ressources importantes malgré les gains d’efficacité du MoE.

En regardant vers l'avenir, Alibaba's La feuille de route de développement suggère plusieurs possibilités intéressantes :

- Intégration supplémentaire avec les capacités Qwen3-VL (Visual Language).

- Sortie de modèles Qwen3-Audio spécialisés pour traitement de la parole.

- Versions améliorées de Qwen3-Math optimisées pour les applications techniques et scientifiques.

Conclusion : Qwen3's Placer dans le AI Paysage

Qwen3 est plus qu'un simple AI modèle drop—c'est un bond en avant stratégique dans l'IA open source.

Avec des innovations telles que le raisonnement hybride, l'architecture MoE efficace et la couverture linguistique mondiale, c'est conçu pour une évolutivité réelle.

Pour les développeurs, chercheurset les entreprises souhaitant des capacités de pointe sans verrouillage du fournisseur, Qwen3 offre un ouvert, puissant et pratique alternative — consolidant sa place parmi les 2025's plus important AI développements.

BONUS: Obtenez notre 200 $ «AI « Boîte à outils de maîtrise » GRATUITE lors de votre inscription !

BONUS: Obtenez notre 200 $ «AI « Boîte à outils de maîtrise » GRATUITE lors de votre inscription !