ร่วมกัน AI ข้อมูลเชิงลึกที่สำคัญ

Together AI คืออะไร?

ร่วมกันเอไอ เป็นฟูลสแต็ก AI แพลตฟอร์มคลาวด์ที่สร้างขึ้นสำหรับนักพัฒนาและวิศวกร ML ที่ต้องการเข้าถึงโมเดลภาษาขนาดใหญ่แบบโอเพนซอร์สได้อย่างรวดเร็วและคุ้มค่า ก่อตั้งขึ้นในปี 2020 แพลตฟอร์มนี้ให้บริการการอนุมานแบบไร้เซิร์ฟเวอร์ การปรับแต่งโมเดลอย่างละเอียด จุดเชื่อมต่อ GPU เฉพาะ และคลัสเตอร์ GPU ตามความต้องการ ทั้งหมดนี้รวมอยู่ในที่เดียว รองรับโมเดลมากกว่า 200 รุ่นจากตระกูลต่างๆ เช่น Llama 4, DeepSeek V3, Qwen 3.5, Mistral และ FLUX สำหรับการสร้างภาพ

ร่วมกัน AI ช่วยลดภาระในการจัดการโครงสร้างพื้นฐาน GPU ทำให้ทีมสามารถมุ่งเน้นไปที่การสร้างซอฟต์แวร์ได้ AI แอปพลิเคชันดั้งเดิม เป็นแบบเปิดAI API ที่เข้ากันได้หมายความว่าโค้ดเบสที่มีอยู่สามารถย้ายได้โดยมีการเปลี่ยนแปลงน้อยที่สุด เหมาะสำหรับธุรกิจที่ต้องการใช้งานปริมาณมาก AI ลดภาระงานด้วยต้นทุน API ที่เป็นกรรมสิทธิ์เพียงเศษเสี้ยวเดียว ร่วมกัน AI บริษัทอยู่ในตำแหน่งที่แข็งแกร่งในฐานะผู้ให้บริการการอนุมานและการฝึกอบรมระดับใช้งานจริง

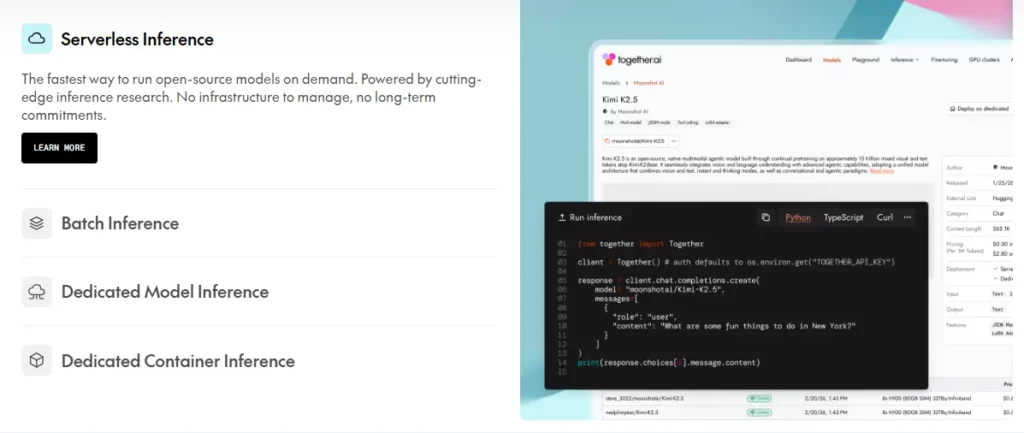

ร่วมกัน AI โฮสต์มากกว่า 200 โมเดลโอเพ่นซอร์ส ครอบคลุมทั้งข้อความ รูปภาพ วิดีโอ เสียง การฝังข้อมูล และการสร้างโค้ด นักพัฒนาสามารถเรียกใช้โมเดลใดก็ได้ผ่าน API เดียวโดยไม่ต้องจัดเตรียมเซิร์ฟเวอร์ โมเดลอย่าง Llama 4 Maverick มีราคาประมาณ 0.27 ดอลลาร์ต่อโทเค็นอินพุตหนึ่งล้านโทเค็น ทำให้เวิร์กโหลดการผลิตปริมาณมากมีราคาถูกกว่าทางเลือกที่เป็นกรรมสิทธิ์อย่างมาก แพลตฟอร์มนี้ยังรวมถึง Batch API สำหรับงานที่ไม่เร่งด่วนในราคาที่ลดลงด้วย

เอนจินการอนุมานที่เป็นกรรมสิทธิ์ของ Together AI ใช้ FlashAttention 3 และระบบตัวคาดการณ์ ATLAS เพื่อให้การอนุมานเร็วขึ้นถึง 3.5 เท่าเมื่อเทียบกับการใช้งานแบบมาตรฐาน บนฮาร์ดแวร์ NVIDIA H100 สามารถทำได้ประมาณ 840 TFLOPs/s ด้วยความแม่นยำ BF16 ผลลัพธ์ในโลกแห่งความเป็นจริงคือประมาณ 400 โทเค็นต่อวินาทีในการใช้งานจริง ซึ่งเร็วกว่าความเร็วในการส่งออกของ GPT 4 Turbo ประมาณ 2.5 ถึง 4 เท่า

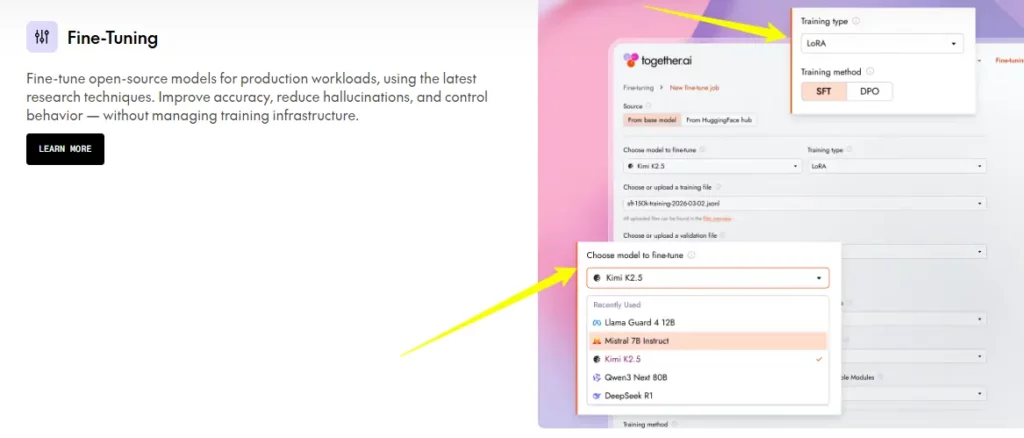

แพลตฟอร์มนี้รองรับทั้ง LoRA (Low Rank Adaptation) และการปรับแต่งน้ำหนักเต็มรูปแบบสำหรับโมเดลที่มีพารามิเตอร์สูงสุด 100 พันล้านตัว ราคาเริ่มต้นที่ 0.48 ดอลลาร์สหรัฐต่อโทเค็นหนึ่งล้านโทเค็นสำหรับ LoRA บนโมเดลที่มีพารามิเตอร์สูงสุด 16 พันล้านตัว ทีมงานสามารถฝึกฝนโมเดลด้วยข้อมูลที่เป็นกรรมสิทธิ์เพื่อสร้างระบบเฉพาะงานสำหรับงานด้านกฎหมาย การแพทย์ หรืออื่นๆ แอปพลิเคชันสนับสนุนลูกค้า จากนั้นจึงนำไปใช้งานได้ทันทีบนแพลตฟอร์มการประมวลผลแบบอนุมานของ Together AI

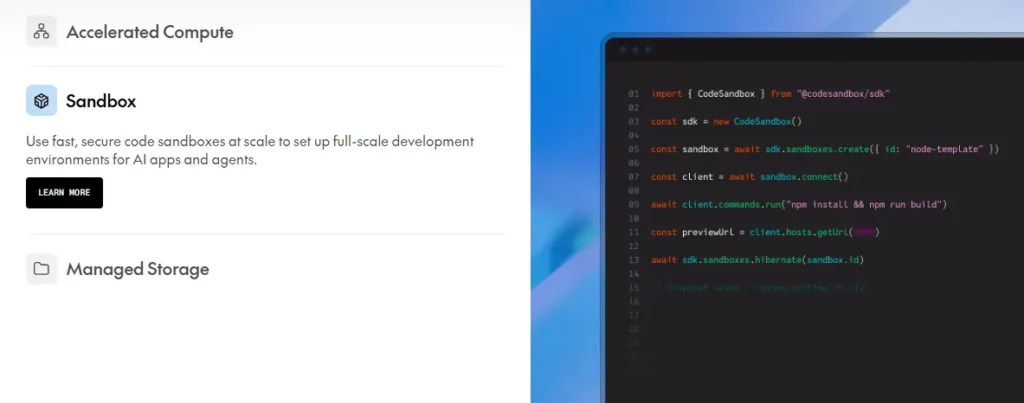

สำหรับทีมที่ต้องการทรัพยากรประมวลผลเฉพาะ Together คือคำตอบ AI บริการนี้ให้การเข้าถึง NVIDIA H100, H200, B200 และแร็ค NVL72 รุ่นล่าสุด GB200 และ GB300 ได้ทันที ราคาตามความต้องการเริ่มต้นที่ 3.49 ดอลลาร์ต่อชั่วโมงสำหรับโหนด H100 และราคาแบบจองล่วงหน้าจะลดลงเหลือ 2.55 ดอลลาร์ต่อชั่วโมงสำหรับการใช้งานระยะยาว ทำให้เป็นทางเลือกที่แข็งแกร่งแทน AWS, GCP หรือ Azure สำหรับงานฝึกอบรม ML

การย้ายข้อมูลจาก API ของ OpenAI ไปยัง Together AI ต้องเปลี่ยนแค่ URL พื้นฐานเท่านั้น แพลตฟอร์มนี้ยังมีตัวแปลโค้ดที่ทำการประมวลผลอีกด้วย รหัสที่สร้างโดย LLM ในสภาพแวดล้อมแบบแซนด์บ็อกซ์ ราคา 0.03 ดอลลาร์ต่อเซสชัน นอกจากนี้ยังมี Code Sandbox แบบเต็มรูปแบบสำหรับสภาพแวดล้อมการพัฒนาขนาดใหญ่ ซึ่งคิดค่าบริการต่อชั่วโมง vCPU

ร่วมกัน AI แผนการกำหนดราคา

| แพ็กเกจ | ราคา | รายละเอียดที่สำคัญ |

|---|---|---|

| การอนุมานแบบไร้เซิร์ฟเวอร์ | ราคา 0.02 ถึง 7.00 ดอลลาร์สหรัฐต่อ 1 ล้านโทเค็น | แตกต่างกันไปตามรุ่น โทเค็นเอาต์พุตมีราคาสูงกว่าโทเค็นอินพุต |

| จุดเชื่อมต่อเฉพาะ | เริ่มต้นที่ 3.99 ดอลลาร์สหรัฐฯ ต่อชั่วโมง | การ์ดจอแบบ Single Tenant พร้อมประสิทธิภาพที่รับประกัน |

| คลัสเตอร์ GPU (ตามความต้องการ) | $ 3.49 / ชม | คิดค่าบริการเป็นรายชั่วโมง ไม่มีข้อผูกมัด |

| คลัสเตอร์ GPU (สงวนไว้) | ค่าจ้าง 2.55 ดอลลาร์/ชั่วโมง ถึง 7.15 ดอลลาร์/ชั่วโมง | ผ่อนชำระ 1 สัปดาห์ถึง 6 เดือนขึ้นไป พร้อมส่วนลดสำหรับการซื้อจำนวนมาก |

| การปรับแต่งอย่างละเอียด (LoRA) | ราคา 0.48 ถึง 2.90 ดอลลาร์สหรัฐต่อ 1 ล้านโทเค็น | ขึ้นอยู่กับขนาดของโมเดล (สูงสุด 100B) |

| การปรับแต่งอย่างละเอียด (ฉบับเต็ม) | ราคา 0.54 ถึง 3.20 ดอลลาร์สหรัฐต่อ 1 ล้านโทเค็น | น้ำหนักทั้งหมดได้รับการอัปเดตแล้ว |

| ตัวแปลรหัส | $ 0.03 ต่อเซสชัน | การเรียกใช้โค้ดในสภาพแวดล้อมที่จำกัด |

| ระบบไฟล์ที่ใช้ร่วมกัน | 0.16 ดอลลาร์ต่อกิกะไบต์ต่อเดือน | การจัดเก็บข้อมูลแบบขนานที่มีแบนด์วิธสูง |

ร่วมกัน AI งานวิจัยและผลงานโอเพนซอร์ส

ร่วมกัน AI บริษัทนี้ไม่ได้เป็นเพียงผู้ให้บริการโครงสร้างพื้นฐานเท่านั้น แต่ยังผลักดันอย่างแข็งขันอีกด้วย AI งานวิจัยก้าวหน้าไปอย่างต่อเนื่อง ทีมงานได้สร้าง FlashAttention ซึ่งปัจจุบันเป็นกลไกความสนใจมาตรฐานที่ใช้กันอย่างแพร่หลายในอุตสาหกรรม นอกจากนี้ยังมีผลงานอื่นๆ ได้แก่ Mixture of Agents, ชุดข้อมูลเปิด Red Pajama, DeepCoder และ Open Data Scientist Agent

แนวทางการวิจัยเป็นอันดับแรกนี้หมายถึงสิ่งใหม่ล่าสุด เทคนิคการเพิ่มประสิทธิภาพ และสถาปัตยกรรมโมเดลก็พร้อมใช้งานบนแพลตฟอร์มตั้งแต่วันแรก สำหรับทีมวิศวกรรมที่ให้ความสำคัญกับการก้าวล้ำนำหน้าด้านประสิทธิภาพของโมเดล โครงการวิจัยที่กำลังดำเนินอยู่นี้จะช่วยให้ Together ก้าวไปข้างหน้า AI ความได้เปรียบทางเทคนิคที่ผู้ให้บริการคลาวด์คอมพิวติ้งทั่วไปไม่สามารถเทียบได้

ข้อดีและข้อเสีย

- มีโมเดลโอเพนซอร์สให้เลือกใช้มากกว่า 200 แบบ

- ความเร็วในการประมวลผลที่เหนือกว่าผู้นำในอุตสาหกรรม

- จุดเปิดAI การย้ายข้อมูล API ที่เข้ากันได้

- ตัวเลือกคลัสเตอร์ GPU ที่ยืดหยุ่น

- รองรับการปรับแต่งอย่างละเอียดได้อย่างดีเยี่ยม

- ใช้งาน AI ผลงานการวิจัย

- ไม่มีบริการฟรีถาวร

- เหมาะสำหรับนักพัฒนาเท่านั้น ไม่เหมาะสำหรับผู้เริ่มต้น

- การคาดการณ์ต้นทุนอาจเป็นเรื่องยาก

ดีที่สุดด้วยกัน AI ทางเลือก

| AI โครงสร้างพื้นฐาน / แพลตฟอร์ม MLOps | ประสิทธิภาพต้นทุน | ความกว้างของแบบจำลอง |

|---|---|---|

| ทำซ้ำ | คิดค่าบริการเป็นวินาที เหมาะสำหรับงานที่มีปริมาณงานไม่สม่ำเสมอ | มีโมเดลให้เลือกมากกว่า 100 แบบ เน้นการกระจายสินค้าและโมเดลสั่งทำพิเศษ |

| เปิดเราเตอร์ | รวบรวมผู้ให้บริการเพื่อให้ได้ต้นทุนต่อโทเค็นที่ต่ำที่สุด | มีโมเดลมากกว่า 200 รุ่น กระจายอยู่บนระบบแบ็กเอนด์หลายระบบ |

| ดอกไม้ไฟเอไอ | ราคาเซิร์ฟเวอร์เลสที่แข่งขันได้ การประมวลผลที่รวดเร็ว | มุ่งเน้นไปที่หลักสูตร LLM แบบโอเพนซอร์สชั้นนำ |

| จุดสิ้นสุดการอนุมานใบหน้ากอด | มีบริการแบบฟรี และสามารถปรับใช้งานได้อย่างยืดหยุ่น | ศูนย์รวมโมเดลโอเพนซอร์สที่ใหญ่ที่สุด |