tillsammans AI Viktiga insikter

Vad är Together AI?

Tillsammans AI är en full stack AI Molnplattform byggd för utvecklare och ML-ingenjörer som behöver snabb och kostnadseffektiv åtkomst till stora språkmodeller med öppen källkod. Plattformen grundades 2020 och erbjuder serverlös inferens, finjustering av modeller, dedikerade GPU-slutpunkter och GPU-kluster på begäran, allt under ett tak. Den stöder över 200 modeller från familjer inklusive Llama 4, DeepSeek V3, Qwen 3.5, Mistral och FLUX för bildgenerering.

tillsammans AI tar bort bördan av att hantera GPU-infrastruktur så att team kan fokusera på att bygga AI inbyggda applikationer. Det är öppetAI kompatibelt API innebär att befintliga kodbaser kan migreras med minimala ändringar. För företag som vill köra hög volym AI arbetsbelastningar till en bråkdel av proprietära API-kostnader, tillsammans AI har en stark position som leverantör av inferens och utbildning i produktionsklass.

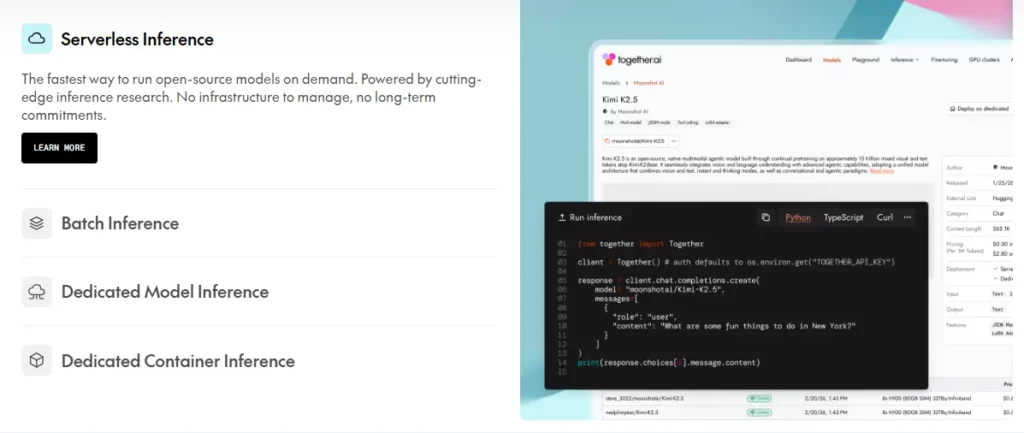

tillsammans AI värdar över 200 modeller med öppen källkod som omfattar text, bild, video, ljud, inbäddningar och kodgenerering. Utvecklare kan anropa vilken modell som helst via ett enda API utan att provisionera servrar. Modeller som Llama 4 Maverick kostar ungefär 0.27 dollar per miljon indatatokens, vilket gör högvolymsproduktionsarbetsbelastningar betydligt billigare än proprietära alternativ. Plattformen inkluderar också ett batch-API för icke-brådskande jobb till reducerad kostnad.

Tillsammans använder AI:s egenutvecklade inferensmotor FlashAttention 3 och ATLAS-spekulatorsystemet för att leverera upp till 3.5 gånger snabbare inferens än standardimplementeringar. På NVIDIA H100-hårdvara uppnår detta cirka 840 TFLOPs/s med BF16-precision. Det verkliga resultatet är cirka 400 tokens per sekund i produktion, ungefär 2.5 till 4 gånger snabbare än GPT 4 Turbo-utgångshastigheter.

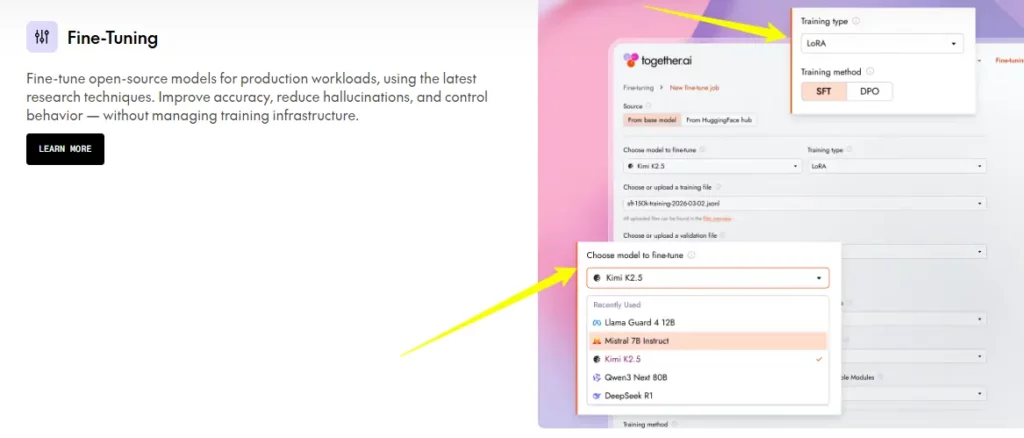

Plattformen stöder både LoRA (Low Rank Adaptation) och fullviktsfinjustering för modeller upp till 100 miljarder parametrar. Priset börjar på 0.48 dollar per miljon tokens för LoRA på modeller upp till 16 miljarder. Team kan träna modeller på proprietär data för att skapa uppgiftsspecifika system för juridiska, medicinska eller... kundsupportapplikationer och sedan distribuera dem direkt på Together AI:s inferensstack.

För team som behöver dedikerad databehandling, Tillsammans AI erbjuder omedelbar åtkomst till NVIDIA H100, H200, B200 och de senaste GB200- och GB300 NVL72-racken. Priserna för on-demand börjar på 3.49 dollar per timme för en H100-nod, medan reserverade priser sjunker till 2.55 dollar per timme vid längre åtaganden. Detta gör det till ett starkt alternativ till AWS, GCP eller Azure för ML-utbildningsarbetsbelastningar.

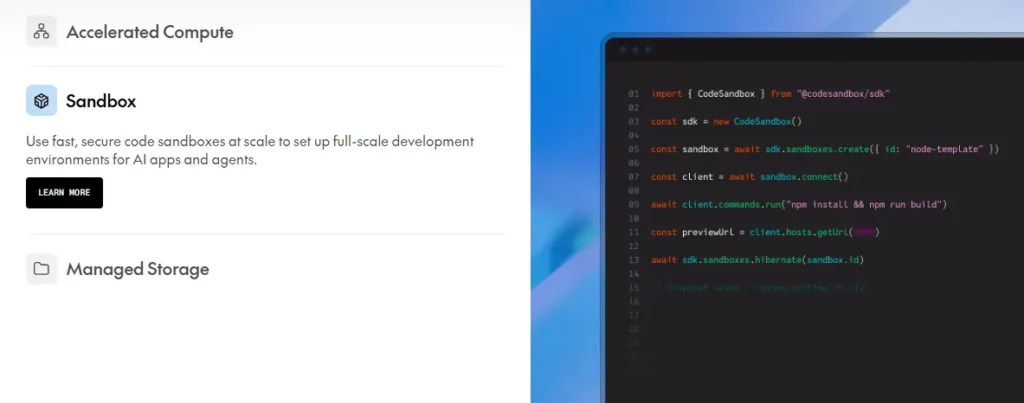

Migrering från OpenAI:s API till Together AI kräver endast en ändring av bas-URL. Plattformen tillhandahåller också en kodtolk som kör LLM-genererad kod i sandlådemiljöer för 0.03 USD per session, plus en fullständig kodsandlåda för större utvecklingsmiljöer fakturerad per vCPU-timme.

tillsammans AI Prissättning planer

| Plan | Pris | nyckel Detaljer |

|---|---|---|

| Serverlös slutledning | 0.02 till 7.00 dollar per 1 miljon tokens | Varierar beroende på modell. Utdatatokens kostar mer än indata. |

| Dedikerade slutpunkter | Från 3.99 USD/timme | GPU med en enda hyresgäst och garanterad prestanda |

| GPU-kluster (på begäran) | $ 3.49 / hr | Timfakturering, ingen bindningstid |

| GPU-kluster (reserverade) | 2.55 USD/timme till 7.15 USD/timme | 1 vecka till 6+ månaders villkor med volymrabatter |

| Finjustering (LoRA) | 0.48 till 2.90 dollar per 1 miljon tokens | Baserat på modellstorlek (upp till 100B) |

| Finjustering (fullständig) | 0.54 till 3.20 dollar per 1 miljon tokens | Alla vikter uppdaterade |

| Kodtolk | 0.03 XNUMX $ per session | Sandbox-kodkörning |

| Delat filsystem | 0.16 USD per GiB/månad | Parallell lagring med hög bandbredd |

tillsammans AI Forskning och bidrag med öppen källkod

tillsammans AI är inte bara en infrastrukturleverantör. Företaget driver aktivt AI forskning framåt. Dess team skapade FlashAttention, som nu är standardmekanismen för uppmärksamhet som används i hela branschen. Andra bidrag inkluderar Mixture of Agents, de öppna datamängderna Red Pajama, DeepCoder och Open Data Scientist Agent.

Denna forskningsbaserade metod innebär den senaste optimeringstekniker och modellarkitekturer finns tillgängliga på plattformen från dag ett. För ingenjörsteam som värdesätter att ligga i framkant när det gäller modellprestanda ger denna pågående forskningspipeline Together AI en teknisk fördel som rena molnberäkningsåterförsäljare helt enkelt inte kan matcha.

För-och nackdelar

- 200+ modeller med öppen källkod tillgängliga.

- Branschledande inferenshastighet.

- ÖppetAI kompatibel API-migrering.

- Flexibla GPU-klusteralternativ.

- Starkt stöd för finjustering.

- Aktiva AI forskningsbidrag

- Ingen permanent gratisnivå.

- Endast för utvecklare, inte nybörjarvänlig.

- Kostnadsprognoser kan vara svåra.

Bäst tillsammans AI alternativ

| AI Infrastruktur/MLOps-plattform | Kostnadseffektivitet | Modellbredd |

|---|---|---|

| Återskapa | Betala per sekund, bra för höga arbetsbelastningar | 100+ modeller, starka på diffusion och specialanpassade modeller |

| ÖppnaRouter | Aggregerar leverantörer för lägsta kostnad per token | 200+ modeller över flera backends |

| Fireworks AI | Konkurrenskraftiga serverlösa priser, snabb inferens | Fokuserad på de bästa LLM-programmen med öppen källkod |

| Slutpunkter för inferens för kramande ansikten | Gratisnivå tillgänglig, flexibel distribution | Största modellhubben för öppen källkod |