Principais insights do Hugging Face

O que é cara de abraço?

Abraçando o rosto é uma fonte aberta AI Plataforma de colaboração que funciona como repositório central para modelos de aprendizado de máquina, conjuntos de dados e ferramentas de implantação. Ela oferece a cientistas de dados, engenheiros de aprendizado de máquina e AI As equipes de produto têm acesso instantâneo a mais de 500,000 modelos pré-treinados em geração de texto, visão computacional, reconhecimento de fala e tarefas multimodais.

Construída sobre uma infraestrutura baseada em Git, a plataforma permite que as equipes controlem as versões dos pesos dos modelos, compartilhem conjuntos de dados de treinamento e façam implantações em produção. AI Demonstrações via Spaces em minutos. Para empresas prédio AI produtosA Hugging Face elimina a sobrecarga de infraestrutura da gestão de registros de modelos privados e fornece hospedagem pronta para produção, uma API de inferência e fluxos de trabalho colaborativos que aceleram todo o ciclo de vida do desenvolvimento de modelos, da pesquisa ao lançamento.

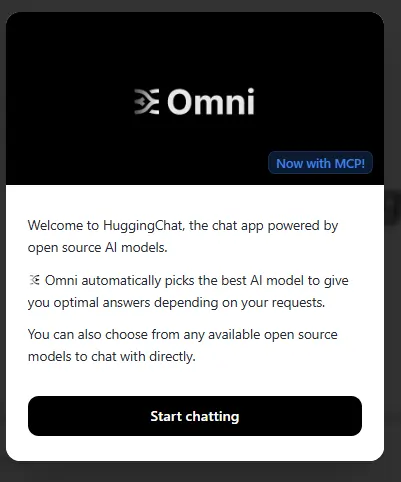

HuggingChat é Hugging Face's próprio, gratuito e de código aberto AI Interface de bate-papo que dá acesso a mais de 119 modelos de código aberto, incluindo Llama, Mistral e Qwen, por meio de uma plataforma única e unificada. Inclui busca na web integrada para localização em tempo real, suporte a MCP para acessar ferramentas externas durante a conversa e um recurso de Ferramentas da Comunidade que permite conectar qualquer Espaço Hugging Face público diretamente ao bate-papo.

O AutoTrain elimina a necessidade de escrever roteiros de treinamento complexos Ao adaptar um modelo pré-treinado a um conjunto de dados personalizado, você carrega os dados rotulados, seleciona um modelo base, configura os hiperparâmetros por meio de uma interface intuitiva e a plataforma cuida do treinamento distribuído automaticamente. Na prática, o ajuste fino de um classificador BERT via AutoTrain levou menos de 15 minutos, em comparação com as 3 horas ou mais necessárias para a configuração manual do ciclo de treinamento. Para equipes sem engenheiros de infraestrutura de aprendizado de máquina dedicados, isso representa um ganho significativo em termos de capacidade.

O Spaces permite que as equipes implementem aplicativos Gradio ou Streamlit diretamente de scripts Python, com a plataforma gerenciando automaticamente a conteinerização, os certificados HTTPS e o escalonamento automático. Um exemplo em funcionamento. análise de sentimentos A demonstração pode estar online em menos de uma hora. O suporte integrado ao OAuth, o gerenciamento de segredos e o armazenamento persistente eliminam grande parte da carga de configuração do DevOps. Para demonstrações para clientes, provas de conceito ou ferramentas internas de aprendizado de máquina, este é um dos recursos mais produtivos da plataforma.

Todos os modelos e conjuntos de dados da Hugging Face são armazenados em um repositório Git com suporte a LFS para arquivos binários grandes. Isso significa que as equipes têm acesso ao histórico completo de versões, ramificações, solicitações de pull e revisão colaborativa para pesos e configurações do modelo, e não apenas para o código de treinamento. Isso traz a devida disciplina de engenharia de software para o gerenciamento de ativos de aprendizado de máquina, permitindo que as equipes acompanhem experimentos, revertam pontos de verificação e aceitem contribuições da comunidade por meio de solicitações de pull.

A biblioteca Accelerate permite que as equipes executem treinamento distribuído em várias GPUs e TPUs com alterações mínimas de código. GPU única padrão O script de treinamento pode ser adaptado para treinamento distribuído em múltiplos nós com cerca de cinco linhas de código. Isso é crucial para equipes que trabalham com grandes modelos de linguagem ou pipelines de visão computacional de alto volume, onde o treinamento em um único dispositivo não é viável em produção.

A plataforma oferece suporte nativo a PyTorch, TensorFlow, JAX, Scikit-learn e ONNX, com detecção automática de bibliotecas que permite executar o mesmo modelo em diferentes ambientes sem modificações. A biblioteca Optimum adiciona otimização de modelos de produção, incluindo conversão ONNX e quantização, o que pode reduzir a latência de inferência em até 40%. Para equipes que implantam em infraestruturas diversas, essa portabilidade entre plataformas é essencial.

Planos de preços para abraçar o rosto

| Nome do Plano | Custo | Principais limitações/funcionalidades |

|---|---|---|

| Comunidade | Gratuito | Hospedagem pública ilimitada, 100 GB de armazenamento, API de inferência, implantação no Spaces, 10 mil chamadas de API por dia. |

| Conta PRO | $ 9 / mês | Armazenamento aprimorado, créditos de inferência dedicados de US$ 50 ou mais, repositórios privados, hospedagem prioritária no Spaces. |

| Time | US $ 20 / usuário / mês | Todos os recursos PRO, além de SSO, controle de acesso baseado em funções, análises de uso e repositórios privados colaborativos. |

| Empreendimento | A partir de US$ 50/usuário/mês | Conformidade com SOC2/HIPAA, suporte dedicado, garantias de SLA, controles de acesso avançados, armazenamento personalizado. |

Prós e Contras

- Mais de 500,000 modelos pré-treinados disponíveis.

- O AutoTrain não exige nenhum conhecimento de programação.

- Suporta nativamente todas as principais bibliotecas de aprendizado de máquina.

- Controle de versão baseado em Git para ativos de modelos.

- Implantação do Spaces pronta para produção incluída.

- Documentação e tutoriais de nível internacional.

- Curva de aprendizado acentuada para iniciantes em aprendizado de máquina.

- Aplicam-se limites de taxa à API do nível gratuito.

- A cobertura do modelo de aprendizado por reforço apresenta defasagens.

Vale a pena investir em estratégias de suporte em vez de montar sua própria estratégia?

Equipes que consideram construir seu próprio registro de modelos, pipeline de inferência e infraestrutura de implantação devem levar em conta o custo real antes de descartar o Hugging Face. Configurar recursos equivalentes com hospedagem Git LFS privada, endpoints de inferência em contêineres, controle de acesso e documentação de modelos normalmente consome 40 horas ou mais de desenvolvimento por mês em manutenção.

Com um custo de US$ 9 a US$ 20 por usuário por mês, o Hugging Face oferece retorno sobre o investimento imediato em comparação com qualquer alternativa auto-hospedada. A única situação em que uma infraestrutura personalizada se destaca é quando requisitos de infraestrutura altamente proprietários não podem ser atendidos por nenhuma plataforma gerenciada.

Melhores alternativas para o rosto de abraço

| Plataforma de Colaboração de IA/ML de Código Aberto | Acesso ao modelo de código aberto | Portabilidade de Implantação |

|---|---|---|

| AWS SageMaker | Limitado a modelos hospedados e selecionados pela AWS | Integração profunda com a AWS, mas que introduz dependência do fornecedor. |

| Pesos e desvios | Focado no rastreamento de experimentos, sem biblioteca de modelos pública. | Ferramentas robustas de MLOps, mas sem camada de hospedagem integrada. |

| Google Vertex AI | Jardim modelo selecionado pelo Google com variedade limitada de código aberto | Integração restrita ao GCP com flexibilidade limitada de exportação |