Você escreve um script. Ele funciona perfeitamente em um site de teste. Então, você o direciona para um grande varejista ou uma plataforma de mídia social. De repente, seu terminal é inundado com erros 403 Forbidden ou loops infinitos de CAPTCHA.

A era da simples análise sintática de HTML acabou.

A extração de dados da web moderna exige mais do que simplesmente enviar uma solicitação GET. Os sites atuais são aplicativos complexos protegidos por defesas robustas. Se você quiser contornar bloqueios de extração de dados da webVocê precisa entender como os navegadores se comunicam com os servidores.

Grandes plataformas como Cloudflare, Akamai e Datadome atuam como intermediárias. Elas analisam cada conexão recebida e verificam se você é um humano ou um script. Para ultrapassá-las, você precisa de ferramentas que imitem o comportamento humano com perfeição.

Vamos te mostrar como extrair dados de sites dinâmicos De forma eficaz, e por que delegar essas tarefas à Decodo é a decisão mais inteligente para o seu fluxo de dados.

A Necessidade “Sem Cabeça”: Por que as Requisições Simples Falham

Antigamente, os sites enviavam páginas HTML completas do servidor. Seu script baixava o texto e você extraía os dados.

Agora, mais de 70% dos modernos sites de comércio eletrônico dependem da renderização do lado do cliente (CSR). Quando você solicita uma URL, o servidor envia um HTML vazio. O conteúdo real — preços, estoque, descrições — é carregado posteriormente via JavaScript.

Se você usar uma biblioteca HTTP padrão, obterá apenas uma estrutura vazia. Você perderá os dados por completo.

Para visualizar o conteúdo, você precisa renderização em JavaScript para extração de dadosIsso geralmente significa executar um navegador como o Chrome ou o Firefox em segundo plano, sem uma interface gráfica. Isso é conhecido como "headless" (sem interface gráfica). raspagem de navegador.

Executar navegadores sem interface gráfica consome muitos recursos. Isso consome RAM e CPU em excesso. Além disso, introduz um novo problema: a detecção.

Decifrando o código dos sistemas anti-robôs

Os sistemas de segurança não se limitam a analisar o seu Endereço IPEles inspecionam o comportamento do seu navegador.

Se você usar uma biblioteca de automação padrão, ela deixará rastros. Pode ser que ela defina uma variável como `navigator.webdriver = true`. Isso é um sinal revelador. Sistemas anti-bot detectam essa flag e bloqueiam você imediatamente.

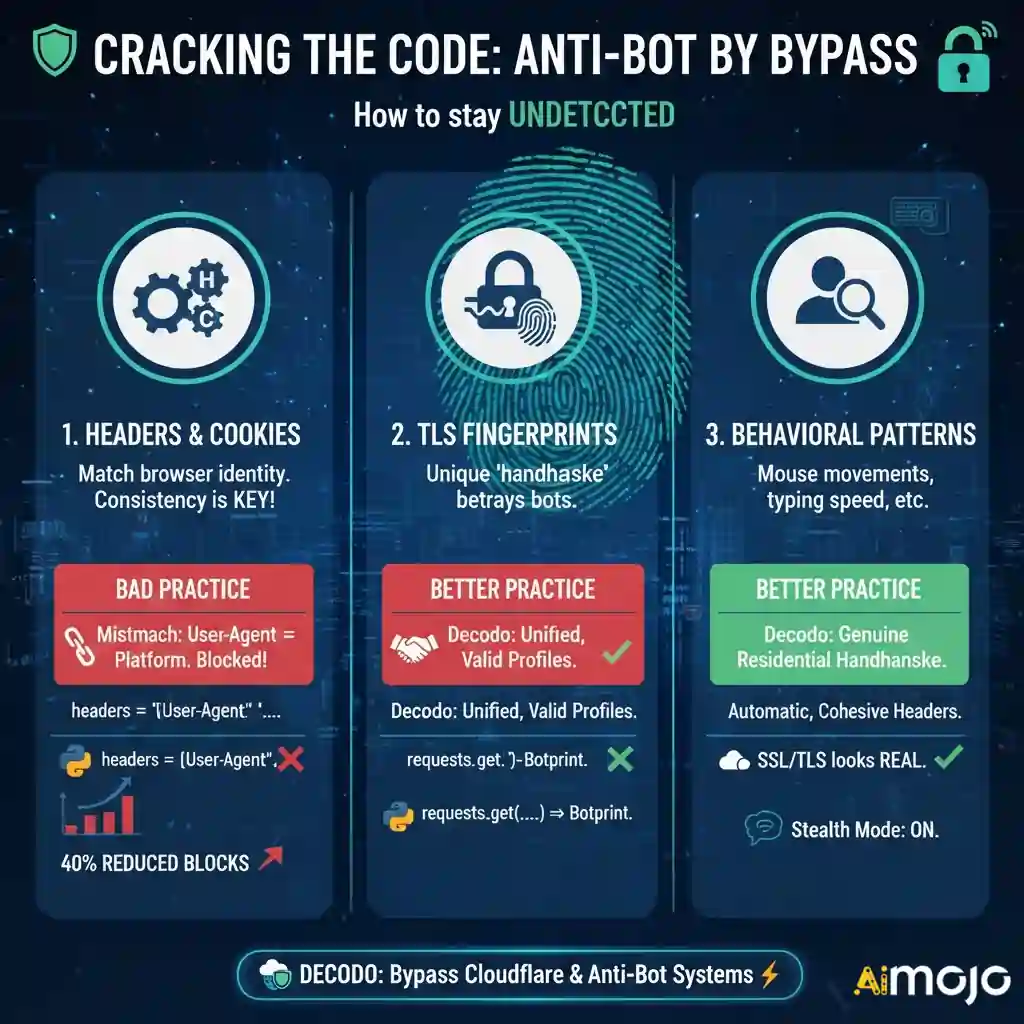

Para contornar a coleta de dados do Cloudflare Para garantir a proteção, você precisa gerenciar três camadas críticas:

1. Por que a correspondência de cabeçalhos é importante na extração de dados da web

Os cabeçalhos da sua requisição informam ao servidor quem você é. O mais conhecido deles é o User-Agent. No entanto, simplesmente alterar a string do seu User-Agent não é suficiente.

Os cabeçalhos devem funcionar como uma unidade coesa. Se você enviar um User-Agent que alega ser do Chrome no Windows, mas seus cabeçalhos de plataforma forem do Linux, você será bloqueado. Essa incompatibilidade é um dos principais motivos para falhas na coleta de dados.

Gerenciar corretamente os cabeçalhos de requisição pode reduzir as taxas de bloqueio em até 40%, mesmo antes de você trocar de proxy.

# Isso geralmente é bloqueado imediatamente

pedidos de importação

cabeçalhos = {'User-Agent': 'Mozilla/5.0'}

resposta = requests.get('https://example.com', headers=headers)

Decodo constrói automaticamente registros válidos e consistentes. perfis de cabeçalhoIsso garante que suas dicas de Accept-Language, Referer e plataforma correspondam à versão do navegador que você está imitando.

2. A Armadilha Oculta: Impressão Digital TLS

É aqui que a maioria dos scrapers personalizados falha.

Quando seu script inicia uma conexão HTTPS segura, ele realiza um "aperto de mãos" com o servidor. A ordem e os parâmetros desse aperto de mãos criam uma impressão digital única, geralmente chamada de hash JA3.

A biblioteca requests do Python tem um processo de autenticação muito diferente de um servidor real. Navegador ChromeO Cloudflare detecta essa diferença instantaneamente. Mesmo que seus cabeçalhos estejam perfeitos, seu bypass de impressão digital tl A estratégia pode falhar se o aperto de mão o denunciar.

A Decodo lida com isso nos bastidores. Ela modifica a negociação SSL/TLS de baixo nível para que pareça exatamente como a de um usuário legítimo navegando a partir de uma conexão residencial.

Melhores táticas para extrair dados de aplicativos de página única com segurança

Aplicativos de página única (SPAs) São notoriamente difíceis de extrair dados. Elas carregam os dados de forma assíncrona. Um programa de extração de dados pode até mesmo iniciar o carregamento da página, mas se extrair os dados muito cedo, não obterá nada.

Você precisa extrair dados de sites de spas aguardando o estado "Rede Ociosa". Isso significa que o navegador espera até que todas as chamadas de API em segundo plano sejam concluídas antes de obter o HTML.

Implementar isso manualmente com ferramentas como Puppeteer ou Selenium é instável. Os scripts travam. Os elementos têm seus nomes de ID alterados. Vazamentos de memória tornam o servidor mais lento.

Decodo's Raspagem da web A API simplifica isso. Você envia uma solicitação e o Decodo inicia o navegador, renderiza o JavaScript, aguarda a estabilização da rede e retorna o HTML limpo.

Crie fluxos de trabalho de scraping escaláveis e indetectáveis com o Decodo.

Criar uma rede de raspagem de dados de navegadores sem interface gráfica é caro. É preciso corrigir os drivers do Chrome, rotacionar milhares de IPs e atualizar constantemente o código quando o Cloudflare altera seu algoritmo.

A Decodo oferece um serviço especializado. raspagem automatizada de navegador Infraestrutura que suporta o trabalho pesado.

Principais características para evasão

A plataforma foi construída para contornar bloqueios de extração de dados da web Ao focar na imitação e na confiabilidade:

Guia de integração rápida: usando a API de raspagem da Decodo

Veja como é simples migrar de um script local bloqueado para o Decodo. Você não precisa gerenciar o navegador manualmente.

import requests

# Decodo API Endpoint

url = "https://api.decodo.com/v1/scrape"

payload = {

"url": "https://difficult-site.com/products",

"render_js": True, # Activates Headless Browser

"wait_for_selector": ".product-price", # Waits for dynamic content

"country": "US" # Uses premium US residential proxies

}

headers = {

"Authorization": "Bearer YOUR_DECODO_API_KEY",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

if response.status_code == 200:

print("Scraping Successful!")

print(response.json()['content'])

else:

print("Error:", response.text)Repare na simplicidade. Você não está importando o Selenium. Você não está baixando o Chromedriver. Você simplesmente diz ao Decodo: “Preciso desta URL e, por favor, renderize-a.” JavaScript. "

Escolhendo entre as APIs Puppeteer, Selenium ou Decodo

Muitos desenvolvedores começam com ferramentas de código aberto. É útil entender as vantagens e desvantagens de usar Puppeteer, Selenium e APIs.

Selênio: Ótimo para testes, mas lento e facilmente detectado. Requer modificações significativas para evitar detecção anti-robô gatilhos de evasão.

Marionetista/Dramaturgo: Mais rápido e melhor para renderização de JavaScript em web scraping. No entanto, manter uma frota dessas instâncias exige conhecimento significativo de DevOps. Você ainda terá que resolver manualmente os problemas de proxy e fingerprinting.

API Decodo: O caminho mais eficiente. Ele oferece o poder de um navegador sem interface gráfica sem a necessidade de manutenção. Resolve automaticamente os problemas de bypass de fingerprinting TLS e gerenciamento de cabeçalhos.

Com a API Decodo, as equipes economizam tempo de desenvolvimento, reduzem os custos de infraestrutura e alcançam taxas de sucesso de extração de dados mais altas em sites modernos e complexos.

Raspe de forma inteligente, não com esforço: deixe a Decodo cuidar disso.

A internet está se tornando cada vez mais fechada. A evasão de sistemas anti-bot é uma corrida armamentista. Se você gasta seu tempo de engenharia lutando contra o Cloudflare, não está gastando tempo analisando seus dados.

Você não precisa construir uma infraestrutura complexa para extrair dados de sites dinâmicosAo usar o Decodo, você obtém acesso a raspagem de navegador headless de nível empresarial, gerenciamento de sessão adequado e rotação avançada de impressões digitais.

Pare de ser bloqueado. Deixe que a Decodo lide com as complexidades do navegador enquanto você se concentra nas informações.

AiMojo recomenda:

BONUS: Receba nossos $ 200 “AI “Kit de ferramentas de domínio” GRÁTIS ao se inscrever!

BONUS: Receba nossos $ 200 “AI “Kit de ferramentas de domínio” GRÁTIS ao se inscrever!

![7 Melhor Gratuito AI Geradores Humanos em 2026 [Revisado e Classificado]](https://aimojo.io/wp-content/uploads/2023/11/Best-Free-AI-Human-Generator-100x100.webp)