A fusão de Meta's Modelos Llama 4 com Microsoft's A estrutura AutoGen abre novas possibilidades para a criação de sistemas inteligentes e eficientes AI Agentes. Essas tecnologias, quando combinadas, permitem que os desenvolvedores criem aplicativos capazes de processar linguagem natural, compreender imagens, raciocinar sobre problemas complexos e colaborar com outros agentes para realizar tarefas.

lhama 4 traz capacidades multimodais impressionantes e janelas de contexto extensas, enquanto Geração automática fornece uma estrutura para orquestrar múltiplos agentes em fluxos de trabalho colaborativos. Juntos, eles formam um poderoso kit de ferramentas para a próxima geração AI aplicações.

Este guia explica o processo de prédio AI agentes que usam essas ferramentas, com exemplos práticos de código e estratégias de implementação para desenvolvedores de todos os níveis de habilidade.

O que faz o lhama 4 e Geração automática a combinação perfeita?

Meta's A família Llama 4 se destaca no AI mundo com seu capacidades multimodais nativas e a abordagem de fusão precoce. Quando combinado com AutoGen—Microsoft's estrutura para construção de sistemas multiagentes conversacionais—os desenvolvedores podem criar AI agentes que raciocinam, colaboram e se adaptam eficientemente.

Os modelos Llama 4, incluindo as variantes Scout e Maverick, oferecem processamento multimodal de fusão precoce que trata texto, imagens e quadros de vídeo como uma única sequência de tokens desde o início. Esse recurso, combinado com o AutoGen's arquitetura de agente flexível, permite a criação de AI sistemas que pode:

Deixei's crie um sistema multiagente prático que demonstre essas capacidades criando um gerador de propostas de projeto que analise os requisitos do cliente e gere propostas de trabalho personalizadas.

Construindo uma Prática AI Sistema Agente

Deixei's Criar um sistema multiagente que ajude freelancers a gerar propostas de trabalho personalizadas. Nosso sistema irá:

- Coletar requisitos do cliente

- Reúna as qualificações do freelancer

- Gere propostas profissionais com preços adequados.

Etapa 0: configurando seu ambiente

Primeiro, instale os pacotes necessários:

python

pip install autogen-agentchat~=0.2

pip instalar ipython

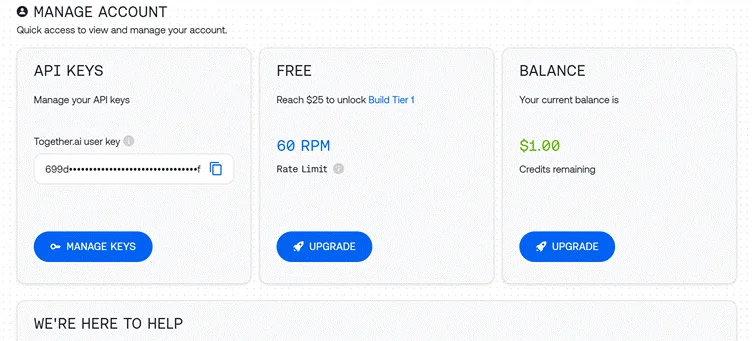

Etapa 1: Configurando o acesso à API

Usaremos a API Together para acessar o Llama 4:

python

import os

import autogen

from IPython.display import display, Markdown

# Load API key from file

with open("together_ai_api.txt") as file:

LLAMA_API_KEY = file.read().strip()

os.environ["LLAMA_API_KEY"] = LLAMA_API_KEY

# Configure LLM settings

llm_config = {

"config_list": [

{

"model": "meta-llama/Llama-4-Scout", # Use Scout for efficiency

"api_key": os.environ.get("LLAMA_API_KEY"),

"base_url": "https://api.together.xyz/v1",

}

],

"temperature": 0.2, # Lower for more consistent outputs

"timeout": 180

}Etapa 2: Criação de agentes especializados

Nosso sistema requer três agentes distintos com funções específicas:

Agente de entrada do cliente

python

# Agent 1: Interfaces with the human user

client_agent = autogen.UserProxyAgent(

name="Client_Input_Agent",

human_input_mode="ALWAYS", # Always gets input from human

max_consecutive_auto_reply=1,

is_termination_msg=lambda x: x.get("content", "").rstrip().endswith("TERMINATE"),

system_message="""Act as the primary contact between the human user and other agents.

First, collect initial project details (requirements, timeline, budget).

When asked questions by the Scope Architect, relay user's answers about skills and experience.

Type TERMINATE when the proposal is satisfactory or the user wants to stop."""

)Este agente serve como ponte entre o usuário humano e o AI sistema, coleta de informações e apresentar o resultado final.

Agente de Arquiteto de Escopo

python

# Agent 2: Analyzes requirements and asks qualifying questions

scope_architect_agent = autogen.AssistantAgent(

name="Scope_Architect",

llm_config=llm_config,

max_consecutive_auto_reply=1,

system_message="""You are a Scope Architect who analyzes project requirements.

After receiving initial details from Client_Input_Agent, ask targeted questions about:

- The freelancer's relevant past projects and experience

- Their key skills and tools for this specific project

- Estimated completion time for the described work

Once you have sufficient information, create a concise summary of BOTH

the project requirements AND freelancer qualifications for the Rate Recommender."""

)O Arquiteto de Escopo funciona como analista de requisitos, reunindo informações cruciais necessárias para uma proposta precisa.

Agente de recomendação de taxas

python

# Agent 3: Creates structured proposal with pricing

rate_recommender_agent = autogen.AssistantAgent(

name="Rate_Recommender",

llm_config=llm_config,

max_consecutive_auto_reply=1,

system_message="""Generate professional project proposals based on gathered information.

Wait for the Scope Architect's complete summary before proceeding.

Include these sections in your proposal:

1. Custom Introduction: Personalized greeting referencing client and project

2. Project Scope & Timeline: Clear deliverables with timeline estimates

3. Pricing Options: 2-3 tiers (hourly/fixed/retainer) with justification

4. Next Steps: Brief suggestion for kickoff discussion

Format using proper markdown. Avoid commentary - deliver only the final proposal."""

)Este agente produz o produto final, transformando as informações coletadas em uma proposta estruturada.

Etapa 3: Criando um Agente Auxiliar (Opcional)

python

# Optional helper to initiate the conversation

user_proxy = autogen.UserProxyAgent(

name="user_proxy",

max_consecutive_auto_reply=1,

llm_config=llm_config,

system_message="Initiate the conversation between agents."

)Etapa 4: Configurando o bate-papo em grupo

Agora criaremos o ambiente de conversa onde os agentes podem colaborar:

python

# Group Chat Configuration

groupchat = autogen.GroupChat(

agents=[client_agent, scope_architect_agent, rate_recommender_agent],

messages=[],

max_round=4, # Prevent infinite loops

speaker_selection_method="round_robin", # Orderly participation

)

# Conversation Manager

manager = autogen.GroupChatManager(

groupchat=groupchat,

llm_config=llm_config,

system_message="""Direct the conversation flow through these steps:

1. Client_Input_Agent shares project details

2. Scope_Architect asks qualifying questions

3. Client_Input_Agent provides freelancer information

4. Scope_Architect summarizes all information

5. Rate_Recommender creates the final proposal

End when the proposal is complete or Client_Input_Agent says TERMINATE."""

)Esta configuração garante uma conversa organizada fluxo com funções e responsabilidades claras.

Etapa 5: Iniciando a conversa

Deixei's iniciar nosso fluxo de trabalho de agente:

python

# Begin the proposal generation process

print("Starting the proposal generation process...")

print("Please provide project details when prompted.")

initial_message = """

Begin the proposal creation process:

1. First collect project details from the user

2. Then gather freelancer qualifications

3. Finally generate a professional proposal

"""

user_proxy.initiate_chat(

manager,

message=initial_message

)Etapa 6: Extração da Proposta Final

Assim que a conversa for concluída, extrairemos e exibiremos a proposta final:

python

# Find and display the proposal

chat_history = manager.chat_messages[client_agent]

final_proposal = None

for msg in reversed(chat_history):

if msg.get("role") == "assistant" and msg.get("name") == rate_recommender_agent.name:

if "Introduction" in msg.get("content", ""):

final_proposal = msg

break

if final_proposal:

proposal_text = final_proposal.get("content", "Proposal not found.")

try:

display(Markdown(proposal_text))

except NameError:

print("\n--- FINAL PROPOSAL ---\n")

print(proposal_text)

else:

print("Could not find the final proposal in the conversation.")Técnicas aprimoradas para construir melhor AI Agentes

Embora nossa implementação básica funcione bem, aqui estão algumas abordagens avançadas para tornar sua AI agentes mais poderosos:

A.Integração de ferramentas externas

Um dos AutoGen's um ponto forte é a capacidade de equipar os agentes com ferramentas externas. Aqui's como dar seu Recomendador de Taxas pesquisa de mercado capacidades:

python

# Define function for market research

def research_market_rates(job_type, experience_level):

"""Access external data for pricing information"""

# This would typically connect to an API or database

# Using simple dictionary for demonstration

rate_data = {

"web_development": {

"beginner": "$30-50/hr",

"intermediate": "$50-90/hr",

"expert": "$90-200/hr"

},

"data_analysis": {

"beginner": "$25-45/hr",

"intermediate": "$45-85/hr",

"expert": "$85-180/hr"

}

}

# Retrieve appropriate rate range

try:

return rate_data[job_type][experience_level]

except KeyError:

return "Rate information not available for this combination"

# Configure LLM with function

rate_recommender_config = {

**llm_config,

"functions": [

{

"name": "research_market_rates",

"description": "Find current market rates for specific job types and experience levels",

"parameters": {

"type": "object",

"properties": {

"job_type": {

"type": "string",

"enum": ["web_development", "data_analysis", "content_writing", "graphic_design"]

},

"experience_level": {

"type": "string",

"enum": ["beginner", "intermediate", "expert"]

}

},

"required": ["job_type", "experience_level"]

}

}

]

}

# Update the Rate Recommender with function capabilities

rate_recommender_agent = autogen.AssistantAgent(

name="Rate_Recommender",

llm_config=rate_recommender_config,

system_message="""Generate proposals with accurate market-based pricing.

Use the research_market_rates function to get current pricing information."""

)

# Register the function with the agent

rate_recommender_agent.register_function(

function_map={"research_market_rates": research_market_rates}

)Esse aprimoramento permite que o recomendador de tarifas acesse dados de preços externos, tornando propostas mais precisas e competitivas.

B. Implementação de Memória Persistente

Adicionar recursos de memória ajuda os agentes a manter o contexto em múltiplas interações:

python

# Create a simple memory system for agents

class AgentMemory:

def __init__(self):

self.memories = {}

def store(self, agent_name, key, value):

"""Save information to agent memory"""

if agent_name not in self.memories:

self.memories[agent_name] = {}

self.memories[agent_name][key] = value

def retrieve(self, agent_name, key=None):

"""Get information from agent memory"""

if agent_name not in self.memories:

return None

if key:

return self.memories[agent_name].get(key)

else:

return self.memories[agent_name]

# Initialize memory

memory = AgentMemory()

# Example of storing client information

def process_client_input(message):

"""Extract and store client information"""

# This would typically use more sophisticated parsing

if "budget:" in message.lower():

budget = message.split("budget:")[1].strip().split("\n")[0]

memory.store("client", "budget", budget)

if "timeline:" in message.lower():

timeline = message.split("timeline:")[1].strip().split("\n")[0]

memory.store("client", "timeline", timeline)

return message

# Add memory hook to client agent

def memory_hook(recipient, messages, sender, config):

"""Process and store incoming messages"""

if sender.name == "Client_Input_Agent" and messages:

process_client_input(messages[0].get("content", ""))

return False, None # Continue normal processing

# Register the hook

client_agent.register_hook("memory_hook", memory_hook)Este sistema de memória ajuda os agentes a lembrar informações importantes ao longo da conversa, mesmo quando não mencionadas explicitamente em mensagens recentes.

Aplicações práticas além da geração de propostas

A arquitetura que construímos pode ser adaptada a muitos outros cenários de negócios:

A. Pipeline de criação de conteúdo

Modifique nossos agentes para lidar com fluxos de trabalho de produção de conteúdo:

B. Sistema de Análise de SEO

Crie uma ferramenta de SEO especializada com estes agentes:

C. Automação de Suporte ao Cliente

Transforme a arquitetura em um sistema de suporte:

Dicas de otimização de desempenho

Para produção pronta AI sistemas de agentes:

- Seleção de modelo inteligente: Use modelos leves para tarefas mais simples (entrada, roteamento) e reserve modelos maiores para raciocínio complexo (criação de propostas, precificação).

- Implementar cache: Armazene respostas frequentes para reduzir chamadas de API e melhorar o tempo de resposta:

python

# Simple cache implementation

response_cache = {}

def get_cached_response(query_key, generator_function, ttl=3600):

"""Get cached response or generate new one"""

if query_key in response_cache:

timestamp, response = response_cache[query_key]

if time.time() - timestamp < ttl:

return response

# Generate fresh response

new_response = generator_function()

response_cache[query_key] = (time.time(), new_response)

return new_responseProcessamento em lote: Para tarefas independentes, processe-as em paralelo em vez de sequencialmente:

python

import asyncio

async def run_parallel_research():

task1 = asyncio.create_task(research_agent.async_run("Research topic A"))

task2 = asyncio.create_task(research_agent.async_run("Research topic B"))

task3 = asyncio.create_task(research_agent.async_run("Research topic C"))

results = await asyncio.gather(task1, task2, task3)

return resultsA vantagem técnica do Llama 4 para AI Agentes

lhama 4's características específicas o tornam particularmente adequado para aplicações de agentes:

- Arquitetura multimodal de fusão inicial permite que os agentes processem texto e imagens juntos naturalmente, diferentemente de abordagens anteriores que mantinham as modalidades separadas.

- Design de mistura de especialistas permite que o modelo ative apenas parâmetros relevantes para cada tarefa, tornando as respostas mais rápidas e precisas.

- Tratamento excepcional de contexto longo (até 10 milhões de tokens no Scout) permite que os agentes mantenham o histórico de conversas e consultem documentos longos sem perder a coerência.

- Capacidades multilingues em 12 idiomas oficialmente suportados tornam os agentes acessíveis a usuários globais.

hes, você pode criar AI agentes que não só compreendem e respondem a pedidos, mas também colaboram ativamente para resolver problemas complexos, representando verdadeiramente a próxima geração de AI aplicações.

Principais perguntas frequentes

O que torna o Llama 4 diferente de outros modelos de linguagem?

O Llama 4 utiliza uma abordagem de fusão precoce para processamento multimodal e uma arquitetura esparsa de Mistura de Especialistas para maior eficiência. Ele trata texto, imagens e vídeo como uma única sequência de tokens e ativa apenas submodelos "especialistas" relevantes para cada entrada.

O AutoGen pode funcionar com LLMs diferentes do Llama 4?

Sim, o AutoGen é independente de modelo e pode trabalhar com vários LLMs, incluindo OpenAI modelos, modelos antrópicos e outros modelos de código aberto como Mistral AI ou DeepSeek.

A construção AI agentes exigem habilidades avançadas de programação?

Não necessariamente. Com conhecimentos básicos de Python e compreensão de LLMs, você pode configurar e executar fluxos de trabalho de agentes. O AutoGen simplifica o processo de criação e coordenação de múltiplos agentes.

Estes podem AI agentes são executados em hardware local?

Sim, o AutoGen suporta integração com LLMs locais por meio de ferramentas como o Ollama, permitindo que você execute agentes em seu próprio hardware.

Como lidar com chaves de API com segurança na produção?

Armazene chaves de API em variáveis de ambiente ou cofres seguros, em vez de em código. Use autenticação e criptografia adequadas para implantações de produção.

Posso estender os agentes com ferramentas e APIs personalizadas?

Com certeza. O AutoGen permite conectar agentes a APIs externas, bancos de dados e ferramentas personalizadas, permitindo que eles interajam com diversos sistemas e serviços.

Leituras recomendadas:

Conclusão

Building AI Agentes com Llama 4 e AutoGen abrem possibilidades interessantes para a criação de sistemas inteligentes e colaborativos que podem lidar com tarefas complexas. A combinação de lhama 4's inteligência multimodal e AutoGen's estrutura de agente flexível fornece aos desenvolvedores ferramentas poderosas para criar AI agentes que podem raciocinar, colaborar e se adaptar a vários cenários.

Nosso projeto de exemplo — um gerador de propostas multiagente — demonstra apenas uma aplicação prática dessas tecnologias. Os mesmos princípios podem ser aplicados a construir AI agentes para criação de conteúdo, análise de dados, atendimento ao cliente, pesquisa, gerenciamento de projetos e muitos outros domínios.

À medida que você constrói o seu próprio AI agentes com Llama 4 e AutoGen, lembre-se destes princípios-chave:

BONUS: Receba nossos $ 200 “AI “Kit de ferramentas de domínio” GRÁTIS ao se inscrever!

BONUS: Receba nossos $ 200 “AI “Kit de ferramentas de domínio” GRÁTIS ao se inscrever!

![10 melhores zeladores AI Alternativas com bate-papo NSFW [maio de 2026]](https://aimojo.io/wp-content/uploads/2024/01/Best-Janitor-AI-Alternatives-100x100.webp)