Razem AI Kluczowe spostrzeżenia

Czym jest Together AI?

Razem AI jest pełnym stosem AI Platforma chmurowa stworzona dla programistów i inżynierów uczenia maszynowego, którzy potrzebują szybkiego i ekonomicznego dostępu do dużych modeli językowych open source. Założona w 2020 roku platforma oferuje bezserwerowe wnioskowanie, precyzyjne dostrajanie modeli, dedykowane punkty końcowe GPU oraz klastry GPU na żądanie – wszystko w jednym miejscu. Obsługuje ponad 200 modeli z rodzin, w tym Llama 4, DeepSeek V3, Qwen 3.5, Mistral i FLUX, do generowania obrazów.

Razem AI usuwa obciążenie związane z zarządzaniem infrastrukturą GPU, dzięki czemu zespoły mogą skupić się na budowaniu AI aplikacje natywne. Jego otwartośćAI Zgodne API oznacza, że istniejące bazy kodu można migrować z minimalnymi zmianami. Dla firm, które chcą obsługiwać duże wolumeny AI obciążenia za ułamek kosztów zastrzeżonego interfejsu API, razem AI zajmuje silną pozycję jako dostawca szkoleń i rozwiązań wnioskowania na poziomie produkcyjnym.

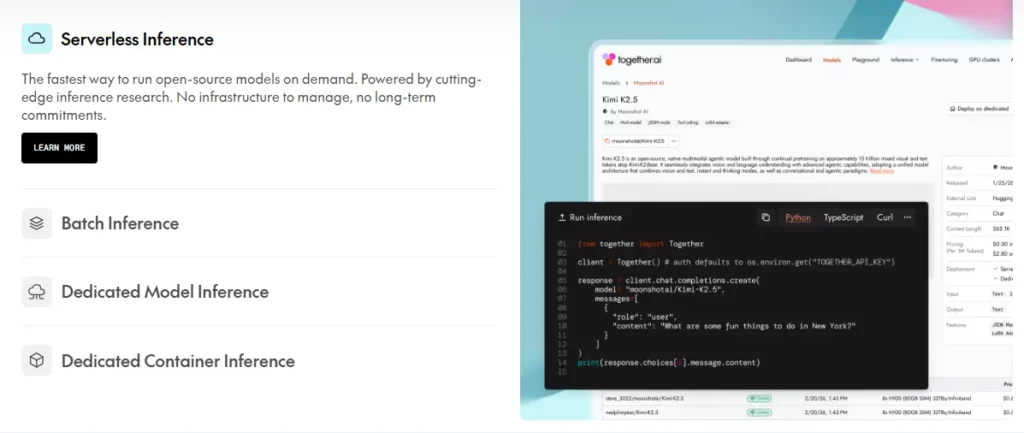

Razem AI gości ponad 200 modele open source Obejmując tekst, obrazy, wideo, audio, osadzenia i generowanie kodu. Programiści mogą wywoływać dowolny model za pośrednictwem jednego interfejsu API bez konieczności konfigurowania serwerów. Modele takie jak Llama 4 Maverick kosztują około 0.27 USD za milion tokenów wejściowych, co sprawia, że obciążenia produkcyjne o dużej objętości są znacznie tańsze niż zastrzeżone alternatywy. Platforma zawiera również API Batch dla zadań mniej pilnych, przy niższych kosztach.

Autorski silnik inferencyjny Together AI wykorzystuje FlashAttention 3 i system spekulacyjny ATLAS, aby zapewnić do 3.5 razy szybszą inferencję niż standardowe implementacje. Na sprzęcie NVIDIA H100 osiąga to około 840 TFLOPS/s z precyzją BF16. Rzeczywisty wynik to około 400 tokenów na sekundę w produkcji, czyli około 2.5 do 4 razy szybciej niż prędkość wyjściowa GPT 4 Turbo.

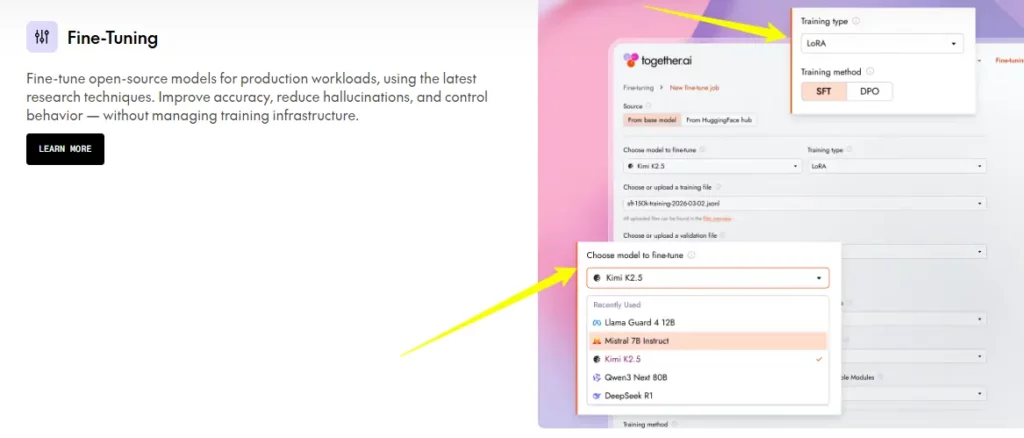

Platforma obsługuje zarówno LoRA (Low Rank Adaptation), jak i pełne dostrajanie wagowe dla modeli o parametrach do 100 mld. Ceny zaczynają się od 0.48 USD za milion tokenów dla LoRA dla modeli do 16 mld. Zespoły mogą trenować modele na zastrzeżonych danych, aby tworzyć systemy specyficzne dla konkretnych zadań, np. prawnych, medycznych lub… aplikacje obsługi klienta a następnie wdrożyć je natychmiast w stosie wnioskowania Together AI.

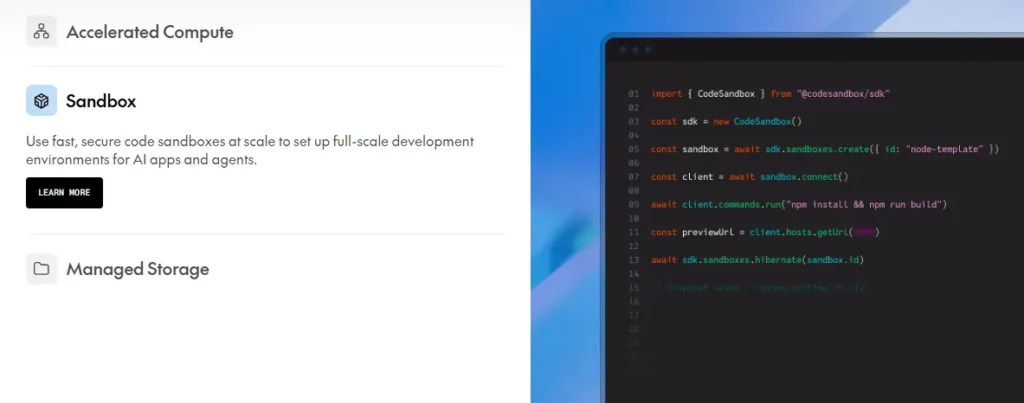

Dla zespołów potrzebujących dedykowanego przetwarzania, razem AI Oferuje natychmiastowy dostęp do serwerów NVIDIA H100, H200, B200 oraz najnowszych szaf GB200 i GB300 NVL72. Ceny na żądanie zaczynają się od 3.49 USD za godzinę za węzeł H100, a ceny rezerwowe spadają do 2.55 USD za godzinę przy dłuższych umowach. To sprawia, że jest to solidna alternatywa dla AWS, GCP lub Azure w przypadku obciążeń szkoleniowych ML.

Migracja z API OpenAI do Together AI wymaga jedynie zmiany adresu URL bazowego. Platforma udostępnia również interpreter kodu, który wykonuje Kod wygenerowany przez LLM w środowiskach sandboxowych w cenie 0.03 USD za sesję, plus pełny Code Sandbox dla większych środowisk programistycznych, rozliczany za godzinę vCPU.

Razem AI Plany taryfowe

| Plan | Koszty: | Kluczowe Szczegóły |

|---|---|---|

| Wnioskowanie bezserwerowe | Od 0.02 do 7.00 USD za 1 mln tokenów | Zależy od modelu. Tokeny wyjściowe kosztują więcej niż wejściowe. |

| Dedykowane punkty końcowe | Od 3.99 USD/godz. | Pojedynczy procesor graficzny z gwarantowaną wydajnością |

| Klastry GPU (na żądanie) | $ 3.49 / hr | Rozliczanie godzinowe, bez zobowiązań |

| Klastry GPU (zarezerwowane) | 2.55 USD/godz. do 7.15 USD/godz. | Okresy od 1 tygodnia do 6+ miesięcy z rabatami ilościowymi |

| Dostrajanie precyzyjne (LoRA) | Od 0.48 do 2.90 USD za 1 mln tokenów | W zależności od rozmiaru modelu (do 100B) |

| Dokładne dostrajanie (pełne) | Od 0.54 do 3.20 USD za 1 mln tokenów | Wszystkie wagi zaktualizowane |

| Tłumacz kodu | 0.03 USD za sesję | Wykonywanie kodu w trybie sandbox |

| Współdzielony system plików | 0.16 USD za GiB/miesiąc | Równoległe przechowywanie o dużej przepustowości |

Razem AI Badania i wkład w oprogramowanie typu open source

Razem AI nie jest tylko dostawcą infrastruktury. Firma aktywnie wspiera AI Badania idą naprzód. Zespół stworzył FlashAttention, który jest obecnie standardowym mechanizmem uwagi stosowanym w branży. Inne wkłady obejmują Mixture of Agents, otwarte zbiory danych Red Pajama, DeepCoder i Open Data Scientist Agent.

To podejście badawcze na pierwszym miejscu oznacza najnowsze techniki optymalizacji i architektury modeli są dostępne na platformie od pierwszego dnia. Dla zespołów inżynierskich, którym zależy na utrzymaniu się na granicy wydajności modeli, ten ciągły proces badawczy zapewnia Together AI przewagę techniczną, której resellerzy rozwiązań chmurowych po prostu nie są w stanie osiągnąć.

Plusy i minusy

- Ponad 200 dostępnych modeli open source.

- Najwyższa w branży szybkość wnioskowania.

- OtwarteAI migracja zgodnego interfejsu API.

- Elastyczne opcje klastra GPU.

- Silne wsparcie w zakresie dostrajania.

- Aktywna AI składki badawcze

- Brak stałego poziomu bezpłatnego.

- Tylko dla programistów. Nieodpowiednie dla początkujących.

- Przewidywanie kosztów może być trudne.

Najlepiej razem AI Podobne produkty

| AI Infrastruktura / Platforma MLOps | Efektywność kosztowa | Szerokość modelu |

|---|---|---|

| Replika | Rozliczanie sekundowe, dobre w przypadku obciążeń o dużej intensywności | Ponad 100 modeli, w tym modele dyfuzyjne i niestandardowe |

| OtwórzRouter | Dostawcy agregatów oferujący najniższy koszt za token | Ponad 200 modeli w wielu zapleczach |

| Fajerwerki AI | Konkurencyjne ceny bezserwerowe, szybkie wnioskowanie | Skupiamy się na najlepszych programach LLM z otwartym kodem źródłowym |

| Punkty końcowe wnioskowania o przytulaniu twarzy | Dostępna bezpłatna warstwa, elastyczne wdrażanie | Największy hub modeli open source |