Narzędzia do scrapowania danych oparte na sztucznej inteligencji pomagają firmy, analitycy danych i marketerzy Zbieraj informacje z sieci bez wysiłku. Te inteligentne narzędzia automatycznie pobierają dane ze stron internetowych, dostosowują się do zmian na stronie i dostarczają nowych spostrzeżeń zespołom zajmującym się e-commerce, finansami i badaniami rynku.

Kompletujemy wszystkie dokumenty (wymagana jest kopia paszportu i XNUMX zdjęcia) potrzebne do AI skrobaki oszczędzaj czas i zwiększ dokładność, Użytkownicy muszą zwracać uwagę na kwestie prywatności, regulamin serwisu i prawa własności intelektualnej. Najlepsze narzędzia łączą skuteczne gromadzenie danych z etycznymi praktykami, zapewniając dostępność danych internetowych przy jednoczesnym poszanowaniu ważnych granic.

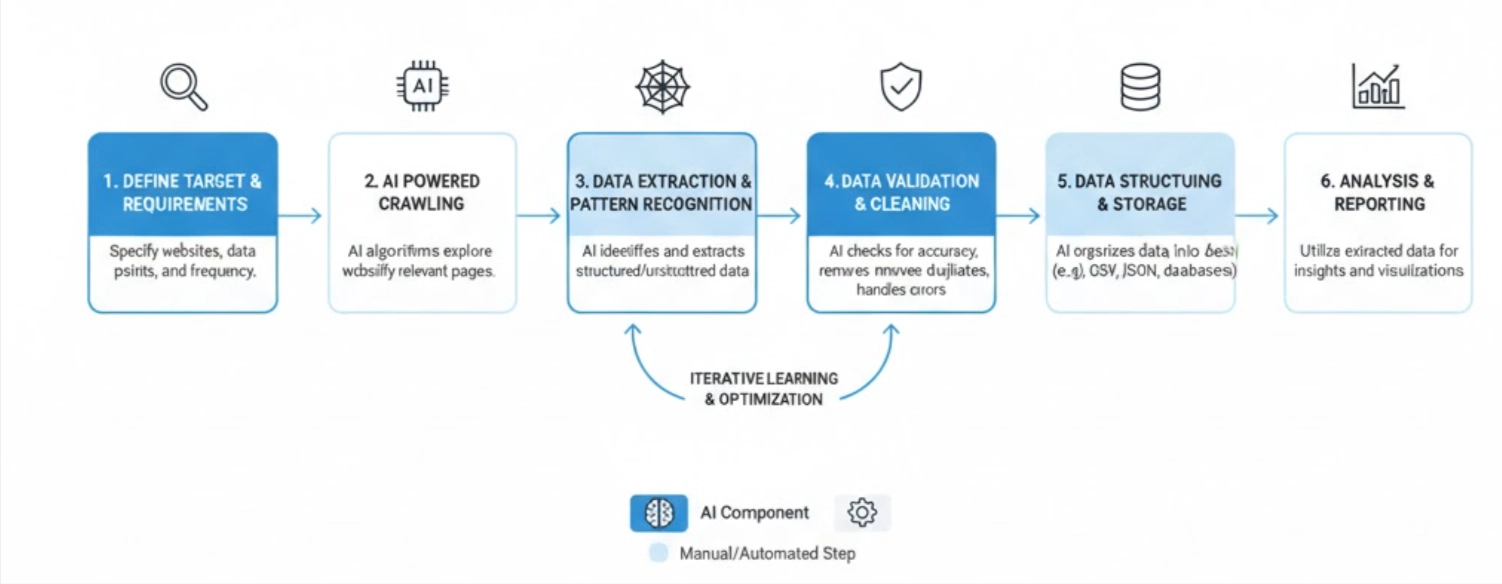

Jak działają narzędzia do scrapowania danych oparte na sztucznej inteligencji?

Narzędzia do scrapowania danych oparte na sztucznej inteligencji działają poprzez połączenie kilku inteligentnych technologii, aby zautomatyzować i udoskonalić proces ekstrakcji danych:

Dzięki wykorzystaniu tych możliwości narzędzia do pozyskiwania danych oparte na sztucznej inteligencji zapewniają dokładne, aktualne i przydatne informacje przy minimalnym nakładzie pracy ręcznej.

Narzędzia do scrapowania stron internetowych oparte na sztucznej inteligencji, które zwiększają gromadzenie danych

| Najlepsze narzędzia do scrapowania danych oparte na sztucznej inteligencji | Kluczowe funkcje | Najlepsze dla: |

|---|---|---|

| Oxylaby | Scraping języka naturalnego | Ekstrakcja danych przedsiębiorstwa |

| Dekodować | Integracja serwera MCP | AI model szkolenia |

| Przeglądaj SI | Brak kodu, automatyczne monitorowanie, integracje | Użytkownicy nietechniczni, automatyzacja |

| SkrobakAPI | Sieć proxy, ominięcie CAPTCHA, JSON | Globalny, przyjazny dla programistów |

| Ośmiornica | AI wykrywanie, bez kodu, chmura | Badania rynku, No-code |

| ScrapeStorm | AI scrapowanie, eksport wieloformatowy | Wszystkie branże |

| Barden | AI przepływy pracy, bez kodu, podręczniki | Sprzedaż, Produktywność |

| WebHarvy | Kliknięcie w punkt, rozpoznawanie wzorców | E-commerce, Analitycy |

| Diffbot | Wizja komputerowa, graf wiedzy | Przedsiębiorstwo, Skala |

| Import.io | AI ekstrakcja, maskowanie PII | Badania rynku |

| ParseHub | Dynamiczna zawartość, harmonogramowanie w chmurze | Analitycy, Sprzedaż |

| Kadoa | Brak konieczności konserwacji, zgodność | Zgodność, automatyzacja |

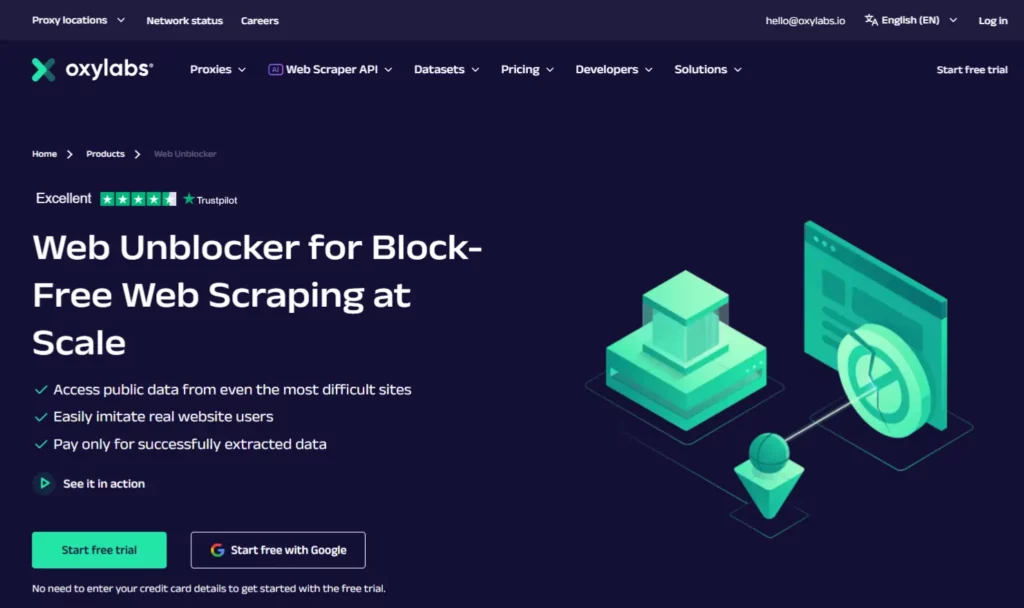

1. Oxylaby

Oxylabs to wiodąca platforma web scrapingu oparta na sztucznej inteligencji, której zaufało ponad 4,000 klientów na całym świecie. Oferuje serwery proxy dla użytkowników indywidualnych, centrów danych, urządzeń mobilnych i dostawców usług internetowych, a także zaawansowane interfejsy API scraperów i gotowe do użycia zestawy danych do bezproblemowej ekstrakcji danych publicznych.

Niezależnie od tego, czy potrzebujesz kompletnej linii, czy pojedynczego urządzenia, Ponad 100 mln adresów IP w 195 krajach, Oxylabs zapewnia skuteczność na poziomie ponad 99% i czas reakcji poniżej sekundy. AI Studio i OxyCopilot umożliwiają zbieranie danych przy użyciu prostych komunikatów w języku naturalnym — bez konieczności kodowania.

Jeśli potrzebujesz danych dla AI szkolenia, wywiad e-commerce, Monitorowanie SEOlub cyberbezpieczeństwa, Oxylabs wzmacnia każdy proces pracy niezawodnością klasy korporacyjnej i certyfikatem ISO 27001.

Oxylaby Plusy i minusy

Plany cenowe Oxylabs:

Oxylabs oferuje elastyczne ceny: serwery proxy dla użytkowników indywidualnych kosztują od 8 USD/GB, serwery proxy dla centrów danych obejmują bezpłatne okresy próbne, dedykowane centra danych od 2.25 USD/IP, a interfejs API Web Scraper od 49 USD/miesiąc.

2. Dekodować

Decodo (dawniej Smartproxy) to kompleksowa platforma proxy i web scrapingu oparta na sztucznej inteligencji, której zaufało ponad 130 tysięcy klientów na całym świecie. Z ponad 125 milionami etycznie pozyskiwanych adresów IP w ponad 195 lokalizacjach, zapewnia błyskawiczną ekstrakcję danych z 99.99% dostępnością i czasem reakcji poniżej 0.2 sekundy.

Od proxy mieszkaniowe, dostawcy usług internetowych, serwery mobilne i centra danych do potężnych interfejsów API do scrapowania SERP, eCommerce i media społecznościowe — Decodo zajmuje się tym wszystkim. AI Parser konwertuje nieuporządkowany kod HTML na ustrukturyzowany kod JSON za pomocą komunikatów w języku naturalnym, dzięki czemu idealnie nadaje się do szkoleń LLM, badań rynku i monitorowania SEO.

Zacznij za darmo dzięki elastycznym planom płatności za użytkowanie i bezproblemowej integracji z narzędziami takimi jak n8n, LangChain i serwery MCP.

Zalety i wady Decodo

Plany cenowe:

Decodo oferuje przyjazne dla budżetu ceny: serwery proxy dla użytkowników indywidualnych od 2 USD/GB, serwery proxy dla centrów danych od 0.02 USD/IP, serwery proxy dla urządzeń mobilnych od 2.25 USD/GB, serwery proxy dla dostawców usług internetowych od 0.27 USD/IP i interfejsy API do scrapowania od 0.08 USD/1 żądań.

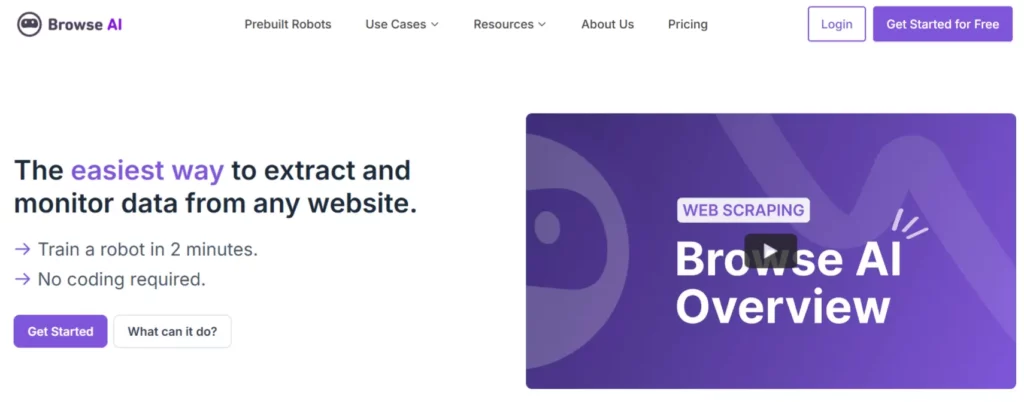

3. Przeglądaj SI

Odkryj moc Browse AI, gdzie ekstrakcja danych spotyka sztuczną inteligencjęTo rewolucyjne narzędzie umożliwia scrapowanie dowolnej strony internetowej za pomocą prostych czynności typu „wskaż i kliknij” — bez konieczności kodowania.

Idealne do firmy, marketerzy i badacze, Przeglądaj AI automatyzuje monitorowanie konkurencji, śledzenie ceni badania rynku z precyzją godną człowieka.

Wyszkol niestandardowe roboty, aby wyodrębniły dokładnie to, czego potrzebujesz, zaplanuj automatyczne monitorowanie i otrzymuj alerty o zmianach ważnych danych. Dzięki płynnej integracji z Arkuszami Google, Zapier i ponad 7,000 aplikacji, Twoje cenne dane płyną dokładnie tam, gdzie ich potrzebujesz.

Dołącz do ponad 500 000 zadowolonych użytkowników na całym świecie, którzy oszczędzają niezliczone godziny dzięki temu intuicyjnemu rozwiązaniu do scrapowania wspomaganemu przez sztuczną inteligencję.

Przeglądaj AI Plusy i minusy

Przeglądaj AI Plany taryfowe

Bezpłatny plan z 50 kredytami miesięcznie; plany płatne zaczynają się od 19 USD/miesiąc (rocznie) lub 23.75 USD/miesiąc (miesięcznie) za 2,000 kredytów, a plany zespołowe kosztują 249 USD/miesiąc i oferują 10 000 kredytów oraz 5-minutowe interwały monitorowania.

4. SkrobakAPI

Wyobraź sobie bezproblemowe scrapowanie stron internetowych! ScraperAPI to Twój zaufany partner, który fachowo zajmuje się złożone serwery proxy, przeglądarki i CAPTCHA Automatycznie, więc nie musisz. Skorzystaj z ogromnej sieci ponad 40 milionów adresów IP w ponad 50 krajach, aby gromadzić kluczowe dane na całym świecie bez blokowania.

Otrzymasz czysty, ustrukturyzowany JSON dane Bezpośrednio z dowolnej publicznej witryny internetowej, oszczędzając Twojemu zespołowi niezliczone godziny pracy programistycznej. Płynnie skaluj swoje projekty gromadzenia danych, zapewniając swojej firmie dostęp do rzetelnych analiz w czasie rzeczywistym. Dołącz do ponad 10 000 firm, które zaufały temu przyjaznemu dla programistów rozwiązaniu.

Zalety i wady ScraperAPI

Plany cenowe ScraperAPI

Bezpłatny plan z 1,000 kredytów API miesięcznie; płatne plany zaczynają się od 49 USD miesięcznie za 100 000 kredytów, przy czym wyższe poziomy umożliwiają zwiększenie skalowalności.

5. Ośmiornica

Przekształć dowolną witrynę internetową w dane strukturalne za pomocą Octoparse's Rozwiązanie do scrapowania bez kodu. Jego transformacje AI funkcja automatycznego wykrywania identyfikuje i wyodrębnia dane w ciągu kilku sekund — nawet ze złożonych, dynamicznych stron internetowych.

Twórz niestandardowe scrapery za pomocą proste akcje typu „wskaż i kliknij” lub wybierz spośród setek gotowych szablonów. Skorzystaj z zaawansowanych funkcji ekstrakcji danych z chmury, rotacji adresów IP i rozwiązywania testów CAPTCHA, aby zbierać dane nieprzerwanie 24/7.

Idealny do badań rynku, analiza konkurencjii generowanie leadów w różnych branżach. Eksportuj bezpośrednio do Excela, CSV, baz danych lub integruj przez API, aby zapewnić płynny przepływ pracy.

Octoparse - zalety i wady

Plany cenowe Octoparse

Dostępny jest bezpłatny plan; plany płatne zaczynają się od 99 USD miesięcznie za plan Standard z ekstrakcją do chmury, 249 USD miesięcznie za plan Professional z zaawansowanymi funkcjami i niestandardowe rozwiązania Enterprise dla potrzeb na dużą skalę.

6. ScrapeStorm

ScrapeStorm, opracowany przez byłych inżynierów wyszukiwarki Google, zmienia sposób ekstrakcji danych z sieci dzięki inteligentnemu AI technologia. Wybierz pomiędzy Tryb inteligentny do natychmiastowego scrapowania bez kodu lub tryb schematu blokowego do dostosowywania ekstrakcji za pomocą prostych kliknięć.

Idealne do przedsiębiorstwa, badacze i analitycy To wieloplatformowe narzędzie sprawdza się we wszystkich branżach i automatycznie identyfikuje tabele, listy oraz stronicowanie, a także obsługuje wiele formatów eksportu, w tym Excel i CSV.

Niezależnie od tego, czy potrzebujesz kompletnej linii, czy pojedynczego urządzenia, przechowywanie w chmurze, zaplanowane ekstrakcje i zaawansowane możliwości filtrowania, ScrapeStorm przekształca złożone gromadzenie danych w płynne doświadczenie dla użytkowników o różnym wykształceniu technicznym.

Zalety i wady ScrapeStorm

Plany cenowe ScrapeStorm

Bezpłatny plan Starter jest dostępny na zawsze; plany płatne zaczynają się od 49.99 USD/miesiąc za plan Professional z dziennym eksportem 10 000 wierszy, 99.99 USD/miesiąc za plan Premium z nieograniczonym eksportem oraz plan Business z dodatkowymi zaawansowanymi funkcjami.

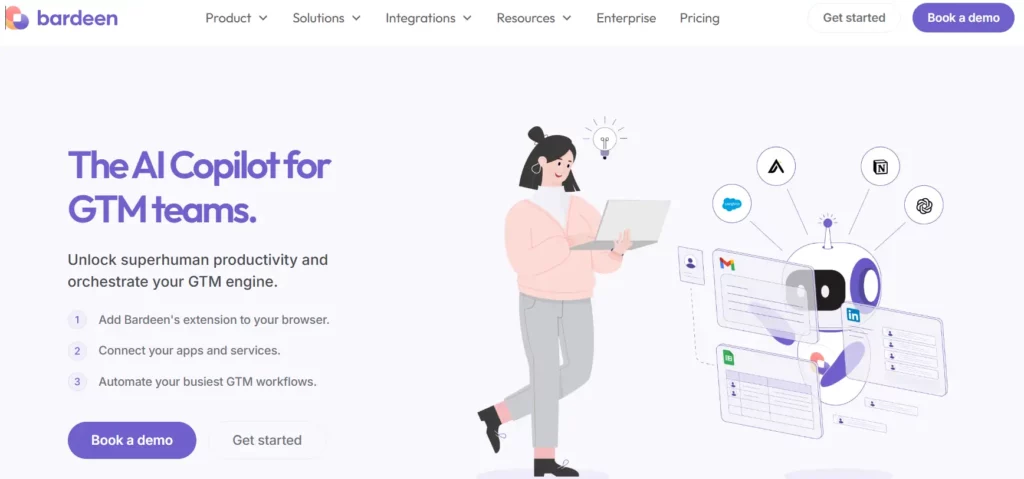

7. Barden

Przekształć swoje procesy ekstrakcji danych dzięki Bardeen's Rozszerzenie Chrome oparte na sztucznej inteligencji. To intuicyjne narzędzie bez kodu umożliwia zbieranie danych z dowolnej witryny internetowej, w tym LinkedIn, i automatyczne przesyłanie ich do ulubionych aplikacji za pomocą zaledwie kilku kliknięć.

Zastosowanie Ponad 500 gotowych podręczników lub twórz niestandardowe przepływy pracy za pomocą język naturalny Dzięki takim funkcjom jak deep scraping, paginacja i powiadomienia w czasie rzeczywistym, Bardeen bez trudu radzi sobie ze złożonymi zadaniami ekstrakcji danych.

Idealne rozwiązanie dla zespołów sprzedaży, marketingowców i badaczy, którzy chcą zautomatyzować powtarzalne zadania i zwiększyć produktywność.

Zalety i wady Bardeen

Plany cenowe Bardeen

Bezpłatny plan ze 100 kredytami miesięcznie; płatne plany zaczynają się od 99 USD/miesiąc (rozliczenie roczne) w przypadku planu startowego, 500 USD/miesiąc w przypadku planu Teams z niestandardowym AI Podręczniki oraz 1,500 USD miesięcznie za rozwiązania dla przedsiębiorstw ze specjalnym konsultantem GTM i nieograniczonymi opcjami kredytowymi.

8. WebHarvy

WebHarvy zapewnia zaawansowaną ekstrakcję danych za pomocą intuicyjnego interfejsu wizualnego — idealnego dla przedsiębiorstwa i badacze bez umiejętności programowania. Wystarczy wskazać i kliknąć, aby wyodrębnić tekst, obrazy i adresy URL z dowolnej witryny.

To wszechstronne narzędzie obsługuje złożone scenariusze, w tym paginację, formularze logowania i zawartość dynamiczna z łatwością. Eksportuj swoje dane bezpośrednio do Excel, CSV lub bazy danych do natychmiastowej analizy.

Dzięki inteligentnemu rozpoznawaniu wzorców, zaplanowanemu scrapowaniu i obsłudze serwerów proxy WebHarvy zapewnia zespołom marketingowym, analitykom i profesjonaliści e-commerce podejmowanie decyzji w oparciu o dane bez barier technicznych.

Zalety i wady WebHarvy

Plany cenowe WebHarvy

Jednorazowa płatność już od 129 USD za licencję dla jednego użytkownika obejmującą 1 rok aktualizacji i wsparcia.

9. Diffbot

Diffbot przekształca niestrukturalną treść internetową w czyste, ustrukturyzowane dane przy użyciu zaawansowanych widzenie komputerowe i uczenie maszynowe. W przeciwieństwie do tradycyjnych scraperów, które psują się, gdy zmieniają się strony internetowe, Diffbot „widzi” strony tak jak ludzie, automatyczne wyodrębnianie artykułów, produkty i wiele więcej bez konieczności kodowania niestandardowego.

Zaufany przez Microsoft, eBay i DuckDuckGo, To rozwiązanie klasy enterprise działa w dowolnym języku i bezproblemowo obsługuje dynamiczną zawartość. Dzięki rozbudowanemu Grafowi Wiedzy i możliwościom przetwarzania języka naturalnego, Diffbot zapewnia niezrównaną dokładność firmom potrzebującym danych internetowych o znaczeniu krytycznym na dużą skalę.

Plusy i minusy Diffbota

Plany cenowe Diffbota

Bezpłatny plan z 10 000 kredytów; plany płatne od 299 USD/miesiąc za 250 000 kredytów do 899 USD/miesiąc za 1 000 000 kredytów.

10. Import.io

Wykorzystaj moc Import.io AI i uczenie maszynowe aby automatycznie przekształcać złożone strony internetowe w ustrukturyzowane, użyteczne dane. To zaawansowane AI pomaga poruszać się po nowoczesnych witrynach, omijać blokady, takie jak logowanie, a nawet sugeruje punkty danych za pomocą jednego kliknięcia.

Skorzystaj z takich funkcji jak Maskowanie danych osobowych w celu zapewnienia zgodnościImport.io to idealne narzędzie do badań rynku i analizy konkurencji. Wykorzystuje inteligentne algorytmy, aby dostarczać dokładne dane internetowe dostosowane do potrzeb Twojej firmy, bez konieczności znajomości kodowania.

Import.io – zalety i wady

Plany cenowe Import.io

Plany zaczynają się od 299 USD miesięcznie z 14-dniowym bezpłatnym okresem próbnym; rozwiązania dla przedsiębiorstw są dostępne w cenach dostosowanych do indywidualnych potrzeb.

11. ParseHub

ParseHub przekształca złożone scrapowanie stron internetowych w proste narzędzie typu „wskaż i kliknij”. To potężne narzędzie Narzędzie oparte na sztucznej inteligencji uchwyty dynamiczna zawartość, JavaScript, AJAX, i elementy interaktywne stanowiące wyzwanie dla tradycyjnych scraperów.

Wyodrębnij dane z wielu stron jednocześnie i otrzymywać informacje zwrotne w czasie rzeczywistym podczas pracy. Dzięki harmonogramowaniu w chmurze i automatycznej rotacji adresów IP Twoje projekty przebiegają płynnie, zachowując jednocześnie prywatność.

Rozwiązanie ParseHub jest idealne dla analityków, zespołów sprzedaży i badaczy. Dostarcza ustrukturyzowane dane w formatach CSV, JSON lub za pośrednictwem interfejsu API, dzięki czemu dane internetowe są dostępne dla osób bez względu na poziom wiedzy technicznej.

Zalety i wady ParseHub

Plany cenowe ParseHub

Dostępny jest bezpłatny plan; ceny planów płatnych zaczynają się od 189 USD miesięcznie za plan Standard z 10 000 stron na raz oraz od 599 USD miesięcznie za plan Professional z nieograniczoną liczbą stron.

12. Kadoa

Przekształć dowolną witrynę internetową w dane strukturalne w ciągu kilku minut dzięki Kadoa's transformacje AI technologia. Ten rozwiązanie bezobsługowe automatycznie dostosowuje się do zmian na stronie internetowej, zapewniając nieprzerwany przepływ danych.

Wyodrębnij wszystko, od list produktów po dane finansowe, bez konieczności kodowania. Wystarczy wybrać potrzebne dane, a Kadoa…'s inteligentny system zajmie się resztą — w tym kontrole zgodności i weryfikacja dokładności danych.

Dzięki elastycznym planom cenowym zaczynającym się od 39 USD miesięcznie i bezproblemowej obsłudze integracja APIKadoa pozwala firmom skupić się na spostrzeżeniach, a nie na wyzwaniach technicznych.

Zalety i wady Kadoa

Plany cenowe Kadoa

Bezpłatny poziom z 500 kredytami; Plan samoobsługowy za 39 USD miesięcznie za 25 000 kredytów; Plan Enterprise z dostosowanymi cenami dla zaawansowanych funkcji.

Kluczowe cechy, na które należy zwrócić uwagę przy wyborze najlepszych narzędzi do scrapowania danych opartych na sztucznej inteligencji

Oceniając narzędzia do scrapowania danych oparte na sztucznej inteligencji, należy wziąć pod uwagę następujące podstawowe funkcje, aby zapewnić optymalną wydajność i zgodność z przepisami:

Wybór narzędzi wyposażonych w te funkcje gwarantuje wydajne, niezawodne i etyczne pozyskiwanie danych przy użyciu sztucznej inteligencji na potrzeby różnych potrzeb biznesowych i analitycznych.

Korzystanie z mocy AI Skrobanie danych

Narzędzia do scrapowania danych oparte na sztucznej inteligencji ułatwiają i przyspieszają pobieranie informacji ze stron internetowych. Te inteligentne narzędzia działają samodzielnie, zbierać dane prawidłowo, nawet gdy strony internetowe ulegają zmianom.

Możesz śledzić konkurentów, badaj rynki lub znajdź nowych klientów Bez konieczności wykonywania całej pracy samodzielnie. To oszczędza Twój czas i zapewnia lepsze informacje.

Ten przewodnik pomoże Ci wybrać odpowiednie narzędzie, prawidłowo je wykorzystać i przekształcić dane internetowe w sukces biznesowy. AI dzięki scrapowaniu możesz podejmować lepsze decyzje i wyprzedzać innych w swojej dziedzinie.

AiMojo poleca:

![7 najlepszych darmowych AI Generatory ludzkie w 2026 roku [recenzja i ranking]](https://aimojo.io/wp-content/uploads/2023/11/Best-Free-AI-Human-Generator-450x338.webp)