Sztuczna inteligencja zmienia wszystko, od bankowości po opiekę zdrowotną, ale kiedy AI jeśli popełnisz błąd w kwestii cyberbezpieczeństwa, ryzyko może być katastrofalne.

AI Błędy w zabezpieczeniach nie tylko zniekształcają analizy, ale także tworzą martwe pola, podważają zaufanie i mogą narażać organizacje na duże ryzyko zagrożeń.

W tym przewodniku szczegółowo omówimy problem, wyróżnimy przykłady z życia wzięte, podzielimy się poradami ekspertów i wyposażymy Cię w najlepsze praktyki dotyczące wychwytywania i korygowania błędów. AI wady — ponieważ w tej epoce napędzanej sztuczną inteligencją, odporność cybernetyczna zależy od uzyskania AI dobrze.

Czemu AI Błędy Materia Więcej niż kiedykolwiek

Dzisiaj firmy i zespoły ds. bezpieczeństwa polegają na AI do:

Ale oto kicker: słabo wyszkolone lub stronnicze algorytmy mogą zostać wykorzystane przez atakujących jako broń, co ostatecznie utrudni systemy obronne część problemu. AI nie tylko sprawia, że „szczere błędy„—może wzmacniać luki, pomijać nowe techniki cyberataków, a w najgorszych przypadkach przekształcać drobne niedopatrzenia w poważne naruszenia bezpieczeństwa.

Klawisz Statystyki & spostrzeżenia branżowe

Klasyczny Klienci: Gdy AI Popełnia błąd

Studium przypadku 1: Wykrywanie zagrożeń fantomowych

Oparte na sztucznej inteligencji zabezpieczenia dużego sprzedawcy detalicznego zasygnalizowały legalne zachowania użytkowników jako atak wewnętrzny, powodując masowe blokowanie kont i zakłócenia w działalności. Inżynierowie odkryli, AI „nadmiernie dostosowana” do przestarzałych wzorców ataków i nie potrafiła się do nich dostosować nowe przepływy pracy.

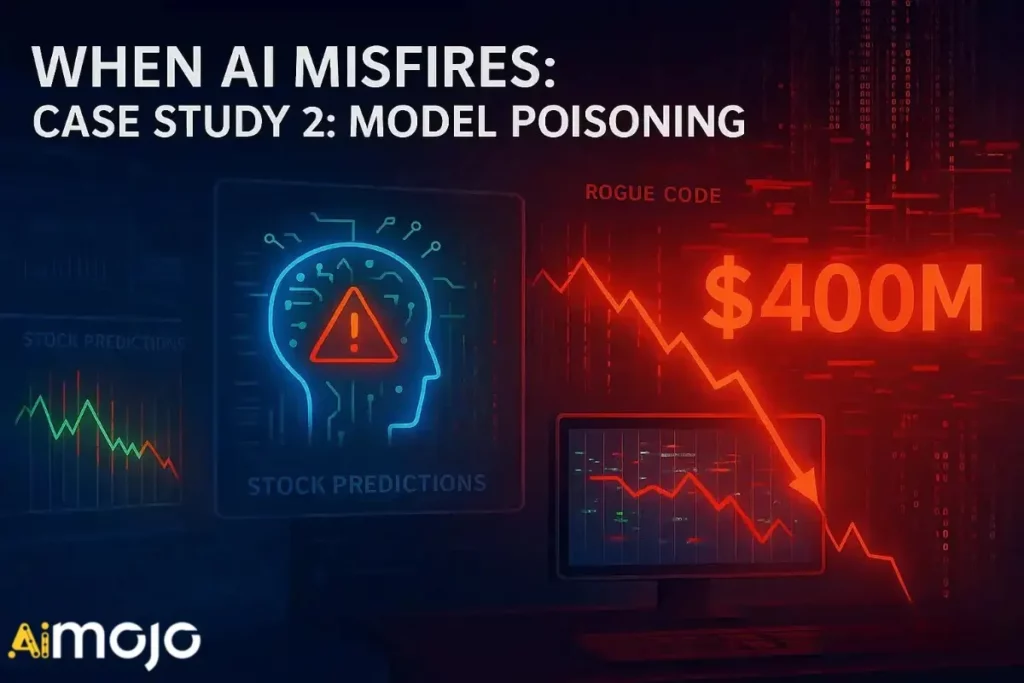

Studium przypadku 2: Zatrucie oparte na modelu sztucznej inteligencji

W firmie handlowej, sfałszowano AI Algorytmy Błędnie sklasyfikowane opcje na akcje z powodu ataku klasyfikacyjnego, co doprowadziło do błędu o wartości 400 milionów dolarów. Winowajcami były brak monitorowania produkcji i niekontrolowany dryf modelu.

Studium przypadku 3: Pominięte przez przeciwników

Ciemny ślad a zespoły Google'a wykazały, że atakujący mogą wykorzystywać techniki takie jak zatruwanie danych, podpowiedzi przeciwników i wykorzystywanie AI „martwych punktów” do podstępne złośliwe oprogramowanie nawet wyprzedzając wiodące systemy obronne oparte na sztucznej inteligencji.

Dlaczego AI Zrozum to źle Bezpieczeństwo cybernetyczne?

Korzyści z posiadania sztucznej inteligencji Prawa w bezpieczeństwie

Przewodnik krok po kroku: Jak Zminimalizować AI Awaria bezpieczeństwa

Krok 1. Zacznij od danych wysokiej jakości

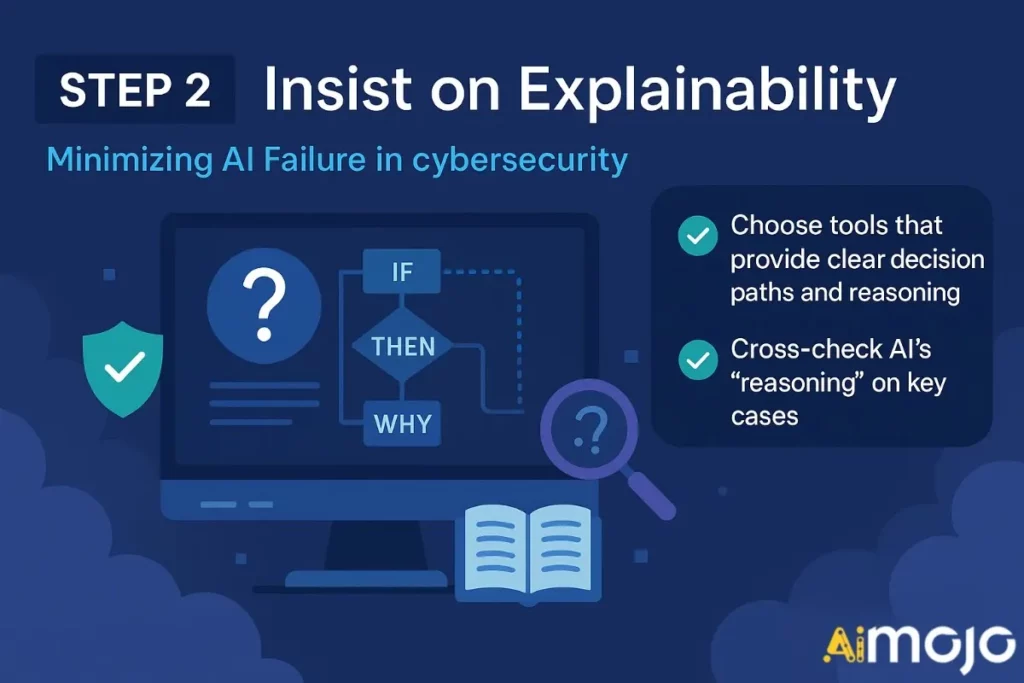

Krok 2. Nalegaj na możliwość wyjaśnienia

Krok 3. Regularny nadzór ludzki

Utrzymywanie „czerwonych zespołów” i analityków ds. bezpieczeństwa w celu przeprowadzania przeglądów AI Decyzje, szczególnie w przypadku alertów oznaczonych flagą lub zignorowanych

Krok 4. Monitoruj dryft i zatrucia

Wdrażaj narzędzia śledzące AI wydajność modelu i wykryć manipulację próby

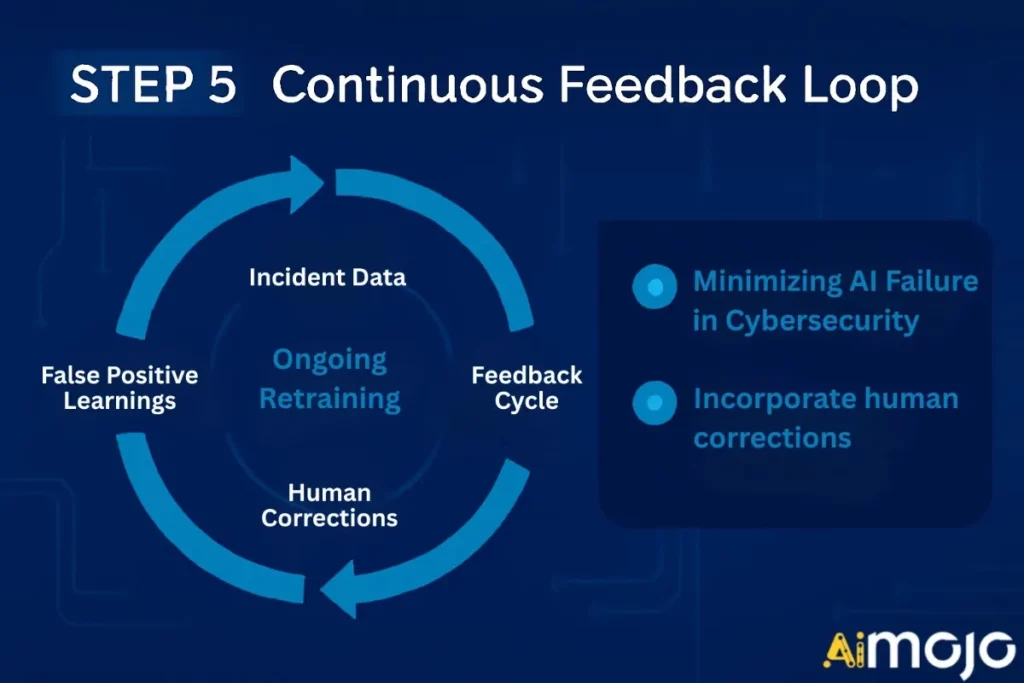

Krok 5. Ciągła pętla sprzężenia zwrotnego

Włączać korekty ludzkie, dane dotyczące incydentów i fałszywe/pozytywne wnioski w ramach trwającego przekwalifikowania

Krok 6. Zbuduj obronę warstwową

Mieszać AI spostrzeżeń za pomocą tradycyjnych narzędzi i opinii ekspertów — nigdy nie polegaj wyłącznie na automatyzacja

Najlepsze narzędzia i zasoby dla AI Błąd Wykrywanie w Cyberbezpieczeństwie

| Narzędzie/zasób | Podstawowa funkcja | Wyjątkowa siła |

|---|---|---|

| Ciemny ślad | Wykrywanie zagrożeń | Autonomiczny samodzielnego uczenia się, głębokie uczenie się |

| IBM Watson dla cyberbezpieczeństwa | Analiza zagrożeń i wywiad | Zaawansowane NLP, synteza danych na dużą skalę |

| Sokół CrowdStrike | Bezpieczeństwo punktu końcowego | Zapobieganie złośliwemu oprogramowaniu w czasie rzeczywistym |

| Drugi pilot zabezpieczeń firmy Microsoft | Automatyzacja bezpieczeństwa & dochodzenie | Wnioski oparte na kontekście i wspomagane sztuczną inteligencją |

| PentestGPT | Automatyczne testy penetracyjne | ciągłym szkoleniom rekomendacje, raportowanie |

💡 Pro Wskazówki aby zachować swoje AI Obrona ostra

Najczęściej zadawane pytania

Czy AI Czy błędów w cyberbezpieczeństwie można całkowicie uniknąć?

Nie do końca—AI będą popełniać błędy, ale regularny nadzór, zróżnicowane dane wejściowe i solidny monitoring mogą znacznie ograniczyć ryzyko.

Czy powinniśmy polegać wyłącznie na AI dla naszego bezpieczeństwa?

Nie. AI jest potężnym sojusznikiem, ale najlepiej sprawdza się w połączeniu z wiedzą fachową i tradycyjnymi środkami bezpieczeństwa.

Jak szybko atakujący wdrażają sztuczną inteligencję?

Bardzo szybko. Od generatywnego złośliwego oprogramowania po deepfake'i, cyberprzestępcy wyprzedzają obrońców, AI czujność jest koniecznością.

Wniosek

Kiedy AI Jeśli popełni błąd, konsekwencje będą odczuwalne w całej organizacji – od przeoczonych naruszeń po utratę zaufania klientów. Wysoce wyszkolona, łatwa do wytłumaczenia sztuczna inteligencja, zawsze połączona z ludzkim nadzorem, to prawdziwy przełom w… bezpieczeństwo cybernetyczne.

Chcesz zabezpieczyć swój biznes?

Zacznij od oceny swojego bezpieczeństwa AI już dziś. Przeprowadź audyt pod kątem martwych punktów, dąż do wyjaśnienia i nie pozwól, by automatyzacja uśpiła Twoją czujność. Jeśli jesteś gotowy przejąć kontrolę, działaj teraz – ponieważ uzyskanie AI Prawo nie jest tylko mądre, jest niezbędne.

Zwiększ swoją odporność cybernetyczną, podnosząc kwalifikacje swojego zespołu i wymagając od niego przejrzystości AI do magazynowania energiii dołączając do rozmowy. Przyszłość należy do tych, którzy ufają swojej sztucznej inteligencji, ale też ją weryfikują.

BONUS: Odbierz nasze 200 dolarówAI „Zestaw narzędzi Mastery Toolkit” GRATIS po rejestracji!

BONUS: Odbierz nasze 200 dolarówAI „Zestaw narzędzi Mastery Toolkit” GRATIS po rejestracji!