Du skriver et skript. Det fungerer perfekt på et testnettsted. Så peker du det mot en stor forhandler eller en sosial plattform. Plutselig flommer terminalen din over av 403 Forbidden-feil eller uendelige CAPTCHA-løkker.

Æraen med enkel HTML-parsing er over.

Moderne webskraping krever mer enn bare å sende en GET-forespørsel. Dagens nettsteder er komplekse applikasjoner beskyttet av aggressive forsvar. Hvis du vil omgå blokkeringer av nettskraping, må du forstå hvordan nettlesere kommuniserer med servere.

Store plattformer som Cloudflare, Akamai og Datadome fungerer som portvoktere. De analyserer alle innkommende forbindelser. De sjekker om du er et menneske eller et skript. For å komme forbi dem trenger du verktøy som etterligner menneskelig atferd perfekt.

Vi viser deg hvordan du gjør det skrape dynamiske nettsteder effektivt, og hvorfor det å flytte disse oppgavene til Decodo er det smarteste trekket for datapipelinen din.

Den «hodeløse» nødvendigheten: Hvorfor enkle forespørsler mislykkes

Tidligere sendte nettsteder hele HTML-sider fra serveren. Skriptet ditt lastet ned teksten, og du hentet ut dataene.

Nå, over 70 % av moderne netthandel nettsteder stole på klientsidegjengivelse (CSR). Når du ber om en URL, sender serveren et tomt HTML-skall. Det faktiske innholdet – priser, lagerbeholdning, beskrivelser – lastes inn senere via JavaScript.

Hvis du bruker et standard HTTP-bibliotek, får du det tomme skallet. Du går glipp av dataene fullstendig.

For å se innholdet trenger du javascript-gjengivelse for skrapingDette betyr vanligvis å kjøre en nettleser som Chrome eller Firefox i bakgrunnen uten et grafisk grensesnitt. Dette kalles headless (headless). nettleserskraping.

Å kjøre headless nettlesere er ressurskrevende. Det bruker opp RAM og CPU. Det introduserer også et nytt problem: deteksjon.

Å knekke koden til anti-botsystemer

Sikkerhetssystemer ser ikke bare på deg IP-adresseDe inspiserer hvordan «nettleseren» din oppfører seg.

Hvis du bruker et standard automatiseringsbibliotek, etterlater det spor. Det kan hende at en variabel som navigator.webdriver = true angis. Dette er en klar avsløring. Antibotsystemer ser dette flagget og blokkerer deg umiddelbart.

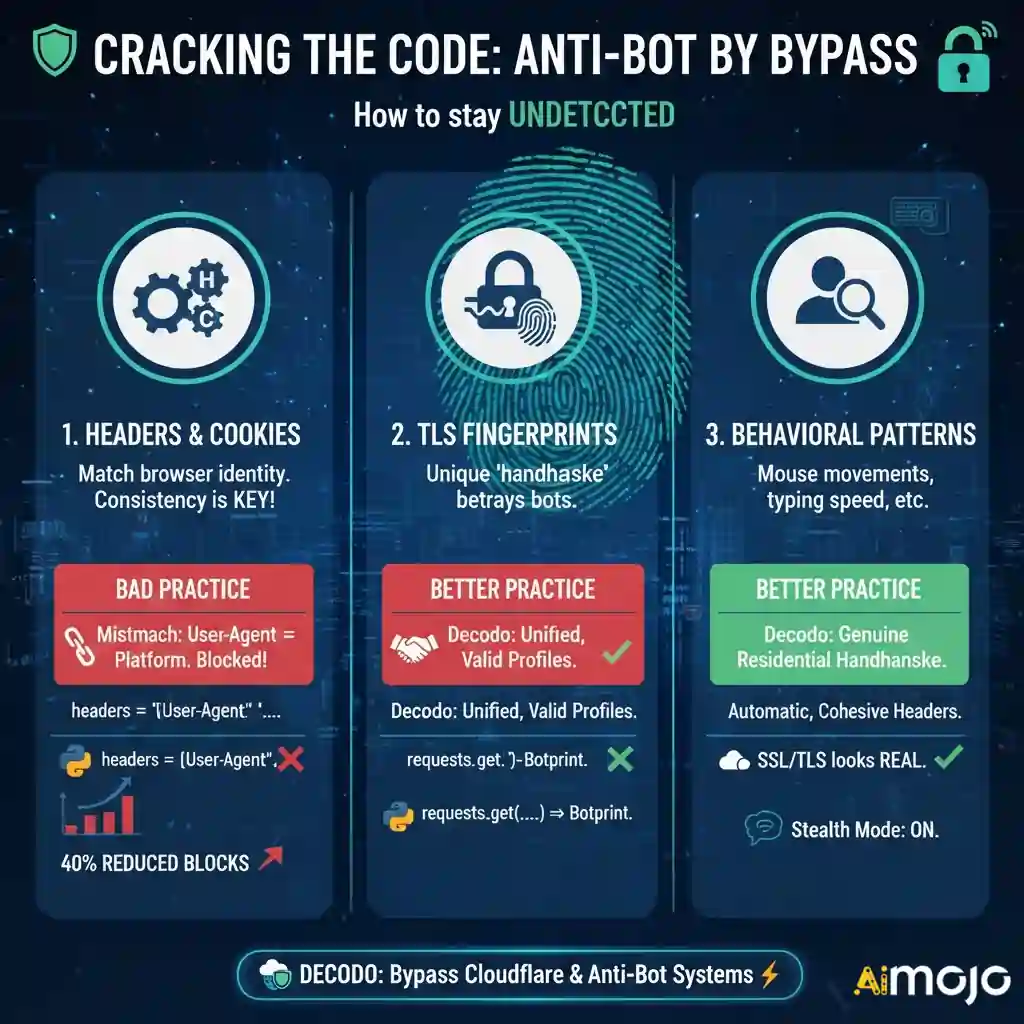

Til omgå cloudflare-skraping beskyttelse, må du håndtere tre kritiske lag:

1. Hvorfor matchende overskrifter er viktige i nettskraping

Forespørselshodene dine forteller serveren hvem du er. Den mest kjente er brukeragenten. Det er imidlertid ikke nok å bare endre brukeragentstrengen.

Overskrifter må fungere som en sammenhengende enhet. Hvis du sender en brukeragent som hevder å være Chrome på Windows, men plattformoverskriftene dine ser ut som Linux, blir du blokkert. Denne avvikelsen er en primær årsak til skrapingsfeil.

Å administrere forespørselsoverskrifter riktig kan redusere blokkeringsrater med opptil 40 % før du i det hele tatt roterer en proxy.

# Dette blir ofte blokkert umiddelbart

importforespørsler

overskrifter = {'Brukeragent': 'Mozilla/5.0'}

respons = requests.get('https://example.com', headers=headers)

Decodo konstruerer automatisk gyldige, konsistente toppprofilerDet sikrer at Accept-Language, Referrer og plattformhintene dine samsvarer med nettleserversjonen du etterligner.

2. Den skjulte fellen: TLS-fingeravtrykk

Det er her de fleste tilpassede skrapere mislykkes.

Når skriptet ditt starter en sikker HTTPS-tilkobling, utfører det et «håndtrykk» med serveren. Rekkefølgen og parameterne for dette håndtrykket skaper et unikt fingeravtrykk, ofte kalt en JA3-hash.

Pythons forespørselsbibliotek har et helt annet håndtrykk enn et ekte Chrome-nettleserCloudflare ser denne forskjellen umiddelbart. Selv om overskriftene dine er perfekte, vil TLS fingeravtrykksomgåelse Strategien kan mislykkes hvis håndtrykket avslører deg.

Decodo håndterer dette på backend. Den modifiserer lavnivå-SSL/TLS-forhandlingene slik at de ser nøyaktig ut som en ekte bruker som surfer fra en hjemmetilkobling.

Beste taktikker for å skrape enkeltsidesapplikasjoner trygt

Enkeltsidessøknader (SPA-er) er beryktet for å være vanskelige å skrape. De laster inn data asynkront. En skraper kan utløse sideinnlastingen, men hvis den trekker ut data for tidlig, får den ingenting.

Du må skrape spa-nettsteder ved å vente til «Network Idle»-tilstanden. Dette betyr at nettleseren venter til alle bakgrunnskall av API-et er fullført før den henter HTML-koden.

Å implementere dette manuelt med verktøy som Puppeteer eller Selenium er ustabilt. Skript krasjer. Elementer endrer ID-navn. Minnelekkasjer gjør serveren din tregere.

Decodo's Nettskraping API-et forenkler dette. Du sender en forespørsel, og Decodo starter nettleseren, gjengir JavaScript-koden, venter på at nettverket skal stabilisere seg og returnerer den rene HTML-koden.

Bygg skalerbare, uoppdagbare skrapingsarbeidsflyter med Decodo

Det er dyrt å bygge et headless browser scraping grid. Du må oppdatere Chrome-drivere, rotere tusenvis av IP-adresser og stadig oppdatere koden din når Cloudflare endrer algoritmen sin.

Decodo tilbyr en spesialisert automatisert nettleserskraping infrastruktur som håndterer det tunge løftet.

Viktige funksjoner for unnvikelse

Plattformen er bygget for å omgå blokkeringer av nettskraping ved å fokusere på mimikk og pålitelighet:

Hurtigintegrasjonsguide: Bruk av Decodos skraping-API

Slik er det enkelt å bytte fra et blokkert lokalt skript til Decodo. Du trenger ikke å administrere nettleseren selv.

import requests

# Decodo API Endpoint

url = "https://api.decodo.com/v1/scrape"

payload = {

"url": "https://difficult-site.com/products",

"render_js": True, # Activates Headless Browser

"wait_for_selector": ".product-price", # Waits for dynamic content

"country": "US" # Uses premium US residential proxies

}

headers = {

"Authorization": "Bearer YOUR_DECODO_API_KEY",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

if response.status_code == 200:

print("Scraping Successful!")

print(response.json()['content'])

else:

print("Error:", response.text)Legg merke til enkelheten. Du importerer ikke Selenium. Du laster ikke ned Chromedriver. Du sier bare til Decodo: «Jeg trenger denne URL-en, og vær så snill å gjengi den.» Javascript».

Velge mellom Puppeteer, Selenium eller Decodo API

Mange utviklere starter med verktøy med åpen kildekode. Det hjelper å forstå avveiningene mellom puppeteer kontra selenium kontra API.

selen: Flott for testing, men tregt og lett å oppdage. Det krever store endringer for å unngå det. anti-bot-deteksjon unnvikelsesutløsere.

Dukkespiller/dramatiker: Raskere og bedre for javascript-gjengivelse for scraping. Det krever imidlertid betydelig DevOps-kunnskap å vedlikeholde en flåte av disse instansene. Du må fortsatt løse proxy- og fingeravtrykksproblemene manuelt.

Decodo API: Den mest effektive løsningen. Den gir kraften til en headless nettleser uten vedlikehold. Den løser problemet med omgåelse av TLS-fingeravtrykk og headerhåndtering rett ut av boksen.

Med Decodo API sparer team utviklingstid, reduserer infrastrukturkostnader og oppnår høyere suksessrater for skraping på tvers av komplekse, moderne nettsteder.

Skrap smartere, ikke hardere: La Decodo håndtere det

Internett blir mer lukket. Unngåelse av anti-bot-deteksjon er et våpenkappløp. Hvis du bruker tiden din som ingeniør på å bekjempe Cloudflare, bruker du ikke tid på å analysere dataene dine.

Du trenger ikke å bygge en kompleks infrastruktur for å skrape dynamiske nettstederVed å bruke Decodo får du tilgang til headless browser scraping i bedriftsklassen, korrekt øktadministrasjon og avansert fingeravtrykksrotasjon.

Slutt å bli blokkert. La Decodo håndtere nettleserens kompleksitet mens du fokuserer på innsikten.

AiMojo anbefaler:

BONUS: Få våre 200 dollarAI «Mestringsverktøysett» GRATIS når du registrerer deg!

BONUS: Få våre 200 dollarAI «Mestringsverktøysett» GRATIS når du registrerer deg!

![7 beste gratis AI Menneskelige generatorer i 2026 [Anmeldt og rangert]](https://aimojo.io/wp-content/uploads/2023/11/Best-Free-AI-Human-Generator-100x100.webp)