MiniMax-M1, den nyeste LLM-en med åpen kildekode fra Shanghais MiniMaxAI, dominerer AI forum – og med god grunn. Langt fra en rutineutgivelse, kombinerer denne resonneringsmotoren en svimlende Kontekstvindu på 1 million tokens med en hybrid blanding av eksperter og den proprietære «Lightning Attention».

Tidlige brukere hyller det som 2025s mest disruptive åpen kildekode gjennombrudd, lovende utviklere, forskere og AI tinkerers enestående skala uten den vanlige maskinvareavgiften.

Men kan MiniMax-M1 – og dens tilhørende Agent – virkelig innfri den store nyheten? Her er hvorfor denne modellen kan omdefinere LLM-er, autonome agenter og neste generasjons arbeidsflyter.

Hva er MiniMax-M1? Spesifikasjonene som teller

MiniMax-M1 er en åpen, storskala hybrid-oppmerksomhetsresonneringsmodell, spesialbygd for langformsresonnering, kompleks koding og agentiske arbeidsflyter. Her er det som skiller den:

Du kan hente modellvektene og koden på [GitHub], eller prøve det umiddelbart på Hugging Face og det offisielle MiniMax-chatgrensesnittet.

MiniMax-M1 Viktige funksjoner og innovasjoner

1. Lynrask oppmerksomhet: Hastighet uten å ofre dybde

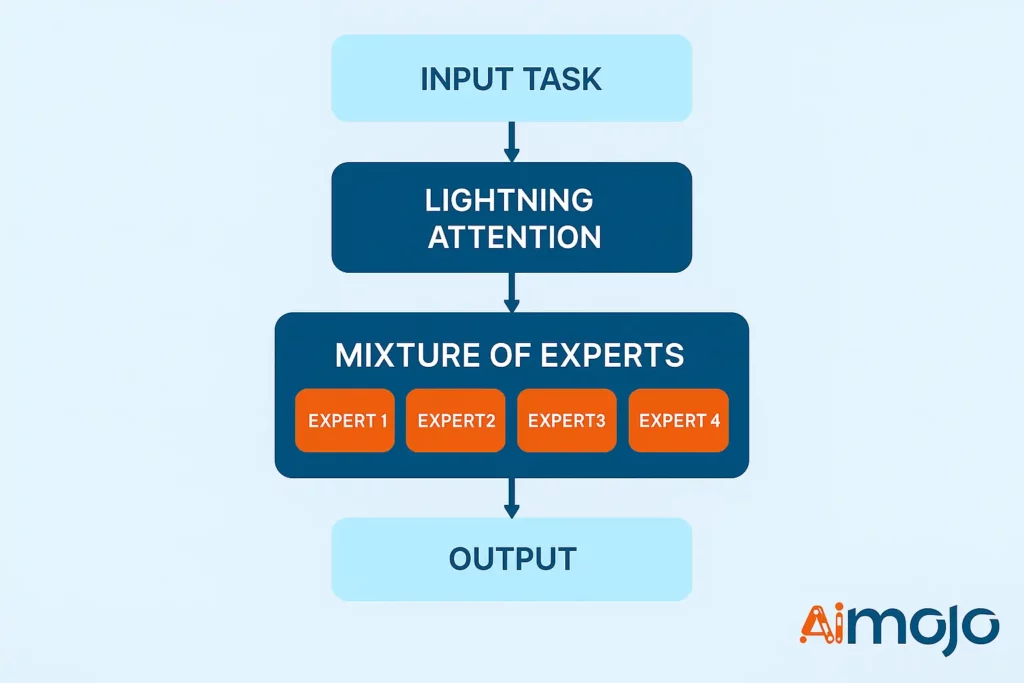

Tradisjonelle transformatorer kveles av lange kontekster på grunn av kvadratiske oppmerksomhetskostnader. MiniMax-M1s Lightning Attention reduserer inferenskostnadene, noe som gjør det mulig å håndtere massive dokumenter, kodebaser eller til og med hele bokserier i én omgang – uten å trenge en superdatamaskin.

2. Ekspertmiks (MoE): Smartere, ikke bare større

I stedet for å brute-forcere alle 456B-parametere for hvert token, aktiverer M1 bare den relevante “eksperter«for hver inngang. Dette betyr at du får skalaen til en megamodell, men med effektiviteten til en mye mindre modell – perfekt for reelle arbeidsbelastninger og skydistribusjoner.

3. CISPO forsterkningslæring: Effektiv og stabil opplæring

MiniMaxs tilpassede RL-algoritme, CISPO (Clipped Importance Sampling Policy Optimization), klipper samplingsvekter i stedet for tokenoppdateringer. Dette holder treningen stabil selv i stor skala, og hjelper modellen med å resonnere gjennom komplekse problemer med flere trinn – som matte-OL-gåter, fullstabelkoding, eller besvarelse av spørsmål med flere hopp.

4. 1M Token-kontekst: Slutt på oppkuttede kontekster

Glem dagene med å dele opp dokumenter eller miste oversikten over kontekst i lange samtaler. M1s innebygde 1M tokenkontekst Window er et beist – noe som gjør det ideelt for juridisk analyse, bokoppsummeringer, refaktorering av kodebase eller enhver annen arbeidsflyt der minne og kontinuitet er viktig.

5. Bruk av agentiske verktøy og multimodalitet

M1 er ikke bare en chatbot – det er grunnlaget for MiniMax Agent, en allsidig AI agent i stand til å:

MiniMax-M1 i aksjon: Arbeidsflyter og ytelse i den virkelige verden

Koding og programvareutvikling

På LiveCodeBench oppnår MiniMax-M1 solide 65 % – og matcher eller slår andre åpne modeller som Qwen3-235B og DeepSeek-R1. FullStackBench-poengsummene (68.3 %) viser at det ikke bare handler om kodesnutter, men fullstack-kode som er klar for produksjon. MiniMax-agenten kan generere, teste og til og med distribuere webapper og spill med én enkelt ledetekst.

Matematisk resonnement

M1 er en matteentusiast: 86 % på AIME 2024, 96.8 % på MATH-500, og sterke resultater på flerhopps-resonneringsoppgaver. I motsetning til mange andre LLM-er som hallusinerer eller går seg vill i logiske gåter, lar M1s hybride oppmerksomhet den «tenke» gjennom komplekse resonnementskjeder – noe som gjør den til en favoritt for matematikkforskere og -pedagoger.

Lang kontekstforståelse

På OpenAI-MRCR (128 1 tokens) scorer M73.4 XNUMX %, og det er en av få modeller som holder seg nøyaktig selv når kontekstvinduer strekker seg til en million tokens. For oppgaver som gjennomgang av juridiske dokumenter, forskningssyntese eller kodebaseanalyse, dette er en stor sak.

Agentiske arbeidsflyter

MiniMax Agent er mer enn en demo – det er produksjonsklart AI assistent det kan:

Benchmark Showdown: Hvordan står MiniMax-M1 seg i forhold til hverandre?

Her er en rask titt på MiniMax-M1s ytelse på viktige benchmarks, sammenlignet med topp åpne og kommersielle modeller:

| Oppgave/Referansepunkt | MiniMax-M1-80K | DeepSeek-R1 | Qwen3-235B | Claude 4 opus | OpenAI o3 | Gemini 2.5 Pro |

|---|---|---|---|---|---|---|

| AIME 2024 (Matematikk) | 86.0 | 79.8 | 85.7 | 76.0 | 91.6 | 92.0 |

| LiveCodeBench (koding) | 65.0 | 55.9 | 65.9 | 56.6 | 75.8 | 77.1 |

| SWE-benk (programvare) | 56.0 | 49.2 | 34.4 | 72.5 | 69.1 | 67.2 |

| OpenAI-MRCR (128K) | 73.4 | 35.8 | 27.7 | 48.9 | 56.5 | 76.8 |

| TAU-benk (verktøybruk) | 62.0 | 44.0 | 34.7 | 59.6 | 52.0 | 50.0 |

???? OBS:

M1 er åpen og gratis å bruke, mens mange konkurrenter er lukkede eller krever store API-avgifter.

MiniMax Agent: Neste generasjon AI Agent bygget på M1

MiniMax Agent, nå i beta, er en universell AI agent utviklet for langsiktige oppgaver i flere trinn. Her er hva du kan forvente:

Og ja, du får det 1,000 gratis studiepoeng å eksperimentere med Agenten – ingen kredittkort kreves.

Unike fordeler og statistikk: Hvorfor MiniMax-M1 er et must å prøve

Slik kommer du i gang med MiniMax-M1 og Agent

Avsluttende tanker: Er MiniMax-M1 verdt hypen?

MiniMax-M1 er ikke bare enda en stor modell – det er en nytenkning av hvordan åpen kildekode AI burde fungere: massiv kontekst, praktisk effektivitet og agentarbeidsflyter klare for bruk i den virkelige verden.

Hvis du er bygning AI apps, eksperimenterer med agentrammeverk, eller bare ønsker en modell som kan håndtere de sprøeste spørsmålene og de lengste dokumentene dine, er M1 et must. Og med MiniMax Agent får du ikke bare svar – du får en co-pilot for koding, forskning og automatiseringsbehov.

Klar til å se hva en virkelig åpen, effektiv og kraftig LLM kan gjøre? Prøv MiniMax-M1 – og bli med på den neste bølgen av AI innovasjon.

BONUS: Få våre 200 dollarAI «Mestringsverktøysett» GRATIS når du registrerer deg!

BONUS: Få våre 200 dollarAI «Mestringsverktøysett» GRATIS når du registrerer deg!