De fusie van Meta's Llama 4-modellen met Microsoft's Het AutoGen-framework biedt nieuwe mogelijkheden voor het creëren van slimme, efficiënte AI agents. Door deze technologieën te combineren, kunnen ontwikkelaars applicaties bouwen die natuurlijke taal kunnen verwerken, afbeeldingen kunnen begrijpen, complexe problemen kunnen doorgronden en kunnen samenwerken met andere agents om taken uit te voeren.

Lama 4 biedt indrukwekkende multimodale mogelijkheden en uitgebreide contextvensters, terwijl Autogen Biedt een gestructureerd raamwerk voor het orkestreren van meerdere agents in collaboratieve workflows. Samen vormen ze een krachtige toolkit voor de volgende generatie. AI toepassingen.

Deze gids leidt u door het proces van bouwt AI agenten die deze tools gebruiken, met praktische codevoorbeelden en implementatiestrategieën voor ontwikkelaars van alle niveaus.

Wat maakt Lama 4 en Autogen de perfecte match?

meta's De familie Llama 4 valt op in de AI wereld met zijn native multimodale mogelijkheden en vroege fusie-aanpak. In combinatie met AutoGen—Microsoft's raamwerk voor het bouwen van conversationele multi-agentsystemen—ontwikkelaars kunnen creëren AI agenten die efficiënt redeneren, samenwerken en zich aanpassen.

Llama 4-modellen, inclusief Scout- en Maverick-varianten, bieden vroege-fusie multimodale verwerking die tekst, afbeeldingen en videoframes vanaf het begin als één reeks tokens behandelt. Deze mogelijkheid, gecombineerd met AutoGen's flexibele agentarchitectuur, maakt het mogelijk om AI oplossingen die kan:

Laat's Bouw een praktisch multi-agentsysteem dat deze mogelijkheden demonstreert door een generator voor projectvoorstellen te maken die de vereisten van de klant analyseert en op maat gemaakte projectvoorstellen genereert.

Een praktische bouw AI Agentsysteem

Laat's Creëer een multi-agentsysteem dat freelancers helpt bij het genereren van op maat gemaakte offertes. Ons systeem zal:

- Verzamel klantvereisten

- Verzamel kwalificaties voor freelancers

- Genereer professionele offertes met passende prijzen.

Stap 0: Uw omgeving instellen

Installeer eerst de benodigde pakketten:

python

pip install autogen-agentchat~=0.2

pip installeer ipython

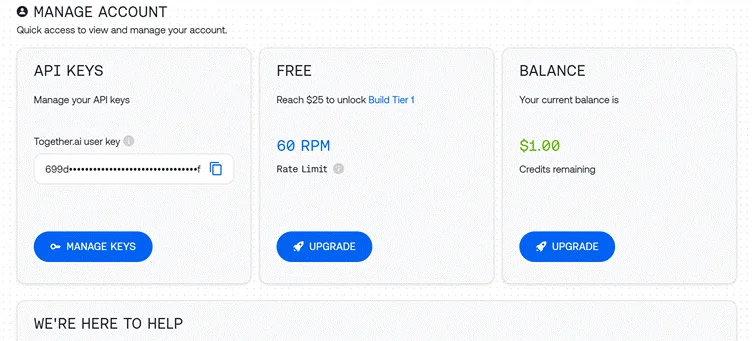

Stap 1: API-toegang configureren

We gebruiken de Together API om toegang te krijgen tot Llama 4:

python

import os

import autogen

from IPython.display import display, Markdown

# Load API key from file

with open("together_ai_api.txt") as file:

LLAMA_API_KEY = file.read().strip()

os.environ["LLAMA_API_KEY"] = LLAMA_API_KEY

# Configure LLM settings

llm_config = {

"config_list": [

{

"model": "meta-llama/Llama-4-Scout", # Use Scout for efficiency

"api_key": os.environ.get("LLAMA_API_KEY"),

"base_url": "https://api.together.xyz/v1",

}

],

"temperature": 0.2, # Lower for more consistent outputs

"timeout": 180

}Stap 2: Gespecialiseerde agenten creëren

Ons systeem vereist drie verschillende agenten met specifieke rollen:

Client-invoeragent

python

# Agent 1: Interfaces with the human user

client_agent = autogen.UserProxyAgent(

name="Client_Input_Agent",

human_input_mode="ALWAYS", # Always gets input from human

max_consecutive_auto_reply=1,

is_termination_msg=lambda x: x.get("content", "").rstrip().endswith("TERMINATE"),

system_message="""Act as the primary contact between the human user and other agents.

First, collect initial project details (requirements, timeline, budget).

When asked questions by the Scope Architect, relay user's answers about skills and experience.

Type TERMINATE when the proposal is satisfactory or the user wants to stop."""

)Deze agent fungeert als brug tussen de menselijke gebruiker en de AI systeem, informatie verzamelen en het presenteren van het eindresultaat.

Scope Architect Agent

python

# Agent 2: Analyzes requirements and asks qualifying questions

scope_architect_agent = autogen.AssistantAgent(

name="Scope_Architect",

llm_config=llm_config,

max_consecutive_auto_reply=1,

system_message="""You are a Scope Architect who analyzes project requirements.

After receiving initial details from Client_Input_Agent, ask targeted questions about:

- The freelancer's relevant past projects and experience

- Their key skills and tools for this specific project

- Estimated completion time for the described work

Once you have sufficient information, create a concise summary of BOTH

the project requirements AND freelancer qualifications for the Rate Recommender."""

)De Scope Architect fungeert als de eisenanalist en verzamelt cruciale informatie die nodig is voor een nauwkeurig voorstel.

Beoordeel Aanbeveler Agent

python

# Agent 3: Creates structured proposal with pricing

rate_recommender_agent = autogen.AssistantAgent(

name="Rate_Recommender",

llm_config=llm_config,

max_consecutive_auto_reply=1,

system_message="""Generate professional project proposals based on gathered information.

Wait for the Scope Architect's complete summary before proceeding.

Include these sections in your proposal:

1. Custom Introduction: Personalized greeting referencing client and project

2. Project Scope & Timeline: Clear deliverables with timeline estimates

3. Pricing Options: 2-3 tiers (hourly/fixed/retainer) with justification

4. Next Steps: Brief suggestion for kickoff discussion

Format using proper markdown. Avoid commentary - deliver only the final proposal."""

)Deze agent produceert het eindproduct en zet de verzamelde informatie om in een gestructureerd voorstel.

Stap 3: Een helperagent maken (optioneel)

python

# Optional helper to initiate the conversation

user_proxy = autogen.UserProxyAgent(

name="user_proxy",

max_consecutive_auto_reply=1,

llm_config=llm_config,

system_message="Initiate the conversation between agents."

)Stap 4: De groepsgesprek instellen

Nu gaan we de conversatieomgeving creëren waarin agenten kunnen samenwerken:

python

# Group Chat Configuration

groupchat = autogen.GroupChat(

agents=[client_agent, scope_architect_agent, rate_recommender_agent],

messages=[],

max_round=4, # Prevent infinite loops

speaker_selection_method="round_robin", # Orderly participation

)

# Conversation Manager

manager = autogen.GroupChatManager(

groupchat=groupchat,

llm_config=llm_config,

system_message="""Direct the conversation flow through these steps:

1. Client_Input_Agent shares project details

2. Scope_Architect asks qualifying questions

3. Client_Input_Agent provides freelancer information

4. Scope_Architect summarizes all information

5. Rate_Recommender creates the final proposal

End when the proposal is complete or Client_Input_Agent says TERMINATE."""

)Deze opstelling zorgt voor een georganiseerd gesprek doorstroming met duidelijke rollen en verantwoordelijkheden.

Stap 5: Het gesprek starten

Laat's Start onze agentenworkflow:

python

# Begin the proposal generation process

print("Starting the proposal generation process...")

print("Please provide project details when prompted.")

initial_message = """

Begin the proposal creation process:

1. First collect project details from the user

2. Then gather freelancer qualifications

3. Finally generate a professional proposal

"""

user_proxy.initiate_chat(

manager,

message=initial_message

)Stap 6: Het definitieve voorstel extraheren

Zodra het gesprek is afgerond, halen we het definitieve voorstel eruit en tonen dit:

python

# Find and display the proposal

chat_history = manager.chat_messages[client_agent]

final_proposal = None

for msg in reversed(chat_history):

if msg.get("role") == "assistant" and msg.get("name") == rate_recommender_agent.name:

if "Introduction" in msg.get("content", ""):

final_proposal = msg

break

if final_proposal:

proposal_text = final_proposal.get("content", "Proposal not found.")

try:

display(Markdown(proposal_text))

except NameError:

print("\n--- FINAL PROPOSAL ---\n")

print(proposal_text)

else:

print("Could not find the final proposal in the conversation.")Verbeterde technieken voor het bouwen van betere AI Agenten

Hoewel onze basisimplementatie goed werkt, zijn hier enkele geavanceerde benaderingen om uw AI krachtigere agenten:

A.Integratie van externe tools

Een van AutoGen's Een van de sterke punten is de mogelijkheid om agenten te voorzien van externe tools. Hier's hoe u uw tariefaanbeveler kunt geven marktonderzoek mogelijkheden:

python

# Define function for market research

def research_market_rates(job_type, experience_level):

"""Access external data for pricing information"""

# This would typically connect to an API or database

# Using simple dictionary for demonstration

rate_data = {

"web_development": {

"beginner": "$30-50/hr",

"intermediate": "$50-90/hr",

"expert": "$90-200/hr"

},

"data_analysis": {

"beginner": "$25-45/hr",

"intermediate": "$45-85/hr",

"expert": "$85-180/hr"

}

}

# Retrieve appropriate rate range

try:

return rate_data[job_type][experience_level]

except KeyError:

return "Rate information not available for this combination"

# Configure LLM with function

rate_recommender_config = {

**llm_config,

"functions": [

{

"name": "research_market_rates",

"description": "Find current market rates for specific job types and experience levels",

"parameters": {

"type": "object",

"properties": {

"job_type": {

"type": "string",

"enum": ["web_development", "data_analysis", "content_writing", "graphic_design"]

},

"experience_level": {

"type": "string",

"enum": ["beginner", "intermediate", "expert"]

}

},

"required": ["job_type", "experience_level"]

}

}

]

}

# Update the Rate Recommender with function capabilities

rate_recommender_agent = autogen.AssistantAgent(

name="Rate_Recommender",

llm_config=rate_recommender_config,

system_message="""Generate proposals with accurate market-based pricing.

Use the research_market_rates function to get current pricing information."""

)

# Register the function with the agent

rate_recommender_agent.register_function(

function_map={"research_market_rates": research_market_rates}

)Dankzij deze verbetering heeft de Tariefaanbeveler toegang tot externe prijsgegevens, waardoor voorstellen nauwkeuriger en concurrerender worden.

B. Implementatie van persistent geheugen

Door geheugenmogelijkheden toe te voegen, kunnen agenten de context behouden bij meerdere interacties:

python

# Create a simple memory system for agents

class AgentMemory:

def __init__(self):

self.memories = {}

def store(self, agent_name, key, value):

"""Save information to agent memory"""

if agent_name not in self.memories:

self.memories[agent_name] = {}

self.memories[agent_name][key] = value

def retrieve(self, agent_name, key=None):

"""Get information from agent memory"""

if agent_name not in self.memories:

return None

if key:

return self.memories[agent_name].get(key)

else:

return self.memories[agent_name]

# Initialize memory

memory = AgentMemory()

# Example of storing client information

def process_client_input(message):

"""Extract and store client information"""

# This would typically use more sophisticated parsing

if "budget:" in message.lower():

budget = message.split("budget:")[1].strip().split("\n")[0]

memory.store("client", "budget", budget)

if "timeline:" in message.lower():

timeline = message.split("timeline:")[1].strip().split("\n")[0]

memory.store("client", "timeline", timeline)

return message

# Add memory hook to client agent

def memory_hook(recipient, messages, sender, config):

"""Process and store incoming messages"""

if sender.name == "Client_Input_Agent" and messages:

process_client_input(messages[0].get("content", ""))

return False, None # Continue normal processing

# Register the hook

client_agent.register_hook("memory_hook", memory_hook)Dankzij dit geheugensysteem kunnen agenten belangrijke informatie tijdens het gesprek onthouden, ook als deze niet expliciet in recente berichten is genoemd.

Praktische toepassingen die verder gaan dan het genereren van voorstellen

De architectuur die we hebben gebouwd, kan worden aangepast aan veel andere bedrijfsscenario's:

A. Inhoudscreatiepijplijn

Pas onze agenten aan zodat ze de workflows voor de productie van content kunnen afhandelen:

B. SEO-analysesysteem

Creëer een gespecialiseerde SEO-tool met deze middelen:

C. Automatisering van klantenondersteuning

Transformeer de architectuur naar een ondersteunend systeem:

Tips voor prestatieoptimalisatie

Voor productieklaar AI agentsystemen:

- Slimme modelselectie: Gebruik lichtgewicht modellen voor eenvoudigere taken (intake, routing) en reserveer grotere modellen voor complexere redeneringen (het opstellen van voorstellen, prijsbepaling).

- Caching implementeren: Sla frequente reacties op om API-aanroepen te verminderen en de responstijd te verbeteren:

python

# Simple cache implementation

response_cache = {}

def get_cached_response(query_key, generator_function, ttl=3600):

"""Get cached response or generate new one"""

if query_key in response_cache:

timestamp, response = response_cache[query_key]

if time.time() - timestamp < ttl:

return response

# Generate fresh response

new_response = generator_function()

response_cache[query_key] = (time.time(), new_response)

return new_responseBatchverwerking: Verwerk onafhankelijke taken parallel in plaats van sequentieel:

python

import asyncio

async def run_parallel_research():

task1 = asyncio.create_task(research_agent.async_run("Research topic A"))

task2 = asyncio.create_task(research_agent.async_run("Research topic B"))

task3 = asyncio.create_task(research_agent.async_run("Research topic C"))

results = await asyncio.gather(task1, task2, task3)

return resultsDe technische voorsprong van Llama 4 voor AI Agenten

Lama 4's Specifieke eigenschappen maken het bijzonder geschikt voor agenttoepassingen:

- Vroege multimodale fusiearchitectuur zorgt ervoor dat agenten tekst en afbeeldingen op natuurlijke wijze tegelijk kunnen verwerken, in tegenstelling tot eerdere benaderingen waarbij de modaliteiten gescheiden werden gehouden.

- Ontwerp met een mix van experts zorgt ervoor dat het model alleen de relevante parameters voor elke taak activeert, waardoor de reacties sneller en nauwkeuriger worden.

- Uitzonderlijke verwerking van lange contexten (tot 10 miljoen tokens in Scout) zorgt ervoor dat agenten de gespreksgeschiedenis kunnen bijhouden en lange documenten kunnen raadplegen zonder dat de samenhang verloren gaat.

- Meertalige mogelijkheden in 12 officieel ondersteunde talen maken agents toegankelijk voor gebruikers overal ter wereld.

hes, je kunt creëren AI agenten die niet alleen verzoeken begrijpen en beantwoorden, maar ook actief samenwerken om complexe problemen op te lossen – en die echt de volgende generatie vertegenwoordigen AI toepassingen.

Top veelgestelde vragen

Waarin verschilt Llama 4 van andere taalmodellen?

Llama 4 gebruikt een vroege fusiebenadering voor multimodale verwerking en een spaarzame Mixture of Experts-architectuur voor efficiëntie. Het behandelt tekst, afbeeldingen en video als één enkele tokensequentie en activeert alleen relevante 'expert'-submodellen voor elke invoer.

Kan AutoGen werken met andere LLM's dan Llama 4?

Ja, AutoGen is model-agnostisch en kan met verschillende LLM's werken, waaronder OpenAI modellen, antropische modellen en andere open-source modellen zoals Mistral AI of DeepSeek.

Bouwt AI agenten geavanceerde programmeervaardigheden nodig hebben?

Niet per se. Met basiskennis van Python en een LLM-kennis kunt u agentworkflows opzetten en uitvoeren. AutoGen vereenvoudigt het proces van het aanmaken en coördineren van meerdere agents.

Kunnen deze AI agents op lokale hardware draaien?

Ja, AutoGen ondersteunt integratie met lokale LLM's via tools zoals Ollama, zodat u agents op uw eigen hardware kunt uitvoeren.

Hoe ga ik veilig om met API-sleutels in productie?

Bewaar API-sleutels in omgevingsvariabelen of beveiligde kluizen in plaats van in code. Gebruik de juiste authenticatie en encryptie voor productie-implementaties.

Kan ik de agents uitbreiden met aangepaste tools en API's?

Absoluut. Met AutoGen kunt u agenten verbinden met externe API's, databases en aangepaste tools, waardoor ze kunnen communiceren met verschillende systemen en services.

Aanbevolen metingen:

Conclusie

Gebouw AI Agenten met Llama 4 en AutoGen openen spannende mogelijkheden voor het creëren van intelligente, collaboratieve systemen die complexe taken aankunnen. De combinatie van Lama 4's multimodale intelligentie en AutoGen's flexibel agent-framework biedt ontwikkelaars krachtige tools om AI agenten die kunnen redeneren, samenwerken en zich kunnen aanpassen aan verschillende scenario's.

Ons voorbeeldproject – een multi-agent voorstelgenerator – demonstreert slechts één praktische toepassing van deze technologieën. Dezelfde principes kunnen worden toegepast op bouw AI agenten voor contentcreatie, gegevensanalyse, klantenservice, onderzoek, projectmanagement en vele andere domeinen.

Terwijl je je eigen bouwt AI Als u met Llama 4 en AutoGen werkt, onthoud dan deze belangrijke principes:

BONUS: Ontvang onze $200 “AI “Mastery Toolkit” GRATIS wanneer u zich aanmeldt!

BONUS: Ontvang onze $200 “AI “Mastery Toolkit” GRATIS wanneer u zich aanmeldt!

![10 beste conciërges AI Alternatieven met NSFW-chat [mei 2026]](https://aimojo.io/wp-content/uploads/2024/01/Best-Janitor-AI-Alternatives-100x100.webp)