ハグフェイスの重要な洞察

ハグフェイスとは?

ハグ顔 オープンソースである AI 機械学習モデル、データセット、デプロイメントツールの中央リポジトリとして機能するコラボレーションプラットフォーム。データサイエンティスト、MLエンジニア、 AI 製品チームは、テキスト生成、コンピュータビジョン、音声認識、マルチモーダルタスクなど、500,000万を超える事前学習済みモデルに即座にアクセスできます。

Gitベースのインフラストラクチャ上に構築されたこのプラットフォームは、チームがモデルの重みをバージョン管理し、トレーニングデータセットを共有し、本番環境にデプロイすることを可能にします。 AI Spaces経由で数分でデモを実施。企業向け 建物 AI 構成Hugging Faceは、プライベートモデルレジストリの管理に伴うインフラストラクチャのオーバーヘッドを排除し、本番環境に対応したホスティング、推論API、および共同作業ワークフローを提供することで、研究からリリースまでのモデル開発ライフサイクル全体を加速します。

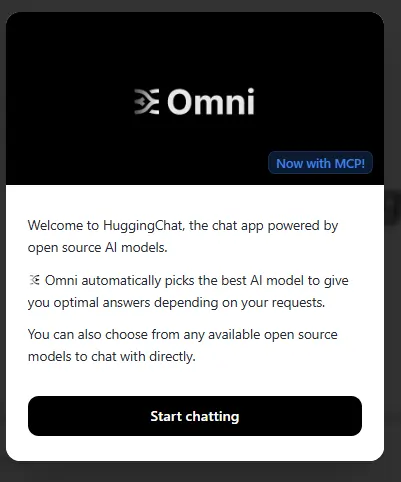

HuggingChatはハグフェイスです's 独自の無料オープンソース AI Llama、Mistral、Qwenなど119種類以上のオープンソースモデルに、単一の統合プラットフォームから誰でもアクセスできるチャットインターフェースです。リアルタイムのグラウンディングを実現する組み込みのウェブ検索機能、会話中に外部ツールを呼び出すためのMCPサポート、そしてあらゆる公開ハグフェイススペースをチャットに直接接続できるコミュニティツール機能などが含まれています。

AutoTrainは、 複雑なトレーニングスクリプトを作成する 事前学習済みモデルをカスタムデータセットに適用する場合、ラベル付きデータをアップロードし、ベースモデルを選択し、分かりやすいUIでハイパーパラメータを設定するだけで、プラットフォームが分散トレーニングを自動的に処理します。実際の使用では、AutoTrainを使用してBERT分類器を微調整するのに15分未満しかかかりませんでしたが、手動でトレーニングループを設定すると3時間以上かかりました。専任の機械学習インフラストラクチャエンジニアがいないチームにとって、これは大きな機能向上となります。

Spacesを使用すると、チームはGradioまたはStreamlitアプリケーションをPythonスクリプトから直接デプロイでき、プラットフォームがコンテナ化、HTTPS証明書、自動スケーリングを自動的に管理します。 感情分析 デモは1時間以内に稼働可能です。組み込みのOAuthサポート、シークレット管理、永続ストレージにより、DevOpsにおける設定作業の負担が大幅に軽減されます。クライアント向けデモ、概念実証ビルド、社内機械学習ツールなどにおいて、これはプラットフォーム上で最も生産性の高い機能の一つです。

Hugging Face上のすべてのモデルとデータセットは、大容量バイナリファイルに対応したLFSサポート付きのGitリポジトリに保存されています。これにより、チームはトレーニングコードだけでなく、モデルの重みや構成についても、完全なバージョン履歴、ブランチング、プルリクエスト、共同レビューを行うことができます。これは、機械学習アセット管理に適切なソフトウェアエンジニアリングの規律をもたらし、チームが実験を追跡したり、チェックポイントをロールバックしたり、プルリクエストを通じてコミュニティからの貢献を受け入れたりすることを可能にします。

Accelerateライブラリを使用すると、最小限のコード変更で複数のGPUとTPUに分散トレーニングを実行できます。 標準シングルGPU トレーニングスクリプトは、わずか5行程度のコードでマルチノード分散トレーニングに対応させることができます。これは、大規模な言語モデルや大量のコンピュータビジョンパイプラインを扱うチームにとって非常に重要です。これらのチームでは、本番環境では単一デバイスでのトレーニングは現実的ではないためです。

このプラットフォームは、PyTorch、TensorFlow、JAX、Scikit-learn、ONNXを標準でサポートしており、ライブラリの自動検出機能により、環境を問わず同じモデルをそのまま実行できます。Optimumライブラリは、ONNX変換や量子化などの本番環境向けモデル最適化機能を追加し、推論レイテンシを最大40%削減できます。多様なインフラストラクチャにデプロイするチームにとって、このクロスプラットフォーム対応は不可欠です。

ハグフェイスの料金プラン

| プラン名 | 費用 | 主な制限事項/機能 |

|---|---|---|

| コミュニティ | Free | 無制限のパブリックホスティング、100GBのストレージ、推論API、Spacesへのデプロイ、1日あたり1万回のAPI呼び出し |

| PROアカウント | $ 9 /月 | ストレージ容量の拡張、50ドル以上の専用推論クレジット、プライベートリポジトリ、優先的なSpacesホスティング |

| チーム | $ 20 /ユーザー/月 | PROの全機能に加え、SSO、ロールベースのアクセス制御、使用状況分析、共同プライベートリポジトリ |

| Enterprise | 50ユーザーあたり月額XNUMXドルから | SOC2/HIPAA準拠、専用サポート、SLA保証、高度なアクセス制御、カスタムストレージ |

長所と短所

- 500,000万以上の事前学習済みモデルが利用可能です。

- AutoTrainはプログラミングの知識を一切必要としません。

- 主要な機械学習ライブラリをすべてネイティブにサポートしています。

- モデル資産のためのGitベースのバージョン管理システム。

- 本番環境に対応したSpacesの導入環境が含まれています。

- 世界最高水準のドキュメントとチュートリアル。

- 機械学習初心者にとっては、学習曲線が非常に急峻だ。

- 無料プランのAPI利用制限が適用されます。

- 強化学習モデルの適用範囲は遅れている。

フェイスパックを使う価値はあるのか、それとも独自のスタックを構築する価値はあるのか?

独自のモデルレジストリ、推論パイプライン、およびデプロイメントインフラストラクチャの構築を検討しているチームは、Hugging Face の利用を見送る前に、実際のコストを考慮に入れるべきです。プライベート Git LFS ホスティング、コンテナ化された推論エンドポイント、アクセス制御、およびモデルドキュメントを使用して同等の機能を構築するには、通常、メンテナンスに月 40 時間以上の開発者作業時間が必要となります。

月額9ドルから20ドル/ユーザーという価格設定のHugging Faceは、セルフホスティング型の代替ソリューションと比較して、即座に投資対効果(ROI)を実現します。カスタムスタックが有利になるのは、独自のインフラストラクチャ要件がマネージドプラットフォームでは満たせない場合のみです。

ハグ顔の最高の代替案

| オープンソースのAI/MLコラボレーションプラットフォーム | オープンソースモデルへのアクセス | 展開の可搬性 |

|---|---|---|

| AWS セージメーカー | AWSでホストされ、厳選されたモデルに限定されます。 | AWSとの深い統合だが、ベンダーロックインを招く |

| 重みとバイアス | 実験追跡に特化しており、公開モデルライブラリはありません。 | 強力なMLOpsツールを備えているが、組み込みのホスティングレイヤーはない |

| Google 頂点 AI | Googleが厳選した、オープンソースの狭小品種を使ったモデルガーデン | GCPのみとの緊密な統合、エクスポートの柔軟性は限定的 |