Scrivi uno script. Funziona perfettamente su un sito di prova. Poi lo indirizzi a un grande rivenditore o a una piattaforma social. Improvvisamente, il tuo terminale si riempie di errori 403 Forbidden o di loop CAPTCHA infiniti.

L'era della semplice analisi HTML è finita.

Il web scraping moderno richiede più del semplice invio di una richiesta GET. I siti web di oggi sono applicazioni complesse protette da difese aggressive. Se vuoi bypassare i blocchi del web scraping, devi capire come i browser comunicano con i server.

Grandi piattaforme come Cloudflare, Akamai e Datadome fungono da gatekeeper. Analizzano ogni connessione in entrata. Verificano se sei un essere umano o uno script. Per aggirarli, servono strumenti che imitino perfettamente il comportamento umano.

Ti mostreremo come farlo scraping di siti web dinamici in modo efficace e perché delegare queste attività a Decodo è la mossa più intelligente per la tua pipeline di dati.

La necessità “headless”: perché le richieste semplici falliscono

In passato, i siti web inviavano pagine HTML complete dal server. Lo script scaricava il testo e tu estraevi i dati.

Ora, oltre il 70% dei moderni siti di e-commerce si basano sul rendering lato client (CSR). Quando si richiede un URL, il server invia una shell HTML vuota. Il contenuto effettivo (prezzi, inventario, descrizioni) viene caricato in un secondo momento tramite JavaScript.

Se si utilizza una libreria HTTP standard, si ottiene una shell vuota. I dati vengono persi completamente.

Per vedere il contenuto, è necessario rendering javascript per scrapingQuesto di solito significa eseguire un browser come Chrome o Firefox in background senza un'interfaccia grafica. Questo è noto come "headless". scraping del browser.

L'esecuzione di browser headless richiede molte risorse. Consuma RAM e CPU. E introduce anche un nuovo problema: il rilevamento.

Decifrare il codice dei sistemi anti-bot

I sistemi di sicurezza non guardano solo a te Indirizzo IPEsaminano il comportamento del tuo "browser".

Se si utilizza una libreria di automazione standard, questa lascia tracce. Potrebbe impostare una variabile come navigator.webdriver = true. Questo è un chiaro indizio. I sistemi anti-bot vedono questo flag e bloccano immediatamente l'utente.

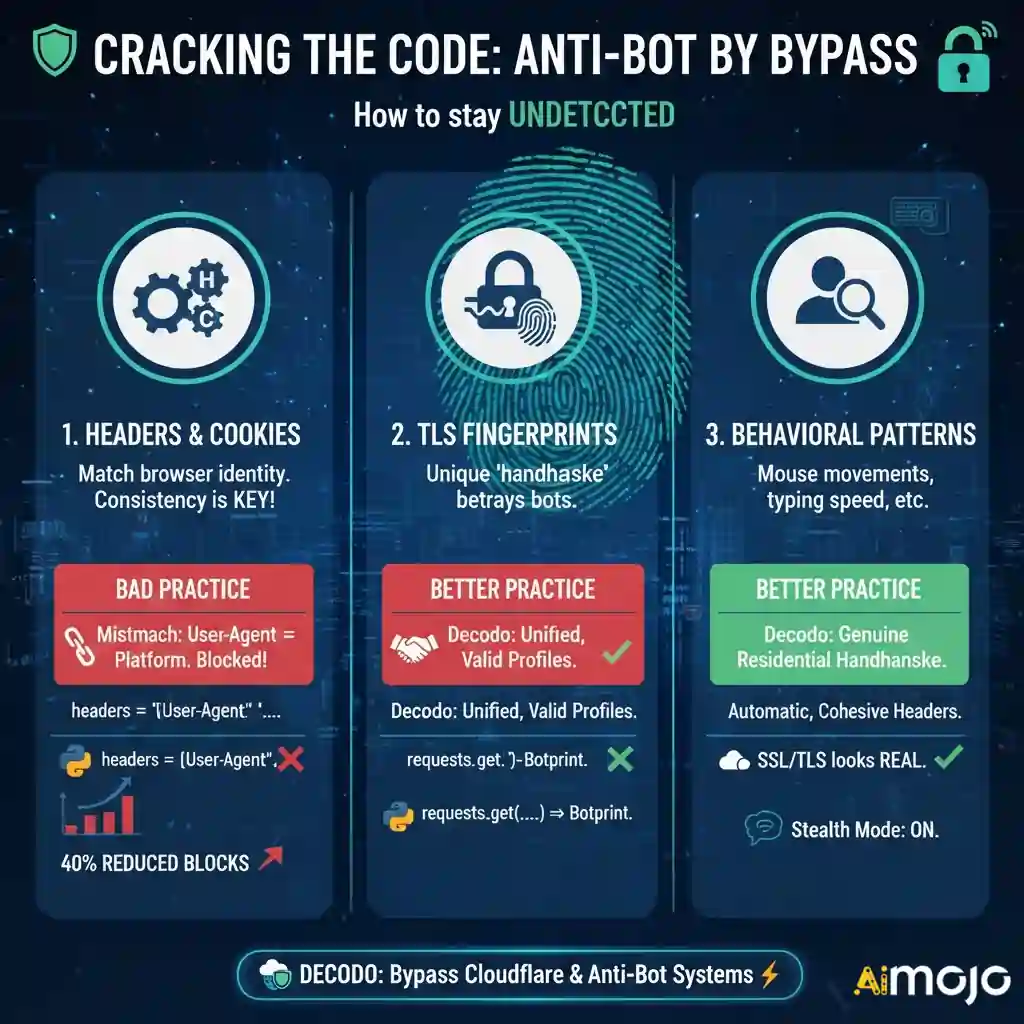

A bypassare lo scraping di Cloudflare protezioni, è necessario gestire tre livelli critici:

1. Perché la corrispondenza delle intestazioni è importante nel Web Scraping

Le intestazioni delle richieste indicano al server chi sei. La più nota è l'User-Agent. Tuttavia, modificare semplicemente la stringa User-Agent non è sufficiente.

Le intestazioni devono funzionare come un'unità coesa. Se invii uno User-Agent che dichiara di essere Chrome su Windows, ma le intestazioni della tua piattaforma sembrano Linux, verrai bloccato. Questa discrepanza è una delle cause principali dei fallimenti nello scraping.

Gestire correttamente le intestazioni delle richieste può ridurre i tassi di blocco fino al 40% prima ancora di ruotare un proxy.

# Questo spesso viene bloccato immediatamente

richieste di importazione

intestazioni = {'User-Agent': 'Mozilla/5.0'}

risposta = requests.get('https://example.com', headers=headers)

Decodo costruisce automaticamente dati validi e coerenti profili di intestazioneGarantisce che i suggerimenti Accept-Language, Referer e Platform corrispondano alla versione del browser che stai imitando.

2. La trappola nascosta: l'impronta digitale TLS

È qui che la maggior parte degli scraper personalizzati falliscono.

Quando lo script avvia una connessione HTTPS sicura, esegue un "handshake" con il server. L'ordine e i parametri di questo handshake creano un'impronta digitale univoca, spesso chiamata hash JA3.

La libreria delle richieste di Python ha una stretta di mano molto diversa da quella reale Browser ChromeCloudflare nota questa differenza all'istante. Anche se le tue intestazioni sono perfette, il tuo bypass dell'impronta digitale TLS La strategia potrebbe fallire se la stretta di mano ti tradisce.

Decodo gestisce questo aspetto nel backend, modificando la negoziazione SSL/TLS di basso livello per farla apparire esattamente come un utente reale che naviga da una connessione residenziale.

Le migliori tattiche per estrarre in modo sicuro le applicazioni di una sola pagina

Applicazioni a pagina singola (SPA) Sono noti per essere difficili da estrarre. Caricano i dati in modo asincrono. Uno scraper potrebbe attivare il caricamento della pagina, ma se estrae i dati troppo presto, non ottiene nulla.

Per eseguire lo scraping dei siti web delle spa, è necessario attendere lo stato "Network Idle". Ciò significa che il browser attende il completamento di tutte le chiamate API in background prima di acquisire il codice HTML.

L'implementazione manuale con strumenti come Puppeteer o Selenium è instabile. Gli script si bloccano. Gli elementi cambiano i nomi degli ID. Le perdite di memoria rallentano il server.

Decodo's Scraping Web L'API semplifica tutto questo. Si invia una richiesta e Decodo avvia il browser, esegue il rendering del codice JavaScript, attende che la rete si stabilizzi e restituisce il codice HTML pulito.

Crea flussi di lavoro di scraping scalabili e non rilevabili con Decodo

Costruire una griglia di scraping del browser headless è costoso. Bisogna applicare patch ai driver di Chrome, ruotare migliaia di IP e aggiornare costantemente il codice quando Cloudflare modifica il suo algoritmo.

Decodo offre una specializzazione scraping automatico del browser infrastrutture che gestiscono i lavori più pesanti.

Caratteristiche principali per Evasion

La piattaforma è costruita per bypassare i blocchi del web scraping concentrandosi su mimetismo e affidabilità:

Guida rapida all'integrazione: utilizzo dell'API di scraping di Decodo

Ecco quanto è semplice passare da uno script locale bloccato a Decodo. Non è necessario gestire il browser personalmente.

import requests

# Decodo API Endpoint

url = "https://api.decodo.com/v1/scrape"

payload = {

"url": "https://difficult-site.com/products",

"render_js": True, # Activates Headless Browser

"wait_for_selector": ".product-price", # Waits for dynamic content

"country": "US" # Uses premium US residential proxies

}

headers = {

"Authorization": "Bearer YOUR_DECODO_API_KEY",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

if response.status_code == 200:

print("Scraping Successful!")

print(response.json()['content'])

else:

print("Error:", response.text)Nota la semplicità. Non stai importando Selenium. Non stai scaricando Chromedriver. Devi semplicemente dire a Decodo: "Ho bisogno di questo URL, per favore esegui il rendering JavaScript. "

Scegliere tra Puppeteer, Selenium o Decodo API

Molti sviluppatori iniziano con strumenti open source. È utile comprendere i compromessi tra puppeteer, selenium e API.

Selenio: Ottimo per i test, ma lento e facilmente rilevabile. Richiede modifiche sostanziali per evitarlo rilevamento anti-bot fattori scatenanti l'evasione.

Burattinaio/Drammaturgo: Più veloce e migliore per il rendering javascript per lo scraping. Tuttavia, gestire una flotta di queste istanze richiede una conoscenza approfondita di DevOps. È comunque necessario risolvere manualmente i problemi di proxy e fingerprinting.

API Decodo: Il percorso più efficiente. Offre la potenza di un browser headless senza la necessità di manutenzione. Risolve il problema del bypass del fingerprinting TLS e della gestione degli header in modo immediato.

Grazie all'API Decodo, i team risparmiano tempo di sviluppo, riducono i costi dell'infrastruttura e raggiungono percentuali di successo più elevate nello scraping su siti web moderni e complessi.

Raschiare in modo più intelligente, non più difficile: lascia che sia Decodo a occuparsene

Il web sta diventando sempre più isolato. Eludere il rilevamento anti-bot è una corsa agli armamenti. Se passi il tuo tempo di progettazione a combattere Cloudflare, non stai dedicando tempo ad analizzare i tuoi dati.

Non è necessario costruire un'infrastruttura complessa per scraping di siti web dinamiciUtilizzando Decodo, avrai accesso a un browser scraping headless di livello aziendale, a una corretta gestione delle sessioni e a una rotazione avanzata delle impronte digitali.

Smetti di rimanere bloccato. Lascia che Decodo gestisca le complessità del browser mentre tu ti concentri sugli insight.

AiMojo consiglia:

BONUS: Ottieni i nostri 200$ "AI "Mastery Toolkit" GRATIS se ti registri!

BONUS: Ottieni i nostri 200$ "AI "Mastery Toolkit" GRATIS se ti registri!

![7 migliori gratuiti AI Generatori Umani nel 2026 [Recensione e Classifica]](https://aimojo.io/wp-content/uploads/2023/11/Best-Free-AI-Human-Generator-100x100.webp)