Az ölelő arc kulcsfontosságú információkkal szolgál

Mi az az átölelő arc?

Átölelő arc nyílt forráskódú AI együttműködési platform, amely központi tárházként működik a gépi tanulási modellek, adatkészletek és telepítési eszközök számára. Adattudósokat, gépi tanulási mérnököket és AI A termékfejlesztő csapatok azonnali hozzáférést kapnak több mint 500 000 előre betanított modellhez szöveggenerálás, számítógépes látás, beszédfelismerés és multimodális feladatok terén.

A Git-alapú infrastruktúrára épülő platform lehetővé teszi a csapatok számára a modellsúlyok verziókövetését, a betanítási adatkészletek megosztását és az élő telepítést. AI demók perceken belül a Spaces-en keresztül. Vállalkozásoknak épület AI termékekA Hugging Face megszünteti a privát modellregisztrációk kezelésével járó infrastrukturális terheket, és éles üzemre kész tárhelyet, következtetési API-t és együttműködésen alapuló munkafolyamatokat biztosít, amelyek felgyorsítják a modellfejlesztés teljes életciklusát a kutatástól a kiadásig.

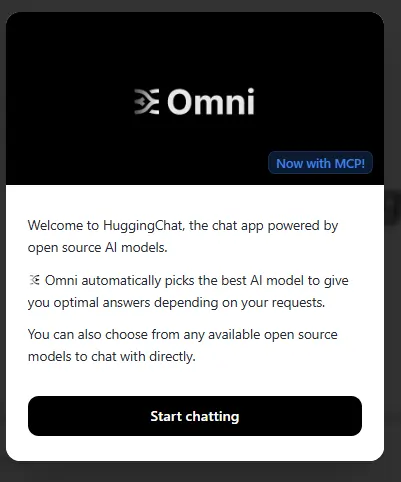

A HuggingChat az Ölelő Arc's saját, ingyenes, nyílt forráskódú AI Csevegőfelület, amely több mint 119 nyílt forráskódú modellhez biztosít hozzáférést, beleértve a Llama, Mistral és Qwen modelleket egyetlen, egységes platformon keresztül. Beépített webes keresést tartalmaz a valós idejű földeléshez, MCP-támogatást a külső eszközök meghívásához beszélgetés közben, valamint egy Közösségi eszközök funkciót, amellyel bármely nyilvános Hugging Face Space-t közvetlenül a csevegésbe lehet csatlakoztatni.

Az AutoTrain szükségtelenné teszi összetett képzési szkriptek írása amikor egy előre betanított modellt egyéni adathalmazhoz igazítunk. Feltöltünk címkézett adatokat, kiválasztunk egy alapmodellt, konfigurálunk hiperparamétereket egy letisztult felhasználói felületen keresztül, és a platform automatikusan kezeli az elosztott betanítást. A valós használatban egy BERT osztályozó finomhangolása az AutoTrain segítségével kevesebb mint 15 percet vett igénybe, szemben a manuális betanítási ciklus beállításához szükséges 3 vagy több órával. Azoknak a csapatoknak, amelyek nem rendelkeznek dedikált gépi tanulási infrastruktúra-mérnökökkel, ez jelentős képességnövekedést jelent.

A Spaces lehetővé teszi a csapatok számára, hogy Gradio vagy Streamlit alkalmazásokat telepítsenek közvetlenül Python szkriptekből, miközben a platform automatikusan kezeli a konténerizálást, a HTTPS tanúsítványokat és az automatikus skálázást. Egy működőképes hangulat elemzés A demó kevesebb mint egy óra alatt elérhető. A beépített OAuth-támogatás, a titkoskód-kezelés és az állandó tárolás leveszi a DevOps konfigurációs terheinek nagy részét a válladról. Kliensdemók, koncepcióbizonyítási buildek vagy belső gépi tanulási eszközök esetében ez a platform egyik legproduktívabb funkciója.

A Hugging Face összes modelljét és adatkészletét egy Git repository tárolja, amely LFS-támogatással rendelkezik a nagy bináris fájlokhoz. Ez azt jelenti, hogy a csapatok teljes verzióelőzményeket, elágazásokat, pull requesteket és közösen felülvizsgálható modellek súlyait és konfigurációit kapják meg, nem csak a betanító kódot. Megfelelő szoftverfejlesztési fegyelmet visz az ML-eszközkezelésbe, lehetővé téve a csapatok számára a kísérletek nyomon követését, az ellenőrzőpontok visszagörgetését és a közösségi hozzájárulások elfogadását pull requesteken keresztül.

Az Accelerate könyvtár lehetővé teszi a csapatok számára, hogy elosztott betanítást futtassanak több GPU-n és TPU-n minimális kódmódosítással. szabványos egy GPU-s A betanító szkript körülbelül öt kódsorban adaptálható több csomópontos elosztott betanításhoz. Ez kritikus fontosságú a nagy nyelvi modellekkel vagy nagy volumenű számítógépes látásfolyamatokkal dolgozó csapatok számára, ahol az egyeszközös betanítás nem megvalósítható éles környezetben.

A platform alapból támogatja a PyTorch, TensorFlow, JAX, Scikit-learn és ONNX kódokat, automatikus könyvtárészleléssel, amely ugyanazt a modellt futtatja a különböző környezetekben módosítás nélkül. Az Optimum könyvtár éles modelloptimalizálást is tartalmaz, beleértve az ONNX konverziót és kvantálást, ami akár 40%-kal is csökkentheti a következtetési késleltetést. A változatos infrastruktúrára telepítő csapatok számára ez a platformfüggetlen hordozhatóság elengedhetetlen.

Átölelő Arc-árazási tervek

| Plan név | Költség | Főbb korlátok / funkciók |

|---|---|---|

| Közösség | Ingyenes | Korlátlan nyilvános tárhely, 100 GB tárhely, Inference API, Spaces telepítés, napi 10 ezer API-hívás |

| PRO-fiók | $ 9 / hó | Bővített tárhely, 50 dollár feletti dedikált következtetési kreditek, privát adattárak, prioritást élvező Spaces tárhely |

| Csapat | $ 20 / felhasználó / hónap | Minden PRO funkció, plusz egyszeri bejelentkezés, szerepköralapú hozzáférés-vezérlés, használatelemzés, együttműködésen alapuló privát adattárak |

| Vállalkozás | 50 USD/felhasználó/hónaptól | SOC2/HIPAA megfelelőség, dedikált támogatás, SLA garanciák, fejlett hozzáférés-vezérlés, egyedi tárolás |

Érvek és ellenérvek

- Több mint 500 000 előre betanított modell érhető el.

- Az AutoTrainhez nulla programozási ismeretre van szükség.

- Natívan támogatja az összes főbb ML könyvtárat.

- Git-alapú verziókövetés modelleszközökhöz.

- Éles üzembe helyezésre kész Spaces rendszert is tartalmaz.

- Világszínvonalú dokumentáció és oktatóanyagok.

- Meredek tanulási görbe a gépi tanulás kezdőinek.

- Az ingyenes API-szintű díjszabásra korlátozások vonatkoznak.

- A megerősítéses tanulási modell lefedettsége elmarad.

Megéri az arc ölelése, mint a saját verem felépítése?

Azoknak a csapatoknak, amelyek saját modellnyilvántartás, következtetési folyamat és telepítési infrastruktúra kiépítését fontolgatják, a Hugging Face kihagyása előtt figyelembe kell venniük a tényleges költségeket. Az egyenértékű képességek beállítása privát Git LFS-tárhellyel, konténerizált következtetési végpontokkal, hozzáférés-vezérléssel és modelldokumentációval jellemzően havi 40 vagy több fejlesztői órát igényel karbantartásból.

A Hugging Face felhasználónként havi 9-20 dolláros költségével azonnali megtérülést biztosít bármely saját tárhelyen futó alternatívához képest. Az egyéni megoldások csak akkor nyernek, ha a mélyen zárt, saját infrastrukturális követelményeket egyetlen menedzselt platform sem tudja kielégíteni.

A legjobb ölelő arc alternatívák

| Nyílt forráskódú AI/ML együttműködési platform | Nyílt forráskódú modellhozzáférés | Telepítési hordozhatóság |

|---|---|---|

| AWS SageMaker | Az AWS által üzemeltetett és kurált modellekre korlátozva | Mély AWS integráció, de beszállítófüggőséget vezet be |

| Súlyok és torzítások | A kísérletkövetésre összpontosít, nincs nyilvános modellkönyvtár | Erős MLOps eszközök, de nincs beépített tárhelyréteg |

| Google Vertex AI | Google által kurált modellkert szűk, nyílt forráskódú változatossággal | Szoros, csak GCP-re épülő integráció korlátozott exportálási rugalmassággal |