Points clés de Hugging Face

Qu'est-ce qu'Hugging Face ?

Étreindre le visage est un logiciel libre AI Plateforme collaborative servant de référentiel central pour les modèles d'apprentissage automatique, les jeux de données et les outils de déploiement. Elle permet aux data scientists, aux ingénieurs en apprentissage automatique et aux AI Les équipes produit bénéficient d'un accès instantané à plus de 500 000 modèles pré-entraînés pour la génération de texte, la vision par ordinateur, la reconnaissance vocale et les tâches multimodales.

Construite sur une infrastructure basée sur Git, la plateforme permet aux équipes de contrôler les versions des pondérations des modèles, de partager des ensembles de données d'entraînement et de déployer en direct. AI Démonstrations via Spaces en quelques minutes. Pour les entreprises bâtiment AI produits pursHugging Face élimine les coûts d'infrastructure liés à la gestion des registres de modèles privés et fournit un hébergement prêt pour la production, une API d'inférence et des flux de travail collaboratifs qui accélèrent l'ensemble du cycle de vie du développement des modèles, de la recherche à la publication.

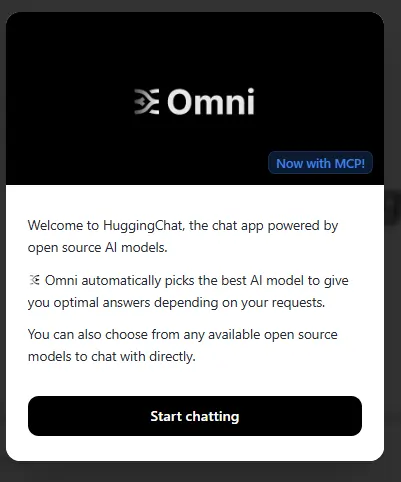

HuggingChat est Hugging Face's posséder une source libre et ouverte AI Interface de chat donnant accès à plus de 119 modèles open source, dont Llama, Mistral et Qwen, via une plateforme unique. Elle intègre une recherche web pour une mise à la terre en temps réel, la compatibilité MCP pour appeler des outils externes en cours de conversation, et une fonctionnalité Outils communautaires permettant d'intégrer directement n'importe quel espace Hugging Face Space public dans le chat.

AutoTrain élimine le besoin de rédiger des scénarios de formation complexes Lors de l'adaptation d'un modèle pré-entraîné à un jeu de données personnalisé, il suffit de télécharger les données étiquetées, de sélectionner un modèle de base et de configurer les hyperparamètres via une interface utilisateur intuitive. La plateforme gère ensuite automatiquement l'entraînement distribué. En pratique, l'ajustement fin d'un classificateur BERT via AutoTrain a pris moins de 15 minutes, contre 3 heures ou plus pour une configuration manuelle de la boucle d'entraînement. Pour les équipes ne disposant pas d'ingénieurs spécialisés en infrastructure ML, il s'agit d'un gain de capacité considérable.

Spaces permet aux équipes de déployer des applications Gradio ou Streamlit directement à partir de scripts Python, la plateforme gérant automatiquement la conteneurisation, les certificats HTTPS et la mise à l'échelle automatique. l'analyse des sentiments La démo peut être opérationnelle en moins d'une heure. La prise en charge intégrée d'OAuth, la gestion des secrets et le stockage persistant simplifient considérablement la configuration DevOps. Pour les démonstrations clients, les prototypes ou les outils de ML internes, c'est l'une des fonctionnalités les plus performantes de la plateforme.

Sur Hugging Face, chaque modèle et jeu de données est stocké dans un dépôt Git compatible avec LFS pour les fichiers binaires volumineux. Les équipes bénéficient ainsi d'un historique complet des versions, de la gestion des branches, des demandes de fusion et d'une revue collaborative des poids et configurations des modèles, et pas seulement du code d'entraînement. Cette approche applique les principes du génie logiciel à la gestion des ressources d'apprentissage automatique, permettant aux équipes de suivre leurs expériences, de revenir à des points de contrôle antérieurs et d'intégrer les contributions de la communauté via les demandes de fusion.

La bibliothèque Accelerate permet aux équipes d'exécuter des entraînements distribués sur plusieurs GPU et TPU avec un minimum de modifications de code. GPU unique standard Le script d'entraînement peut être adapté à l'entraînement distribué multi-nœuds en seulement cinq lignes de code. Ceci est essentiel pour les équipes travaillant avec des modèles de langage complexes ou des pipelines de vision par ordinateur à haut volume, où l'entraînement sur un seul appareil n'est pas envisageable en production.

La plateforme prend en charge nativement PyTorch, TensorFlow, JAX, Scikit-learn et ONNX, grâce à une détection automatique des bibliothèques permettant d'exécuter le même modèle dans différents environnements sans modification. La bibliothèque Optimum optimise le modèle en production, notamment par la conversion et la quantification ONNX, ce qui peut réduire la latence d'inférence jusqu'à 40 %. Pour les équipes déployant leurs applications sur des infrastructures hétérogènes, cette portabilité multiplateforme est essentielle.

Plans tarifaires câlins

| Nom du régime | Prix | Principales limites et fonctionnalités |

|---|---|---|

| Communauté | Gratuit | Hébergement public illimité, 100 Go de stockage, API d'inférence, déploiement Spaces, 10 000 appels API par jour |

| Compte PRO | $ 9/mois | Stockage amélioré, plus de 50 $ de crédits d'inférence dédiés, dépôts privés, hébergement prioritaire Spaces |

| Équipe | 20 $ / utilisateur / mois | Toutes les fonctionnalités PRO, plus l'authentification unique (SSO), le contrôle d'accès basé sur les rôles, les analyses d'utilisation et les dépôts privés collaboratifs. |

| Entreprise | À partir de 50 $/utilisateur/mois | Conformité SOC2/HIPAA, assistance dédiée, garanties de niveau de service (SLA), contrôles d'accès avancés, stockage personnalisé |

Avantages et inconvénients

- Plus de 500 000 modèles pré-entraînés disponibles.

- AutoTrain ne nécessite aucune connaissance en programmation.

- Prend en charge nativement toutes les principales bibliothèques d'apprentissage automatique.

- Système de contrôle de version basé sur Git pour les ressources du modèle.

- Déploiement de Spaces prêt pour la production inclus.

- Documentation et tutoriels de niveau international.

- Courbe d'apprentissage abrupte pour les débutants en ML.

- Des limites de débit s'appliquent à l'API gratuite.

- Retards de couverture du modèle d'apprentissage par renforcement.

Est-ce que Hugging Face vaut le coup par rapport à la construction de sa propre pile de comptes ?

Les équipes qui envisagent de créer leur propre registre de modèles, pipeline d'inférence et infrastructure de déploiement devraient prendre en compte le coût réel avant de renoncer à Hugging Face. La mise en place de fonctionnalités équivalentes avec un hébergement Git LFS privé, des points de terminaison d'inférence conteneurisés, un contrôle d'accès et une documentation des modèles nécessite généralement 40 heures de développement ou plus par mois pour la maintenance.

Avec un prix de 9 à 20 $ par utilisateur et par mois, Hugging Face offre un retour sur investissement immédiat par rapport à toute alternative auto-hébergée. Le seul cas où une architecture personnalisée s'avère plus avantageuse est celui où les exigences d'infrastructure hautement propriétaires ne peuvent être satisfaites par aucune plateforme gérée.

Meilleures alternatives à Hugging Face

| Plateforme de collaboration IA/ML open source | Modèle d'accès open source | Portabilité du déploiement |

|---|---|---|

| AWS Sage Maker | Limité aux modèles hébergés et sélectionnés par AWS | Intégration AWS poussée, mais introduit une dépendance vis-à-vis du fournisseur. |

| Poids et biais | Axé sur le suivi des expériences, sans bibliothèque de modèles publique | Outils MLOps performants, mais sans couche d'hébergement intégrée. |

| IA de sommets de Google | Jardin modèle sélectionné par Google avec une variété open source restreinte | Intégration étroite exclusivement GCP avec une flexibilité d'exportation limitée |