Vous écrivez un script. Il fonctionne parfaitement sur un site de test. Puis vous le testez sur un grand site de vente au détail ou une plateforme sociale. Soudain, votre terminal est inondé d'erreurs 403 (Accès interdit) ou de boucles CAPTCHA infinies.

L'ère du simple traitement HTML est révolue.

Le web scraping moderne ne se limite plus à l'envoi d'une simple requête GET. Les sites web actuels sont des applications complexes protégées par des systèmes de sécurité performants. Si vous souhaitez contourner les blocs de web scrapingVous devez comprendre comment les navigateurs communiquent avec les serveurs.

Les principales plateformes comme Cloudflare, Akamai et Datadome font office de filtres. Elles analysent chaque connexion entrante et vérifient si vous êtes un humain ou un script. Pour les contourner, il vous faut des outils qui imitent parfaitement le comportement humain.

Nous allons vous montrer comment extraire des données de sites web dynamiques et pourquoi déléguer ces tâches à Decodo est la solution la plus judicieuse pour votre pipeline de données.

La nécessité du « headless » : pourquoi les requêtes simples échouent

Auparavant, les sites web envoyaient des pages HTML complètes depuis le serveur. Votre script téléchargeait le texte et vous en extrayiez les données.

Aujourd'hui, plus de 70 % des modernes sites de commerce électronique Ce système utilise le rendu côté client (CSR). Lorsqu'une URL est demandée, le serveur envoie une structure HTML vide. Le contenu proprement dit (prix, inventaire, descriptions) est chargé ultérieurement via JavaScript.

Si vous utilisez une bibliothèque HTTP standard, vous obtenez une réponse vide. Vous ne recevez aucune donnée.

Pour voir le contenu, vous avez besoin de rendu JavaScript pour le scrapingCela signifie généralement exécuter un navigateur comme Chrome ou Firefox en arrière-plan, sans interface graphique. On parle alors d'interface sans interface graphique (headless). extraction de données du navigateur.

L'exécution de navigateurs sans interface graphique est gourmande en ressources. Elle consomme beaucoup de RAM et de CPU. Elle introduit également un nouveau problème : la détection.

Décryptage des systèmes anti-bots

Les systèmes de sécurité ne se contentent pas d'examiner votre Votre adresse IPIls analysent le comportement de votre « navigateur ».

L'utilisation d'une bibliothèque d'automatisation standard laisse des traces. Elle peut, par exemple, définir une variable comme `navigator.webdriver = true`. C'est un signe révélateur : les systèmes anti-bots détectent cette information et vous bloquent immédiatement.

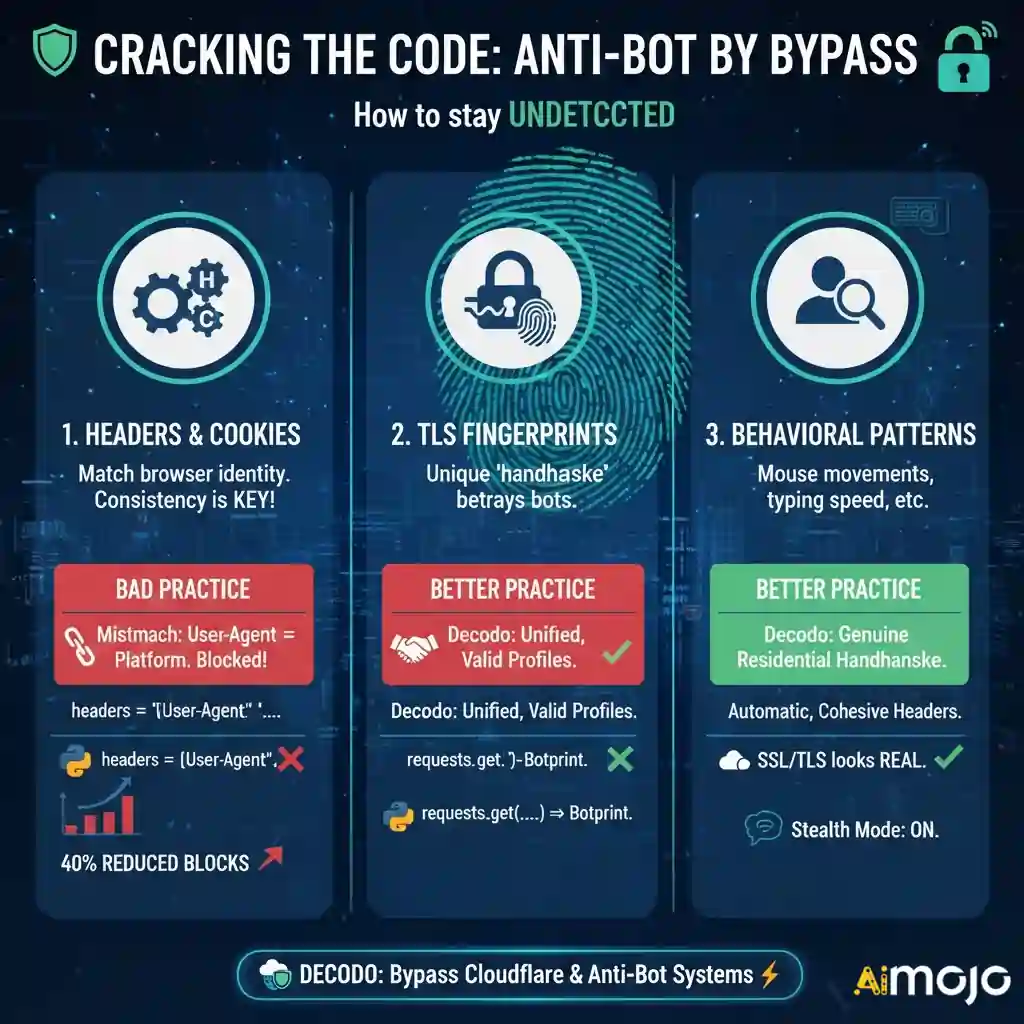

À contourner le scraping de Cloudflare En matière de protection, vous devez gérer trois couches critiques :

1. Pourquoi la correspondance des en-têtes est importante en web scraping

Les en-têtes de vos requêtes indiquent au serveur qui vous êtes. Le plus connu est l'en-tête User-Agent. Cependant, modifier simplement la chaîne User-Agent ne suffit pas.

Les en-têtes doivent former un ensemble cohérent. Si vous envoyez un User-Agent indiquant que vous utilisez Chrome sous Windows, mais que vos en-têtes de plateforme correspondent à Linux, votre requête sera bloquée. Cette incohérence est l'une des principales causes d'échec du scraping.

Une gestion correcte des en-têtes de requêtes peut réduire les taux de blocage jusqu'à 40 % avant même de changer de proxy.

# Ceci est souvent bloqué immédiatement

demandes d'importation

en-têtes = {'User-Agent': 'Mozilla/5.0'}

réponse = requêtes.get('https://example.com', en-têtes=en-têtes)

Decodo construit automatiquement des structures valides et cohérentes. profils d'en-têteCela permet de s'assurer que vos en-têtes Accept-Language, Referer et Platform correspondent à la version du navigateur que vous imitez.

2. Le piège caché : l’empreinte digitale TLS

C'est là que la plupart des scrapers personnalisés échouent.

Lorsqu'un script initie une connexion HTTPS sécurisée, il effectue une « négociation » avec le serveur. L'ordre et les paramètres de cette négociation créent une empreinte unique, souvent appelée hachage JA3.

La bibliothèque requests de Python utilise une méthode d'établissement de liaison très différente de celle d'un véritable Navigateur ChromeCloudflare détecte instantanément cette différence. Même si vos en-têtes sont parfaits, votre contournement de l'empreinte TLS Cette stratégie pourrait échouer si la poignée de main vous trahit.

Decodo gère cela en arrière-plan. Il modifie la négociation SSL/TLS de bas niveau pour qu'elle ressemble exactement à celle d'un utilisateur légitime naviguant depuis une connexion résidentielle.

Meilleures tactiques pour extraire en toute sécurité des données d'applications monopages

Applications à page unique (SPA) Ces sites sont réputés pour être difficiles à explorer. Leur chargement de données est asynchrone. Un outil d'extraction peut déclencher le chargement de la page, mais s'il extrait des données trop tôt, il ne récupère rien.

Pour extraire le code HTML des sites web de type spa, il faut attendre que le réseau soit inactif. Cela signifie que le navigateur attend la fin de tous les appels API en arrière-plan avant de récupérer le code HTML.

L'implémentation manuelle avec des outils comme Puppeteer ou Selenium est instable. Les scripts plantent. Les identifiants des éléments changent. Les fuites de mémoire ralentissent le serveur.

Decodo Web Scraping L'API simplifie cela. Vous envoyez une requête, et Decodo lance le navigateur, génère le JavaScript, attend que le réseau soit stabilisé, puis renvoie le code HTML propre.

Créez des flux de travail de scraping évolutifs et indétectables avec Decodo

Créer une grille de scraping sans interface graphique est coûteux. Il faut corriger les pilotes Chrome, faire tourner des milliers d'adresses IP et mettre à jour constamment le code lorsque Cloudflare modifie son algorithme.

Decodo propose un service spécialisé extraction automatisée de données du navigateur infrastructure qui prend en charge les tâches les plus lourdes.

Caractéristiques clés pour l'évasion

La plateforme est conçue pour contourner les blocs de web scraping en privilégiant le mimétisme et la fiabilité :

Guide d'intégration rapide : Utilisation de l'API de scraping de Decodo

Voici à quel point il est simple de passer d'un script local bloqué à Decodo. Vous n'avez pas besoin de gérer le navigateur vous-même.

import requests

# Decodo API Endpoint

url = "https://api.decodo.com/v1/scrape"

payload = {

"url": "https://difficult-site.com/products",

"render_js": True, # Activates Headless Browser

"wait_for_selector": ".product-price", # Waits for dynamic content

"country": "US" # Uses premium US residential proxies

}

headers = {

"Authorization": "Bearer YOUR_DECODO_API_KEY",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

if response.status_code == 200:

print("Scraping Successful!")

print(response.json()['content'])

else:

print("Error:", response.text)Remarquez la simplicité. Vous n'importez pas Selenium. Vous ne téléchargez pas Chromedriver. Vous dites simplement à Decodo : « J'ai besoin de cette URL, veuillez la convertir en URL. » JavaScript. »

Choisir entre l'API Puppeteer, Selenium ou Decodo

De nombreux développeurs débutent avec des outils open source. Il est utile de comprendre les avantages et les inconvénients respectifs de Puppeteer, Selenium et des API.

Sélénium: Idéal pour les tests, mais lent et facilement détectable. Il nécessite d'importantes modifications pour être évité. détection anti-bot déclencheurs d'évasion.

Marionnettiste/Dramaturge : Plus rapide et plus performant pour le rendu JavaScript lors du web scraping. Cependant, la maintenance d'un parc de ces instances exige une expertise DevOps pointue. Il reste à résoudre manuellement les problèmes de proxy et d'identification.

API Decodo : La solution la plus efficace. Elle offre la puissance d'un navigateur sans interface graphique, sans les contraintes de maintenance. Elle gère nativement le contournement de l'empreinte TLS et les en-têtes.

Grâce à l'API Decodo, les équipes gagnent du temps de développement, réduisent leurs coûts d'infrastructure et obtiennent des taux de réussite de scraping plus élevés sur des sites web modernes et complexes.

Grattez plus intelligemment, pas plus durement : laissez Decodo s’en charger.

Le web devient de plus en plus fermé. La lutte contre les systèmes anti-bots est devenue une véritable course à l'armement. Si vous consacrez votre temps d'ingénierie à combattre Cloudflare, vous ne pouvez pas analyser vos données.

Vous n'avez pas besoin de construire une infrastructure complexe pour extraire des données de sites web dynamiquesEn utilisant Decodo, vous bénéficiez d'un accès à l'extraction de données sans interface graphique de niveau entreprise, à une gestion de session appropriée et à une rotation avancée des empreintes digitales.

Ne soyez plus bloqué. Laissez Decodo gérer les complexités du navigateur pendant que vous vous concentrez sur les informations.

AiMojo recommande :

BONUS: Obtenez notre 200 $ «AI « Boîte à outils de maîtrise » GRATUITE lors de votre inscription !

BONUS: Obtenez notre 200 $ «AI « Boîte à outils de maîtrise » GRATUITE lors de votre inscription !

![7 meilleurs gratuits AI Générateurs humains en 2026 [Évalués et classés]](https://aimojo.io/wp-content/uploads/2023/11/Best-Free-AI-Human-Generator-100x100.webp)