Información clave sobre Hugging Face

¿Qué es Hugging Face?

Abrazando la cara es una fuente abierta AI Plataforma de colaboración que actúa como repositorio central para modelos de aprendizaje automático, conjuntos de datos y herramientas de implementación. Proporciona a los científicos de datos, ingenieros de ML y AI Los equipos de producto tienen acceso instantáneo a más de 500,000 modelos preentrenados para la generación de texto, la visión artificial, el reconocimiento de voz y las tareas multimodales.

Construida sobre una infraestructura basada en Git, la plataforma permite a los equipos controlar las versiones de los pesos del modelo, compartir conjuntos de datos de entrenamiento e implementar en vivo. AI Demostraciones a través de Spaces en minutos. Para empresas. edificio AI productosHugging Face elimina la sobrecarga de infraestructura que supone la gestión de registros de modelos privados y proporciona alojamiento listo para la producción, una API de inferencia y flujos de trabajo colaborativos que aceleran todo el ciclo de vida del desarrollo del modelo, desde la investigación hasta su lanzamiento.

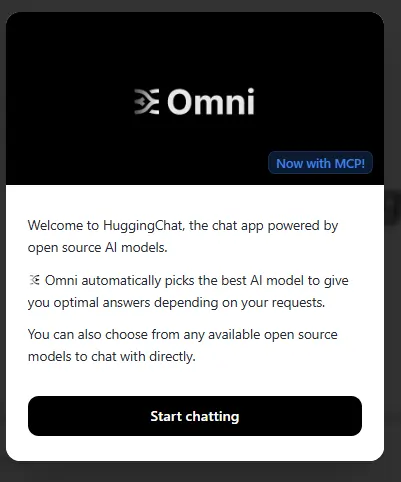

HuggingChat es Hugging Face's propio, libre y de código abierto AI Interfaz de chat que permite acceder a más de 119 modelos de código abierto, como Llama, Mistral y Qwen, a través de una plataforma unificada. Incluye búsqueda web integrada para la conexión en tiempo real, compatibilidad con MCP para llamar a herramientas externas durante la conversación y una función de herramientas comunitarias que permite integrar cualquier espacio público de Hugging Face directamente en el chat.

AutoTrain elimina la necesidad de escribir guiones de entrenamiento complejos Al adaptar un modelo preentrenado a un conjunto de datos personalizado, se cargan los datos etiquetados, se selecciona un modelo base, se configuran los hiperparámetros mediante una interfaz de usuario intuitiva y la plataforma gestiona automáticamente el entrenamiento distribuido. En la práctica, el ajuste fino de un clasificador BERT mediante AutoTrain tardó menos de 15 minutos, frente a las 3 horas o más que requería un ciclo de entrenamiento manual. Para los equipos que no cuentan con ingenieros de infraestructura de aprendizaje automático dedicados, esto supone una mejora significativa en sus capacidades.

Spaces permite a los equipos implementar aplicaciones Gradio o Streamlit directamente desde scripts de Python, con la plataforma gestionando automáticamente la contenerización, los certificados HTTPS y el escalado automático. Un entorno de trabajo análisis de los sentimientos La demostración puede estar lista en menos de una hora. La compatibilidad integrada con OAuth, la gestión de secretos y el almacenamiento persistente simplifican considerablemente la configuración de DevOps. Para demostraciones a clientes, prototipos o herramientas internas de aprendizaje automático, esta es una de las funciones más productivas de la plataforma.

En Hugging Face, cada modelo y conjunto de datos se almacena en un repositorio Git con soporte LFS para archivos binarios de gran tamaño. Esto significa que los equipos tienen acceso al historial completo de versiones, ramificación, solicitudes de extracción y revisión colaborativa de los pesos y configuraciones del modelo, no solo del código de entrenamiento. Esto aporta una disciplina de ingeniería de software adecuada a la gestión de activos de aprendizaje automático, permitiendo a los equipos realizar un seguimiento de los experimentos, revertir puntos de control y aceptar contribuciones de la comunidad mediante solicitudes de extracción.

La biblioteca Accelerate permite a los equipos ejecutar entrenamientos distribuidos en múltiples GPU y TPU con cambios mínimos en el código. GPU única estándar El script de entrenamiento se puede adaptar para el entrenamiento distribuido en múltiples nodos con tan solo cinco líneas de código. Esto es fundamental para los equipos que trabajan con modelos de lenguaje complejos o sistemas de visión artificial de alto volumen, donde el entrenamiento en un solo dispositivo no es viable en producción.

La plataforma es compatible con PyTorch, TensorFlow, JAX, Scikit-learn y ONNX de forma nativa, con detección automática de bibliotecas que ejecuta el mismo modelo en distintos entornos sin modificaciones. La biblioteca Optimum añade optimización de modelos para producción, incluyendo la conversión y cuantización de ONNX, lo que puede reducir la latencia de inferencia hasta en un 40 %. Para los equipos que implementan en infraestructuras diversas, esta portabilidad multiplataforma es fundamental.

Planes de precios de Hugging Face

| Nombre del Plan | Costo | Limitaciones/características clave |

|---|---|---|

| Comunidad | Free | Alojamiento público ilimitado, 100 GB de almacenamiento, API de inferencia, implementación de Spaces, 10 000 llamadas a la API al día. |

| Cuenta PRO | $9/mes | Almacenamiento mejorado, créditos de inferencia dedicados de más de $50, repositorios privados, alojamiento prioritario en Spaces. |

| Equipo | $ 20 / usuario / mes | Todas las funciones PRO más SSO, control de acceso basado en roles, análisis de uso, repositorios privados colaborativos |

| Empresa | Desde $ 50 / usuario / mes | Cumplimiento de SOC2/HIPAA, soporte dedicado, garantías de SLA, controles de acceso avanzados, almacenamiento personalizado |

Pros y contras

- Más de 500,000 modelos preentrenados disponibles.

- AutoTrain no requiere ningún conocimiento de programación.

- Admite de forma nativa todas las principales bibliotecas de aprendizaje automático.

- Control de versiones basado en Git para los recursos del modelo.

- Implementación de Spaces lista para producción incluida.

- Documentación y tutoriales de primer nivel.

- Curva de aprendizaje pronunciada para principiantes en aprendizaje automático.

- Se aplican los límites de velocidad de la API del nivel gratuito.

- Retrasos en la cobertura de los modelos de aprendizaje por refuerzo.

¿Merece la pena usar Hugging Face en lugar de construir tu propia pila tecnológica?

Los equipos que consideren crear su propio registro de modelos, canalización de inferencia e infraestructura de despliegue deben tener en cuenta el coste real antes de descartar Hugging Face. Configurar capacidades equivalentes con alojamiento privado Git LFS, puntos finales de inferencia en contenedores, control de acceso y documentación de modelos suele consumir 40 horas o más de mantenimiento por parte de los desarrolladores al mes.

Con un coste de entre 9 y 20 dólares por usuario al mes, Hugging Face ofrece un retorno de la inversión inmediato frente a cualquier alternativa autogestionada. El único caso en el que una solución personalizada resulta ventajosa es cuando ninguna plataforma gestionada puede satisfacer los requisitos de infraestructura altamente especializados.

Las mejores alternativas a Hugging Face

| Plataforma de colaboración de IA/ML de código abierto | Acceso al modelo de código abierto | Portabilidad de la implementación |

|---|---|---|

| Creador de salvia de AWS | Limitado a modelos alojados y seleccionados por AWS. | Integración profunda con AWS, pero introduce dependencia del proveedor. |

| Pesos y sesgos | Centrado en el seguimiento de experimentos, sin biblioteca de modelos pública. | Potentes herramientas MLOps pero sin capa de alojamiento integrada |

| IA de vértice de Google | Jardín modelo seleccionado por Google con una variedad limitada de código abierto. | Integración estricta exclusiva de GCP con flexibilidad de exportación limitada. |