Η τεχνητή νοημοσύνη αλλάζει τα πάντα, από τις τράπεζες μέχρι την υγειονομική περίθαλψη, αλλά όταν... AI αν κάνει λάθος στην κυβερνοασφάλεια, οι κίνδυνοι μπορεί να είναι καταστροφικοί.

AI Τα λάθη στην ασφάλεια δεν διαστρεβλώνουν απλώς την ανάλυση — δημιουργούν τυφλά σημεία, υπονομεύουν την εμπιστοσύνη και μπορούν να αφήσουν τους οργανισμούς επικίνδυνα εκτεθειμένους σε απειλές.

Σε αυτόν τον οδηγό, θα αναλύσουμε το πρόβλημα, θα επισημάνουμε παραδείγματα από τον πραγματικό κόσμο, θα μοιραστούμε συμβουλές ειδικών και θα σας εξοπλίσουμε με τις βέλτιστες πρακτικές για την ανίχνευση και τη διόρθωση. AI ελαττώματα—επειδή σε αυτήν την εποχή που βασίζεται στην Τεχνητή Νοημοσύνη, ηλεκτρονική ανθεκτικότητα εξαρτάται από την απόκτηση AI σωστά.

Γιατί AI Λάθη ύλη Περισσότερο από ποτέ

Σήμερα, οι επιχειρήσεις και οι ομάδες ασφαλείας εξαρτώνται από AI για:

Αλλά εδώ είναι το kicker: κακώς εκπαιδευμένοι ή μεροληπτικοί αλγόριθμοι μπορούν να χρησιμοποιηθούν ως όπλα από τους εισβολείς, καθιστώντας τελικά το αμυντικά συστήματα μέρος του προβλήματος. AI δεν κάνει απλώς «ειλικρινά λάθη«—μπορεί να ενισχύσει τα κενά, να χάσει νέες τεχνικές κυβερνοεπιθέσεων και, στις χειρότερες περιπτώσεις, να μετατρέψει μικρές παραλείψεις σε μαζικές παραβιάσεις».

Κλειδί Στατιστικά & Επισκοπήσεις Κλάδου

ΚΛΑΣΣΙΚΑ Περιπτώσεις: Πότε AI Κάνει λάθος

Μελέτη περίπτωσης 1: Ανίχνευση απειλών Phantom

Το σύστημα ασφαλείας με τεχνητή νοημοσύνη ενός μεγάλου λιανοπωλητή σημείωσε τη νόμιμη συμπεριφορά των χρηστών ως επίθεση από εσωτερικούς παράγοντες, προκαλώντας εκτεταμένα κλεισίματα λογαριασμών και αναστάτωση στην επιχείρηση. Οι μηχανικοί ανακάλυψαν ότι AI «υπερβολική προσαρμογή» σε ξεπερασμένα μοτίβα επίθεσης και απέτυχε να προσαρμοστεί σε νέες ροές εργασίας.

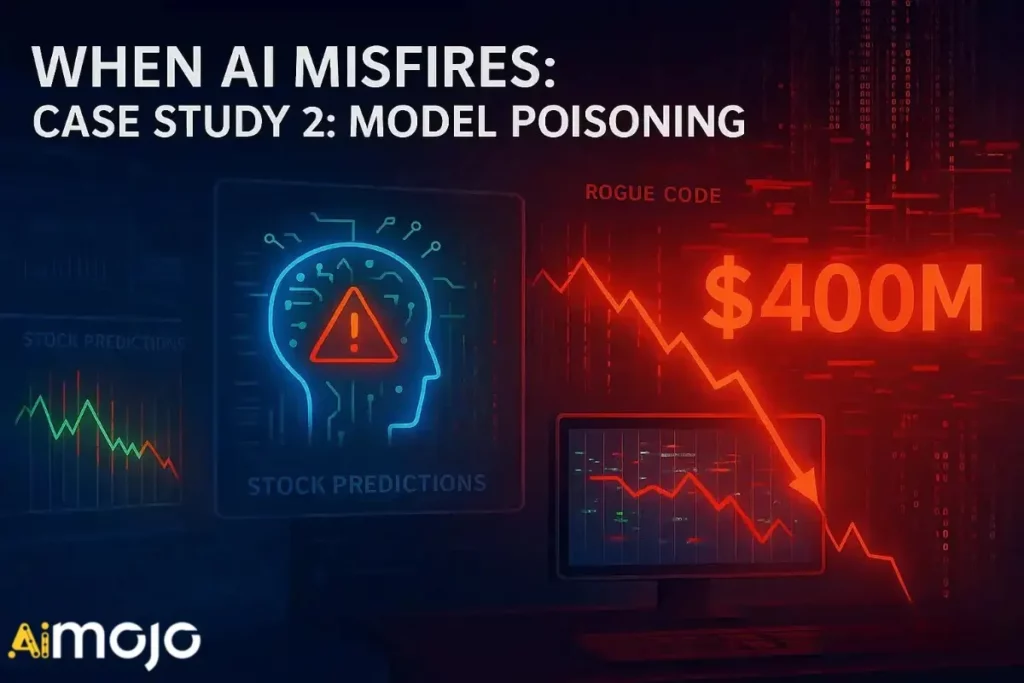

Μελέτη περίπτωσης 2: Δηλητηρίαση μοντέλου με ενεργοποίηση τεχνητής νοημοσύνης

Σε μια εμπορική εταιρεία, παραποιημένο AI αλγόριθμοι λανθασμένη ταξινόμηση δικαιωμάτων προαίρεσης μετοχών λόγω επίθεσης λανθασμένης ταξινόμησης, η οποία οδήγησε σε σφάλμα αξίας 400 εκατομμυρίων δολαρίων. Η έλλειψη παρακολούθησης της παραγωγής και η ανεξέλεγκτη μετατόπιση του μοντέλου ήταν οι ένοχοι.

Μελέτη Περίπτωσης 3: Παρακάμπτεται από τους Εχθρούς

Darktrace και οι ομάδες της Google έδειξαν ότι οι εισβολείς μπορούν να χρησιμοποιήσουν τεχνικές όπως η δηλητηρίαση δεδομένων, οι αντιπαραθετικές προτροπές και η εκμετάλλευση AI «τυφλά σημεία» προς κρυφό κακόβουλο λογισμικό ξεπερνώντας ακόμη και τις κορυφαίες άμυνες που βασίζονται στην Τεχνητή Νοημοσύνη.

Γιατί AI Κάντε το λάθος στο Κυβερνασφάλεια?

Οφέλη από την απόκτηση Τεχνητής Νοημοσύνης Δεξί στην Ασφάλεια

Οδηγός βήμα προς βήμα: Πώς να Περιορίζω AI Αποτυχία στην ασφάλεια

Βήμα 1. Ξεκινήστε με ποιοτικά δεδομένα

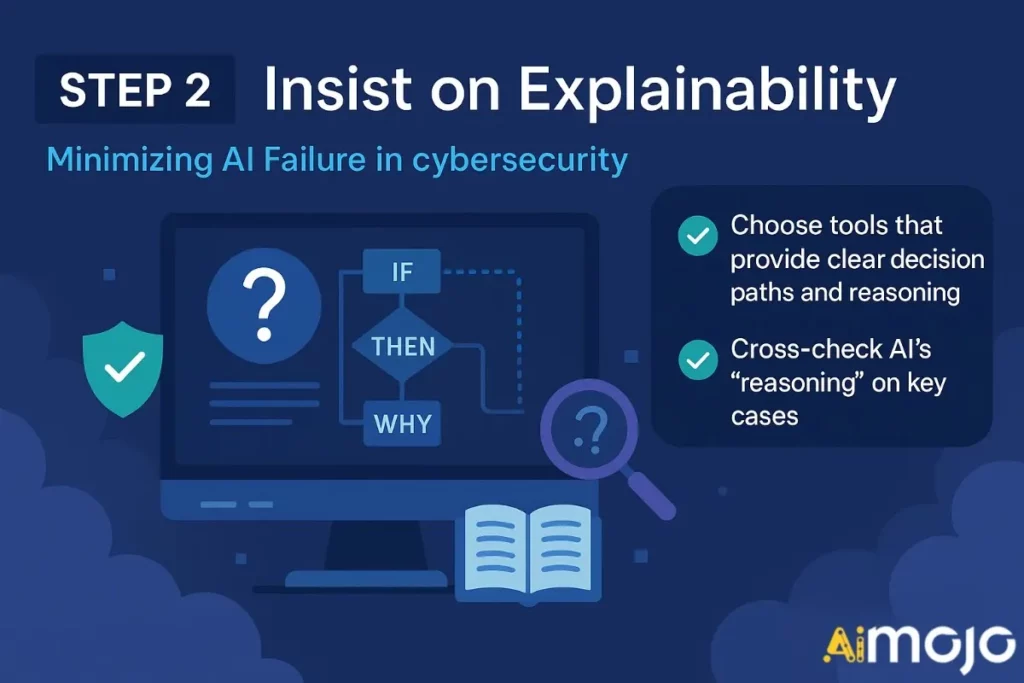

Βήμα 2. Επιμείνετε στην εξηγησιμότητα

Βήμα 3. Τακτική Ανθρώπινη Εποπτεία

Διατηρήστε «κόκκινες ομάδες» και αναλυτές ασφαλείας για έλεγχο AI αποφάσεις, ειδικά σε ειδοποιήσεις που έχουν επισημανθεί ή αγνοηθεί

Βήμα 4. Παρακολούθηση για διαρροή και δηλητηρίαση

Εφαρμόστε εργαλεία που παρακολουθούν AI απόδοση μοντέλου και ανίχνευση χειραγώγησης προσπάθειες

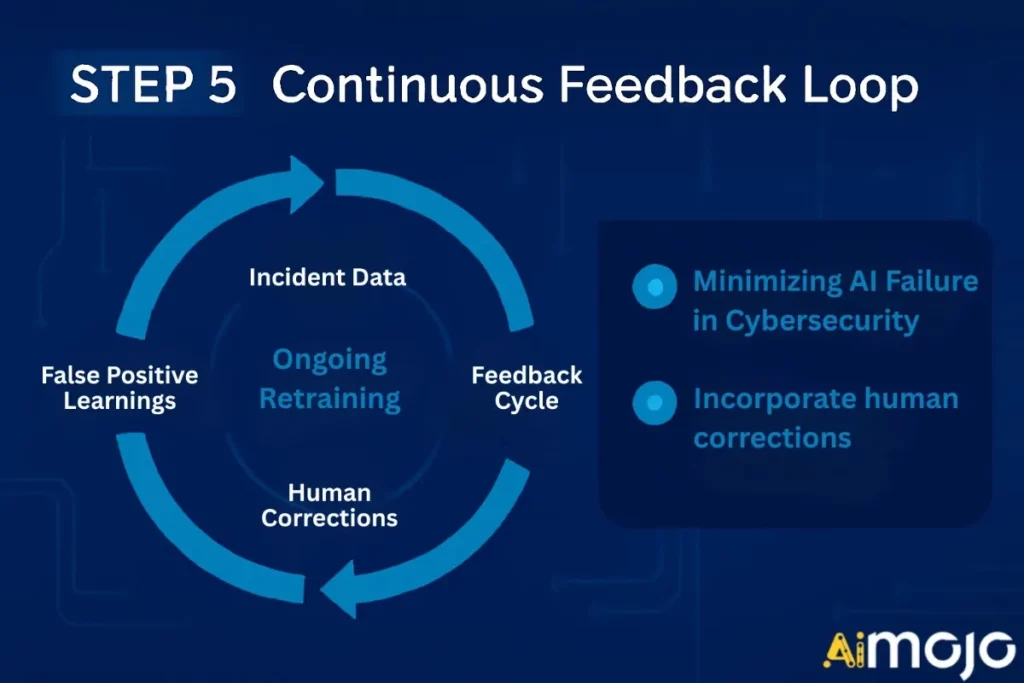

Βήμα 5. Συνεχής βρόχος ανάδρασης

Χρησιμοποιείτε ανθρώπινες διορθώσεις, δεδομένα περιστατικών και ψευδώς/θετικές γνώσεις σε συνεχιζόμενη επανεκπαίδευση

Βήμα 6. Επανατοποθετήστε την άμυνά σας σε επίπεδα

Mix AI γνώσεις με παραδοσιακά εργαλεία και αξιολόγηση από ειδικούς—ποτέ μην βασίζεστε αποκλειστικά σε αυτοματοποίηση

Κορυφαία Εργαλεία & Πόροι για AI Λάθος Ανίχνευση στην Κυβερνοασφάλεια

| Εργαλείο/Πόρων | Κύρια λειτουργία | Μοναδική Δύναμη |

|---|---|---|

| Darktrace | Ανίχνευση απειλών | Αυτόνομη αυτο-μάθηση, βαθιά μάθηση |

| IBM Watson για την Κυβερνοασφάλεια | Ανάλυση απειλών και πληροφορίες | Προηγμένη NLP, σύνθεση δεδομένων μεγάλης κλίμακας |

| CrowdStrike Falcon | Ασφάλεια τελικού σημείου | Πρόληψη κακόβουλου λογισμικού σε πραγματικό χρόνο |

| Copilot Security Microsoft | Αυτοματοποίηση ασφαλείας & έρευνα | Πληροφορίες που βασίζονται στο περιβάλλον και υποστηρίζονται από την Τεχνητή Νοημοσύνη |

| PentestGPT | Αυτοματοποιημένοι έλεγχοι διείσδυσης | Με γνώμονα την τεχνητή νοημοσύνη συστάσεις, αναφορές |

💡 Επαγγελματίας Συμβουλές για να διατηρήσετε το δικό σας AI Άμυνα Sharp

Συχνές ερωτήσεις

Μπορεί AI μπορούν να αποφευχθούν πλήρως τα σφάλματα στην κυβερνοασφάλεια;

Όχι εντελώς—AI θα κάνουν λάθη, αλλά η τακτική εποπτεία, η ποικιλία των εισερχόμενων δεδομένων και η αυστηρή παρακολούθηση μπορούν να μειώσουν δραστικά τον κίνδυνο.

Πρέπει να βασιστούμε αποκλειστικά σε AI για την ασφάλειά μας;

Όχι. AI είναι ένας ισχυρός σύμμαχος, αλλά λειτουργεί καλύτερα σε συνδυασμό με την ανθρώπινη εμπειρογνωμοσύνη και τους παραδοσιακούς ελέγχους ασφαλείας.

Πόσο γρήγορα υιοθετούν οι επιτιθέμενοι την Τεχνητή Νοημοσύνη;

Πολύ γρήγορα. Από το δημιουργικό κακόβουλο λογισμικό μέχρι τα deepfakes, οι κυβερνοεγκληματίες ξεπερνούν τους υπερασπιστές, καθιστώντας AI η επαγρύπνηση είναι απαραίτητη.

Συμπέρασμα

Κατά τη AI αν κάνει λάθος, οι συνέπειες διαπερνούν ολόκληρο τον οργανισμό σας—από χαμένες παραβιάσεις έως την απώλεια της εμπιστοσύνης των πελατών. Η άρτια εκπαιδευμένη, εξηγήσιμη Τεχνητή Νοημοσύνη, σε συνδυασμό πάντα με την ανθρώπινη εποπτεία, είναι ο πραγματικός παράγοντας που αλλάζει τα δεδομένα. κυβερνασφάλεια.

Θέλετε να θωρακίσετε την επιχείρησή σας;

Ξεκινήστε αξιολογώντας την ασφάλειά σας AI σήμερα. Ελέγξτε για τυφλά σημεία, πιέστε για εξηγησιμότητα και μην αφήσετε τον αυτοματισμό να σας οδηγήσει σε εφησυχασμό. Αν είστε έτοιμοι να αναλάβετε τον έλεγχο, δράστε τώρα—γιατί η απόκτηση AI Το σωστό δεν είναι απλώς έξυπνο, είναι και απαραίτητο.

Ενισχύστε την ανθεκτικότητά σας στον κυβερνοχώρο αναβαθμίζοντας τις δεξιότητες της ομάδας σας, απαιτώντας διαφάνεια AI λύσειςκαι συμμετέχοντας στη συζήτηση. Το μέλλον ανήκει σε όσους εμπιστεύονται—αλλά και επαληθεύουν—την Τεχνητή Νοημοσύνη τους.

BONUS: Πάρτε τα 200 δολάρια μας "AI «Εργαλειοθήκη Mastery» ΔΩΡΕΑΝ όταν εγγραφείτε!

BONUS: Πάρτε τα 200 δολάρια μας "AI «Εργαλειοθήκη Mastery» ΔΩΡΕΑΝ όταν εγγραφείτε!