Die Fusion von Meta's Llama 4-Modelle mit Microsoft's Das AutoGen-Framework eröffnet neue Möglichkeiten für die Erstellung intelligenter, effizienter AI Agenten. In Kombination ermöglichen diese Technologien Entwicklern die Erstellung von Anwendungen, die natürliche Sprache verarbeiten, Bilder verstehen, komplexe Probleme lösen und mit anderen Agenten zusammenarbeiten können, um Aufgaben zu erledigen.

Lama 4 bietet beeindruckende multimodale Funktionen und umfangreiche Kontextfenster, während AutoGen bietet einen strukturierten Rahmen für die Orchestrierung mehrerer Agenten in kollaborativen Workflows. Zusammen bilden sie ein leistungsstarkes Toolkit für die nächste Generation AI um weitere Anwendungsbeispiele zu finden.

Dieser Leitfaden führt Sie durch den Prozess der Gebäude AI Agenten, die diese Tools verwenden, mit praktischen Codebeispielen und Implementierungsstrategien für Entwickler aller Fähigkeitsstufen.

Was macht Lama 4 , AutoGen das perfekte Match?

Meta's Die Llama 4-Familie zeichnet sich durch AI Welt mit ihren native multimodale Funktionen und frühen Fusionsansatz. In Kombination mit AutoGen—Microsoft's Framework zum Aufbau von Konversations-Multiagentensystemen—Entwickler können erstellen AI Agenten, die effizient denken, zusammenarbeiten und sich anpassen.

Llama 4 Modelle, einschließlich Scout und Maverick Varianten, bieten Frühe Fusions-Multimodalverarbeitung das Text, Bilder und Videoframes von Anfang an als eine einzige Token-Sequenz behandelt. Diese Funktion, gepaart mit AutoGen's flexible Agentenarchitektur, ermöglicht die Erstellung von AI Systeme das kann:

Lassen's Erstellen Sie ein praktisches Multiagentensystem, das diese Fähigkeiten demonstriert, indem Sie einen Projektvorschlagsgenerator erstellen, der die Kundenanforderungen analysiert und benutzerdefinierte Jobvorschläge generiert.

Aufbau einer praktischen AI Agentensystem

Lassen's Erstellen Sie ein Multi-Agenten-System, das Freelancern hilft, maßgeschneiderte Jobangebote zu erstellen. Unser System wird:

- Erfassen der Kundenanforderungen

- Sammeln Sie Qualifikationen für Freiberufler

- Erstellen Sie professionelle Angebote mit angemessener Preisgestaltung.

Schritt 0: Einrichten Ihrer Umgebung

Installieren Sie zunächst die erforderlichen Pakete:

python

pip install autogen-agentchat~=0.2

pip install ipython

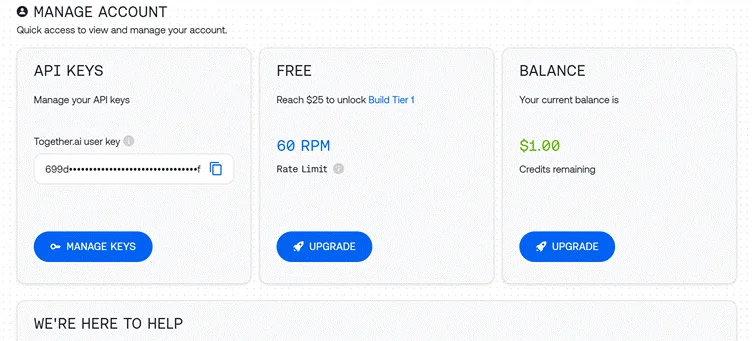

Schritt 1: API-Zugriff konfigurieren

Wir verwenden die Together-API, um auf Llama 4 zuzugreifen:

python

import os

import autogen

from IPython.display import display, Markdown

# Load API key from file

with open("together_ai_api.txt") as file:

LLAMA_API_KEY = file.read().strip()

os.environ["LLAMA_API_KEY"] = LLAMA_API_KEY

# Configure LLM settings

llm_config = {

"config_list": [

{

"model": "meta-llama/Llama-4-Scout", # Use Scout for efficiency

"api_key": os.environ.get("LLAMA_API_KEY"),

"base_url": "https://api.together.xyz/v1",

}

],

"temperature": 0.2, # Lower for more consistent outputs

"timeout": 180

}Schritt 2: Erstellen spezialisierter Agenten

Unser System erfordert drei verschiedene Agenten mit spezifischen Rollen:

Client-Eingabeagent

python

# Agent 1: Interfaces with the human user

client_agent = autogen.UserProxyAgent(

name="Client_Input_Agent",

human_input_mode="ALWAYS", # Always gets input from human

max_consecutive_auto_reply=1,

is_termination_msg=lambda x: x.get("content", "").rstrip().endswith("TERMINATE"),

system_message="""Act as the primary contact between the human user and other agents.

First, collect initial project details (requirements, timeline, budget).

When asked questions by the Scope Architect, relay user's answers about skills and experience.

Type TERMINATE when the proposal is satisfactory or the user wants to stop."""

)Dieser Agent dient als Brücke zwischen dem menschlichen Benutzer und dem AI System, Sammeln von Informationen und Präsentation des Endergebnisses.

Umfang Architekt Agent

python

# Agent 2: Analyzes requirements and asks qualifying questions

scope_architect_agent = autogen.AssistantAgent(

name="Scope_Architect",

llm_config=llm_config,

max_consecutive_auto_reply=1,

system_message="""You are a Scope Architect who analyzes project requirements.

After receiving initial details from Client_Input_Agent, ask targeted questions about:

- The freelancer's relevant past projects and experience

- Their key skills and tools for this specific project

- Estimated completion time for the described work

Once you have sufficient information, create a concise summary of BOTH

the project requirements AND freelancer qualifications for the Rate Recommender."""

)Der Scope Architect fungiert als Anforderungsanalyst und sammelt wichtige Informationen, die für einen präzisen Vorschlag erforderlich sind.

Empfehlungsagenten bewerten

python

# Agent 3: Creates structured proposal with pricing

rate_recommender_agent = autogen.AssistantAgent(

name="Rate_Recommender",

llm_config=llm_config,

max_consecutive_auto_reply=1,

system_message="""Generate professional project proposals based on gathered information.

Wait for the Scope Architect's complete summary before proceeding.

Include these sections in your proposal:

1. Custom Introduction: Personalized greeting referencing client and project

2. Project Scope & Timeline: Clear deliverables with timeline estimates

3. Pricing Options: 2-3 tiers (hourly/fixed/retainer) with justification

4. Next Steps: Brief suggestion for kickoff discussion

Format using proper markdown. Avoid commentary - deliver only the final proposal."""

)Dieser Agent erstellt das endgültige Lieferergebnis und wandelt die gesammelten Informationen in einen strukturierten Vorschlag um.

Schritt 3: Erstellen eines Hilfsagenten (optional)

python

# Optional helper to initiate the conversation

user_proxy = autogen.UserProxyAgent(

name="user_proxy",

max_consecutive_auto_reply=1,

llm_config=llm_config,

system_message="Initiate the conversation between agents."

)Schritt 4: Einrichten des Gruppenchats

Jetzt erstellen wir die Konversationsumgebung, in der Agenten zusammenarbeiten können:

python

# Group Chat Configuration

groupchat = autogen.GroupChat(

agents=[client_agent, scope_architect_agent, rate_recommender_agent],

messages=[],

max_round=4, # Prevent infinite loops

speaker_selection_method="round_robin", # Orderly participation

)

# Conversation Manager

manager = autogen.GroupChatManager(

groupchat=groupchat,

llm_config=llm_config,

system_message="""Direct the conversation flow through these steps:

1. Client_Input_Agent shares project details

2. Scope_Architect asks qualifying questions

3. Client_Input_Agent provides freelancer information

4. Scope_Architect summarizes all information

5. Rate_Recommender creates the final proposal

End when the proposal is complete or Client_Input_Agent says TERMINATE."""

)Dieses Setup gewährleistet eine organisierte Konversation Ablauf mit klaren Rollen und Verantwortlichkeiten.

Schritt 5: Das Gespräch beginnen

Lassen's Starten Sie unseren Agenten-Workflow:

python

# Begin the proposal generation process

print("Starting the proposal generation process...")

print("Please provide project details when prompted.")

initial_message = """

Begin the proposal creation process:

1. First collect project details from the user

2. Then gather freelancer qualifications

3. Finally generate a professional proposal

"""

user_proxy.initiate_chat(

manager,

message=initial_message

)Schritt 6: Extrahieren des endgültigen Vorschlags

Sobald das Gespräch abgeschlossen ist, extrahieren und zeigen wir den endgültigen Vorschlag an:

python

# Find and display the proposal

chat_history = manager.chat_messages[client_agent]

final_proposal = None

for msg in reversed(chat_history):

if msg.get("role") == "assistant" and msg.get("name") == rate_recommender_agent.name:

if "Introduction" in msg.get("content", ""):

final_proposal = msg

break

if final_proposal:

proposal_text = final_proposal.get("content", "Proposal not found.")

try:

display(Markdown(proposal_text))

except NameError:

print("\n--- FINAL PROPOSAL ---\n")

print(proposal_text)

else:

print("Could not find the final proposal in the conversation.")Verbesserte Techniken für besseres Bauen AI Makler

Während unsere grundlegende Implementierung gut funktioniert, sind hier einige fortgeschrittene Ansätze, um Ihre AI Agenten stärker:

A.Integration externer Tools

Einer von AutoGen's Stärken sind die Möglichkeit, Agenten mit externen Tools auszustatten. Hier's So geben Sie Ihrem Empfehlungsgeber eine Bewertung Marktforschung Fähigkeiten:

python

# Define function for market research

def research_market_rates(job_type, experience_level):

"""Access external data for pricing information"""

# This would typically connect to an API or database

# Using simple dictionary for demonstration

rate_data = {

"web_development": {

"beginner": "$30-50/hr",

"intermediate": "$50-90/hr",

"expert": "$90-200/hr"

},

"data_analysis": {

"beginner": "$25-45/hr",

"intermediate": "$45-85/hr",

"expert": "$85-180/hr"

}

}

# Retrieve appropriate rate range

try:

return rate_data[job_type][experience_level]

except KeyError:

return "Rate information not available for this combination"

# Configure LLM with function

rate_recommender_config = {

**llm_config,

"functions": [

{

"name": "research_market_rates",

"description": "Find current market rates for specific job types and experience levels",

"parameters": {

"type": "object",

"properties": {

"job_type": {

"type": "string",

"enum": ["web_development", "data_analysis", "content_writing", "graphic_design"]

},

"experience_level": {

"type": "string",

"enum": ["beginner", "intermediate", "expert"]

}

},

"required": ["job_type", "experience_level"]

}

}

]

}

# Update the Rate Recommender with function capabilities

rate_recommender_agent = autogen.AssistantAgent(

name="Rate_Recommender",

llm_config=rate_recommender_config,

system_message="""Generate proposals with accurate market-based pricing.

Use the research_market_rates function to get current pricing information."""

)

# Register the function with the agent

rate_recommender_agent.register_function(

function_map={"research_market_rates": research_market_rates}

)Diese Verbesserung ermöglicht dem Rate Recommender den Zugriff auf externe Preisdaten, wodurch die Angebote präziser und wettbewerbsfähiger werden.

B. Implementierung des persistenten Speichers

Durch das Hinzufügen von Speicherfunktionen können Agenten den Kontext über mehrere Interaktionen hinweg beibehalten:

python

# Create a simple memory system for agents

class AgentMemory:

def __init__(self):

self.memories = {}

def store(self, agent_name, key, value):

"""Save information to agent memory"""

if agent_name not in self.memories:

self.memories[agent_name] = {}

self.memories[agent_name][key] = value

def retrieve(self, agent_name, key=None):

"""Get information from agent memory"""

if agent_name not in self.memories:

return None

if key:

return self.memories[agent_name].get(key)

else:

return self.memories[agent_name]

# Initialize memory

memory = AgentMemory()

# Example of storing client information

def process_client_input(message):

"""Extract and store client information"""

# This would typically use more sophisticated parsing

if "budget:" in message.lower():

budget = message.split("budget:")[1].strip().split("\n")[0]

memory.store("client", "budget", budget)

if "timeline:" in message.lower():

timeline = message.split("timeline:")[1].strip().split("\n")[0]

memory.store("client", "timeline", timeline)

return message

# Add memory hook to client agent

def memory_hook(recipient, messages, sender, config):

"""Process and store incoming messages"""

if sender.name == "Client_Input_Agent" and messages:

process_client_input(messages[0].get("content", ""))

return False, None # Continue normal processing

# Register the hook

client_agent.register_hook("memory_hook", memory_hook)Dieses Gedächtnissystem hilft den Agenten, sich während des Gesprächs an wichtige Informationen zu erinnern, auch wenn diese in den letzten Nachrichten nicht ausdrücklich erwähnt wurden.

Praktische Anwendungen über die Angebotserstellung hinaus

Die von uns erstellte Architektur kann an viele andere Geschäftsszenarien angepasst werden:

A. Pipeline zur Inhaltserstellung

Passen Sie unsere Agenten an, um Workflows zur Inhaltsproduktion zu handhaben:

B. SEO-Analysesystem

Erstellen Sie mit diesen Agenten ein spezielles SEO-Tool:

C. Automatisierung des Kundensupports

Verwandeln Sie die Architektur in ein Supportsystem:

Tipps zur Leistungsoptimierung

Für produktionsreife AI Agentensysteme:

- Intelligente Modellauswahl: Verwenden Sie leichte Modelle für einfachere Aufgaben (Aufnahme, Routing) und reservieren Sie größere Modelle für komplexe Überlegungen (Angebotserstellung, Preisgestaltung).

- Implementieren Sie Caching: Speichern Sie häufige Antworten, um API-Aufrufe zu reduzieren und die Reaktionszeit zu verbessern:

python

# Simple cache implementation

response_cache = {}

def get_cached_response(query_key, generator_function, ttl=3600):

"""Get cached response or generate new one"""

if query_key in response_cache:

timestamp, response = response_cache[query_key]

if time.time() - timestamp < ttl:

return response

# Generate fresh response

new_response = generator_function()

response_cache[query_key] = (time.time(), new_response)

return new_responseStapelverarbeitung: Bearbeiten Sie unabhängige Aufgaben parallel und nicht sequenziell:

python

import asyncio

async def run_parallel_research():

task1 = asyncio.create_task(research_agent.async_run("Research topic A"))

task2 = asyncio.create_task(research_agent.async_run("Research topic B"))

task3 = asyncio.create_task(research_agent.async_run("Research topic C"))

results = await asyncio.gather(task1, task2, task3)

return resultsDer technische Vorteil von Llama 4 für AI Makler

Lama 4's Aufgrund seiner besonderen Eigenschaften eignet es sich besonders gut für Agentenanwendungen:

- Frühe Fusions-Multimodalarchitektur ermöglicht es Agenten, Text und Bilder auf natürliche Weise gemeinsam zu verarbeiten, im Gegensatz zu früheren Ansätzen, bei denen die Modalitäten getrennt gehalten wurden.

- Experten-Mix-Design ermöglicht es dem Modell, für jede Aufgabe nur relevante Parameter zu aktivieren, wodurch die Antworten schneller und präziser werden.

- Außergewöhnliche Verarbeitung langer Kontexte (bis zu 10 Mio. Token in Scout) ermöglicht es Agenten, den Gesprächsverlauf beizubehalten und auf lange Dokumente zu verweisen, ohne die Kohärenz zu verlieren.

- Mehrsprachige Fähigkeiten in 12 offiziell unterstützten Sprachen machen Agenten für Benutzer weltweit zugänglich.

hes, Sie können erstellen AI Agenten, die nicht nur Anfragen verstehen und beantworten, sondern aktiv zusammenarbeiten, um komplexe Probleme zu lösen – sie repräsentieren wirklich die nächste Generation von AI Anwendungen.

Häufig gestellte Fragen

Was unterscheidet Llama 4 von anderen Sprachmodellen?

Llama 4 nutzt einen Early-Fusion-Ansatz für multimodale Verarbeitung und eine spärliche „Mixture of Experts“-Architektur für mehr Effizienz. Es behandelt Text, Bilder und Videos als eine einzige Token-Sequenz und aktiviert für jeden Input nur relevante „Experten“-Submodelle.

Kann AutoGen mit anderen LLMs als Llama 4 arbeiten?

Ja, AutoGen ist modellunabhängig und kann mit verschiedenen LLMs arbeiten, einschließlich OpenAI Modelle, anthropische Modelle und andere Open-Source-Modelle wie Mistral AI oder DeepSeek.

Baut AI Benötigen Agenten fortgeschrittene Programmierkenntnisse?

Nicht unbedingt. Mit grundlegenden Python-Kenntnissen und LLM-Kenntnissen können Sie Agenten-Workflows einrichten und ausführen. AutoGen vereinfacht die Erstellung und Koordination mehrerer Agenten.

Können diese AI Agenten werden auf lokaler Hardware ausgeführt?

Ja, AutoGen unterstützt die Integration mit lokalen LLMs über Tools wie Ollama, sodass Sie Agenten auf Ihrer eigenen Hardware ausführen können.

Wie gehe ich in der Produktion sicher mit API-Schlüsseln um?

Speichern Sie API-Schlüssel in Umgebungsvariablen oder sicheren Tresoren statt im Code. Verwenden Sie für Produktionsbereitstellungen die richtige Authentifizierung und Verschlüsselung.

Kann ich die Agenten mit benutzerdefinierten Tools und APIs erweitern?

Absolut. Mit AutoGen können Sie Agenten mit externen APIs, Datenbanken und benutzerdefinierten Tools verbinden und ihnen so die Interaktion mit verschiedenen Systemen und Diensten ermöglichen.

Empfohlene Lektüre:

Fazit

zum AI Agenten mit Llama 4 und AutoGen eröffnen spannende Möglichkeiten für die Entwicklung intelligenter, kollaborativer Systeme, die komplexe Aufgaben bewältigen können. Die Kombination von Lama 4's multimodale Intelligenz und AutoGen's flexibles Agenten-Framework bietet Entwicklern leistungsstarke Tools zum Erstellen AI Agenten, die denken, zusammenarbeiten und sich an verschiedene Szenarien anpassen können.

Unser Beispielprojekt – ein Multi-Agenten-Vorschlagsgenerator – demonstriert nur eine praktische Anwendung dieser Technologien. Die gleichen Prinzipien lassen sich auch anwenden auf bauen AI Agenten für die Inhaltserstellung, Datenanalyse, Kundenservice, Forschung, Projektmanagement und viele andere Bereiche.

Wenn Sie Ihr eigenes bauen AI Agenten mit Llama 4 und AutoGen, beachten Sie diese wichtigen Grundsätze:

![SudowriteDie Muse von [Name der Marke] wurde 2026 grundlegend überarbeitet – hier ist, was sich tatsächlich geändert hat.](https://aimojo.io/wp-content/uploads/2026/04/Sudowrite-Muse-1.5-Got-a-Major-Overhaul-450x338.webp)

BONUS: Holen Sie sich unsere 200 $“AI „Mastery Toolkit“ KOSTENLOS bei der Anmeldung!

BONUS: Holen Sie sich unsere 200 $“AI „Mastery Toolkit“ KOSTENLOS bei der Anmeldung!

![SudowriteDie Muse von [Name der Marke] wurde 2026 grundlegend überarbeitet – hier ist, was sich tatsächlich geändert hat.](https://aimojo.io/wp-content/uploads/2026/04/Sudowrite-Muse-1.5-Got-a-Major-Overhaul-100x100.webp)

![10 besten Hausmeister AI Alternativen mit NSFW-Chat [Mai 2026]](https://aimojo.io/wp-content/uploads/2024/01/Best-Janitor-AI-Alternatives-100x100.webp)