تكتب برنامجًا نصيًا. يعمل البرنامج بشكل مثالي على موقع تجريبي. ثم توجهه إلى متجر تجزئة كبير أو منصة تواصل اجتماعي. فجأة، يمتلئ جهازك برسائل خطأ 403 (ممنوع) أو حلقات CAPTCHA لا نهائية.

انتهى عصر تحليل HTML البسيط.

يتطلب استخراج البيانات من مواقع الويب الحديثة أكثر من مجرد إرسال طلب GET. مواقع الويب اليوم عبارة عن تطبيقات معقدة محمية بأنظمة دفاعية قوية. إذا كنت ترغب في تجاوز حظر استخراج البيانات من الويبيجب أن تفهم كيف تتواصل المتصفحات مع الخوادم.

تعمل منصات رئيسية مثل كلاود فلير وأكامي وداتادوم كبوابات تحكم. فهي تحلل كل اتصال وارد، وتتحقق مما إذا كنت إنسانًا أم برنامجًا آليًا. ولتجاوز هذه البوابات، تحتاج إلى أدوات تحاكي السلوك البشري بدقة.

سنوضح لك كيفية القيام بذلك استخراج البيانات من مواقع الويب الديناميكية بشكل فعال، ولماذا يُعد تفويض هذه المهام إلى Decodo الخطوة الأذكى لخط أنابيب البيانات الخاص بك.

الضرورة "اللارأسية": لماذا تفشل الطلبات البسيطة

في الماضي، كانت المواقع الإلكترونية ترسل صفحات HTML كاملة من الخادم. كان برنامجك النصي يقوم بتنزيل النص، وكنت تستخرج البيانات.

الآن، أكثر من 70% من العصر الحديث مواقع التجارة الإلكترونية يعتمد هذا النظام على تقنية العرض من جانب العميل (CSR). فعندما تطلب عنوان URL، يرسل الخادم صفحة HTML فارغة. أما المحتوى الفعلي - الأسعار، والمخزون، والأوصاف - فيتم تحميله لاحقًا باستخدام جافا سكريبت.

إذا استخدمت مكتبة HTTP قياسية، فستحصل على تلك الصفحة الفارغة. ستفقد البيانات تمامًا.

لعرض المحتوى، أنت بحاجة إلى عرض جافا سكريبت لأغراض استخراج البياناتيعني هذا عادةً تشغيل متصفح مثل كروم أو فايرفوكس في الخلفية بدون واجهة رسومية. يُعرف هذا باسم "بدون واجهة رسومية". استخراج البيانات من المتصفح.

تشغيل المتصفحات بدون واجهة رسومية يستهلك موارد النظام بشكل كبير، حيث يستهلك ذاكرة الوصول العشوائي ووحدة المعالجة المركزية. كما أنه يطرح مشكلة جديدة: وهي مشكلة الكشف.

فك شفرة أنظمة مكافحة البرامج الآلية

لا تكتفي أنظمة الأمان بالنظر إلى... عنوان IPإنهم يفحصون كيفية عمل "المتصفح" الخاص بك.

إذا كنت تستخدم مكتبة أتمتة قياسية، فإنها تترك آثارًا. قد تقوم بتعيين متغير مثل navigator.webdriver = true. هذا دليل قاطع على استخدامك للبرامج الآلية. أنظمة مكافحة البرامج الآلية ترى هذا المؤشر وتحظرك فورًا.

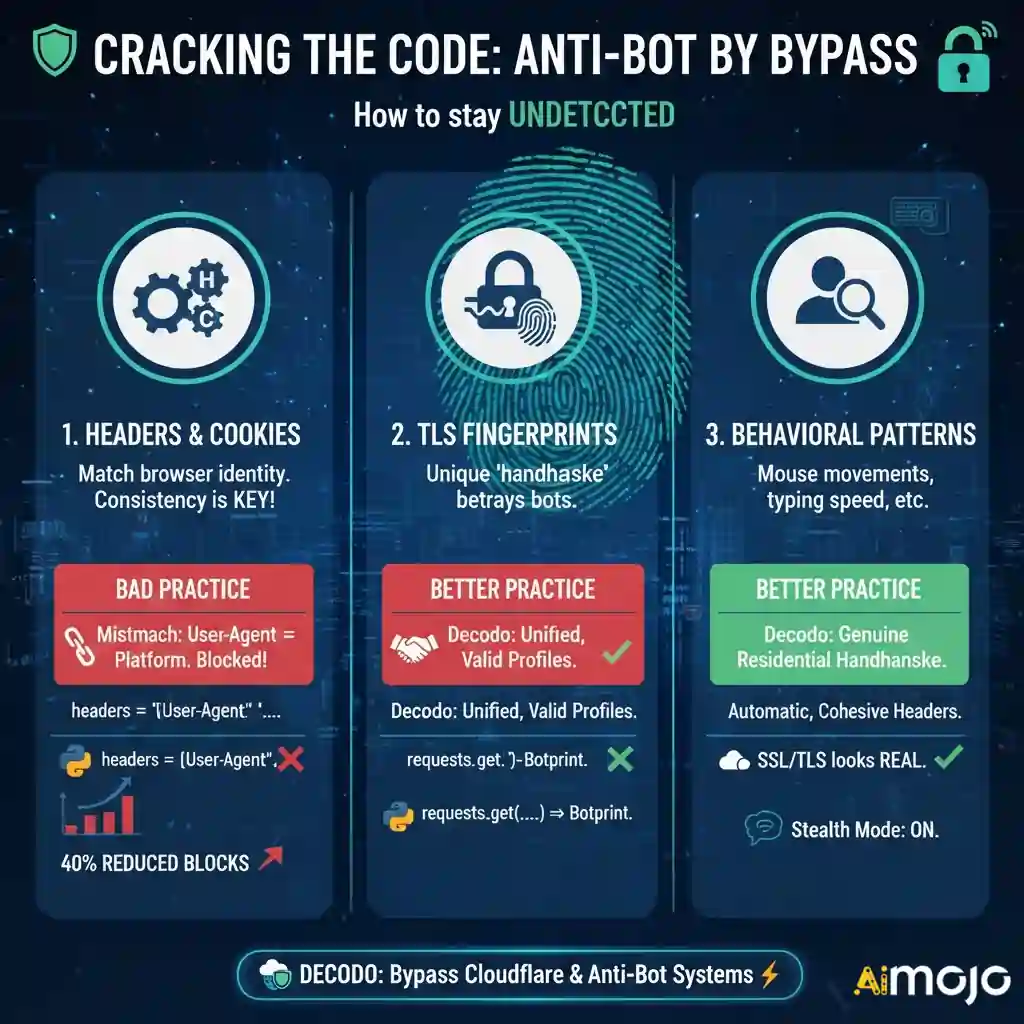

إلى تجاوز عملية استخراج البيانات من كلاود فلير فيما يتعلق بالحماية، يجب عليك إدارة ثلاث طبقات أساسية:

1. لماذا تُعدّ مطابقة العناوين مهمة في استخراج البيانات من الويب

تُخبر رؤوس طلباتك الخادم بهويتك. وأشهرها هو User-Agent. مع ذلك، لا يكفي مجرد تغيير سلسلة User-Agent الخاصة بك.

يجب أن تعمل ترويسات الموقع كوحدة متكاملة. إذا أرسلتَ وكيل مستخدم يدّعي أنه متصفح Chrome على نظام Windows، بينما تبدو ترويسات نظامك الأساسي كأنها تخص Linux، فسيتم حظرك. هذا التناقض هو السبب الرئيسي لفشل عمليات استخراج البيانات.

يمكن أن تؤدي إدارة رؤوس الطلبات بشكل صحيح إلى تقليل معدلات الحظر بنسبة تصل إلى 40٪ حتى قبل تغيير الخادم الوكيل.

غالبًا ما يتم حظر هذا على الفور

طلبات الاستيراد

headers = {'User-Agent': 'Mozilla/5.0'}

response = requests.get('https://example.com', headers=headers)

يقوم برنامج Decodo تلقائيًا بإنشاء نصوص صحيحة ومتسقة ملفات تعريف الرأسيضمن ذلك أن تتطابق تلميحات Accept-Language و Referer و platform مع إصدار المتصفح الذي تقوم بمحاكاته.

2. الفخ الخفي: بصمة TLS

هذا هو المكان الذي تفشل فيه معظم برامج استخراج البيانات المخصصة.

عندما يبدأ برنامجك النصي اتصال HTTPS آمنًا، فإنه يُجري "مصافحة" مع الخادم. ويُنشئ ترتيب هذه المصافحة ومعاييرها بصمة فريدة، تُسمى غالبًا تجزئة JA3.

تختلف عملية المصافحة في مكتبة requests الخاصة بلغة بايثون اختلافًا كبيرًا عن عملية المصافحة الحقيقية. متصفح كرومتلاحظ Cloudflare هذا الفرق فورًا. حتى لو كانت عناوينك مثالية، فإن تجاوز بصمة TLS قد تفشل الاستراتيجية إذا كشفت المصافحة عنك.

يتولى Decodo هذه المهمة في الخلفية. فهو يُعدّل عملية التفاوض على بروتوكول SSL/TLS على المستوى الأدنى لتبدو تمامًا كما لو كان مستخدمًا حقيقيًا يتصفح الإنترنت من اتصال منزلي.

أفضل الطرق لاستخراج البيانات من تطبيقات الصفحة الواحدة بأمان

تطبيقات الصفحة الواحدة (SPA) تشتهر هذه المواقع بصعوبة استخراج البيانات منها. فهي تُحمّل البيانات بشكل غير متزامن. قد يُفعّل برنامج الاستخراج تحميل الصفحة، ولكن إذا استخرج البيانات مبكرًا جدًا، فلن يحصل على أي شيء.

تحتاج إلى استخراج البيانات من مواقع المنتجعات الصحية عن طريق انتظار حالة "الشبكة خاملة". هذا يعني أن المتصفح ينتظر حتى تنتهي جميع استدعاءات واجهة برمجة التطبيقات في الخلفية قبل جلب كود HTML.

يُعدّ تنفيذ ذلك يدويًا باستخدام أدوات مثل Puppeteer أو Selenium غير مستقر. تتعطل البرامج النصية، وتتغير أسماء العناصر، وتؤدي تسريبات الذاكرة إلى إبطاء الخادم.

ديكودو تجريف على شبكة الإنترنت تعمل واجهة برمجة التطبيقات (API) على تبسيط هذا الأمر. تقوم بإرسال طلب، ويقوم Decodo بتشغيل المتصفح، وعرض JavaScript، والانتظار حتى تستقر الشبكة، ثم يعيد HTML النظيف.

أنشئ عمليات استخراج بيانات قابلة للتوسع وغير قابلة للكشف باستخدام Decodo

يُعدّ إنشاء شبكة استخراج بيانات من المتصفح بدون واجهة رسومية مكلفًا. إذ يتطلب الأمر تعديل برامج تشغيل Chrome، وتغيير آلاف عناوين IP، وتحديث التعليمات البرمجية باستمرار عند تغيير Cloudflare لخوارزميتها.

تقدم شركة Decodo خدمة متخصصة استخراج البيانات من المتصفح تلقائيًا بنية تحتية تتولى المهام الشاقة.

الميزات الرئيسية للتهرب

تم تصميم المنصة لـ تجاوز حظر استخراج البيانات من الويب من خلال التركيز على المحاكاة والموثوقية:

دليل التكامل السريع: استخدام واجهة برمجة تطبيقات استخراج البيانات من Decodo

إليك مدى سهولة التبديل من سكربت محلي محظور إلى Decodo. لستَ بحاجة لإدارة المتصفح بنفسك.

import requests

# Decodo API Endpoint

url = "https://api.decodo.com/v1/scrape"

payload = {

"url": "https://difficult-site.com/products",

"render_js": True, # Activates Headless Browser

"wait_for_selector": ".product-price", # Waits for dynamic content

"country": "US" # Uses premium US residential proxies

}

headers = {

"Authorization": "Bearer YOUR_DECODO_API_KEY",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

if response.status_code == 200:

print("Scraping Successful!")

print(response.json()['content'])

else:

print("Error:", response.text)لاحظ البساطة. أنت لا تستورد Selenium، ولا تُنزّل Chromedriver. أنت ببساطة تخبر Decodo: "أحتاج إلى هذا الرابط، وأرجو منك عرضه". جافا سكريبت".

الاختيار بين واجهة برمجة تطبيقات Puppeteer أو Selenium أو Decodo

يبدأ العديد من المطورين باستخدام أدوات مفتوحة المصدر. من المفيد فهم المفاضلات بين Puppeteer و Selenium وواجهات برمجة التطبيقات (API).

السيلينيوم: ممتاز للاختبار، ولكنه بطيء وسهل الكشف عنه. يتطلب تعديلاً كبيراً لتجنب ذلك. كشف برامج مكافحة الروبوتات محفزات التهرب.

محرك دمى/كاتب مسرحي: أسرع وأفضل لعرض جافا سكريبت لأغراض استخراج البيانات. مع ذلك، يتطلب الحفاظ على أسطول من هذه النسخ خبرة واسعة في مجال DevOps. ولا يزال عليك حل مشكلات البروكسي وبصمات الأصابع يدويًا.

واجهة برمجة تطبيقات Decodo: المسار الأمثل. يوفر قوة متصفح بدون واجهة رسومية دون الحاجة إلى الصيانة. يحل مشكلة تجاوز بصمة TLS وإدارة الرؤوس بشكل فوري.

باستخدام واجهة برمجة تطبيقات Decodo، توفر الفرق وقت التطوير، وتقلل تكاليف البنية التحتية، وتحقق معدلات نجاح أعلى في استخراج البيانات عبر مواقع الويب الحديثة المعقدة.

ادخر بذكاء، لا بجهد: دع ديكودو يتولى الأمر

يزداد انغلاق الإنترنت. ويُعدّ التهرب من أنظمة مكافحة البرامج الآلية بمثابة سباق تسلح. إذا كنت تُكرّس وقتك الهندسي لمواجهة شركة كلاود فلير، فلن تُخصّص وقتًا لتحليل بياناتك.

لا تحتاج إلى بناء بنية تحتية معقدة لـ استخراج البيانات من مواقع الويب الديناميكيةباستخدام Decodo، يمكنك الوصول إلى كشط المتصفح بدون واجهة رسومية على مستوى المؤسسات، وإدارة الجلسات المناسبة، وتدوير بصمات الأصابع المتقدم.

توقف عن التعرض للحظر. دع Decodo يتولى تعقيدات المتصفح بينما تركز أنت على التحليلات.

توصي AiMojo بـ:

BONUS: احصل على 200 دولارAI "مجموعة أدوات الإتقان" مجانية عند التسجيل!

BONUS: احصل على 200 دولارAI "مجموعة أدوات الإتقان" مجانية عند التسجيل!

![7 أفضل مجاني AI المولدات البشرية في عام 2026 [مراجعة وتصنيف]](https://aimojo.io/wp-content/uploads/2023/11/Best-Free-AI-Human-Generator-100x100.webp)